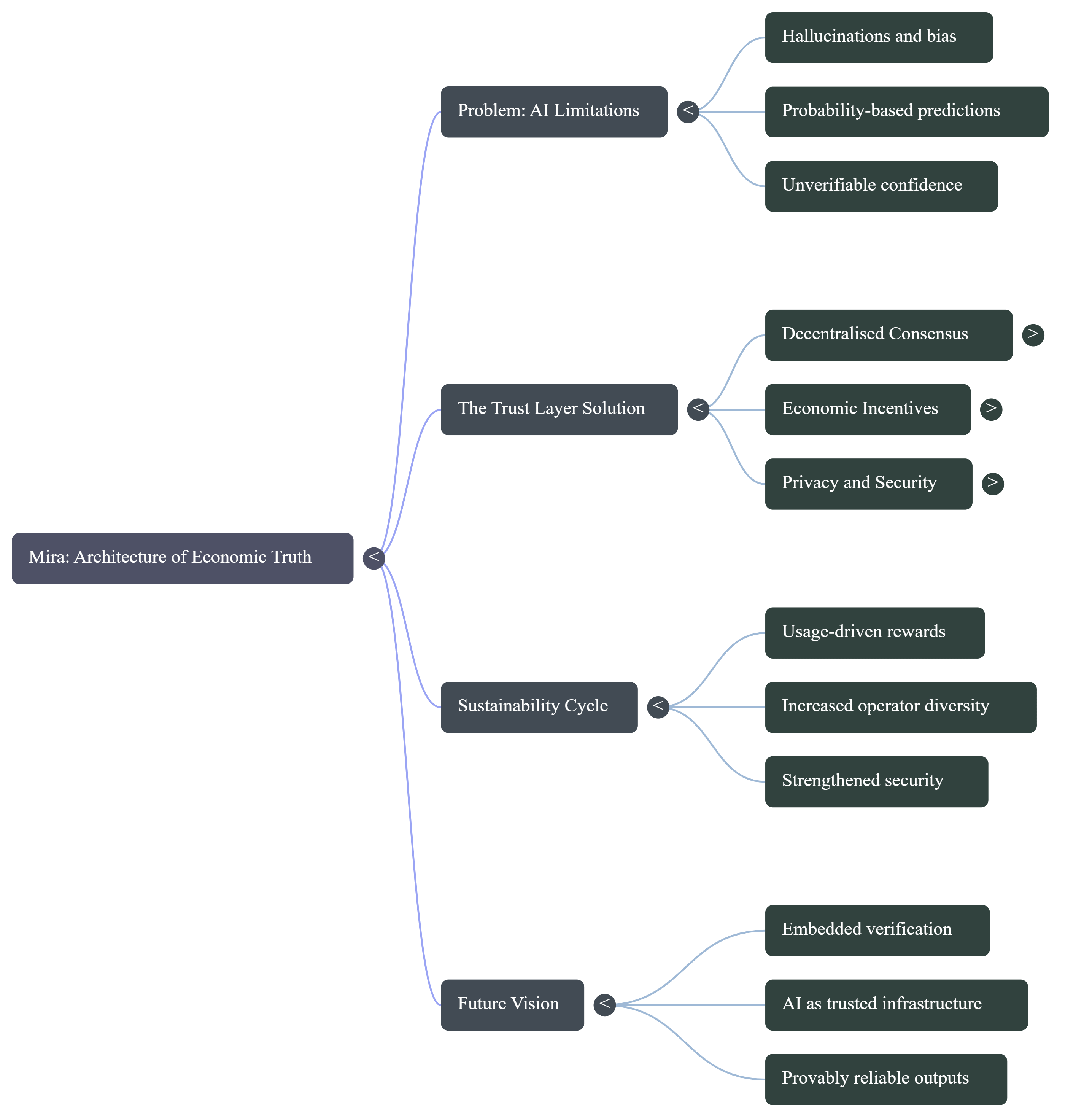

La maggior parte dei sistemi di intelligenza artificiale oggi ha una grande debolezza.

Generano risposte che sembrano sicure, ma non possono garantire che siano corrette. Le allucinazioni e i pregiudizi non sono glitch rari. Provengono da come vengono costruiti i modelli di grandi dimensioni. Questi sistemi prevedono probabilità, non verità verificate. Anche quando sono affinati, sembra esserci un tasso minimo di errore che un singolo modello non può eliminare completamente.

Mira parte da una convinzione diversa.

Invece di cercare di costruire un modello perfetto, costruisce un sistema in cui più modelli si verificano a vicenda.

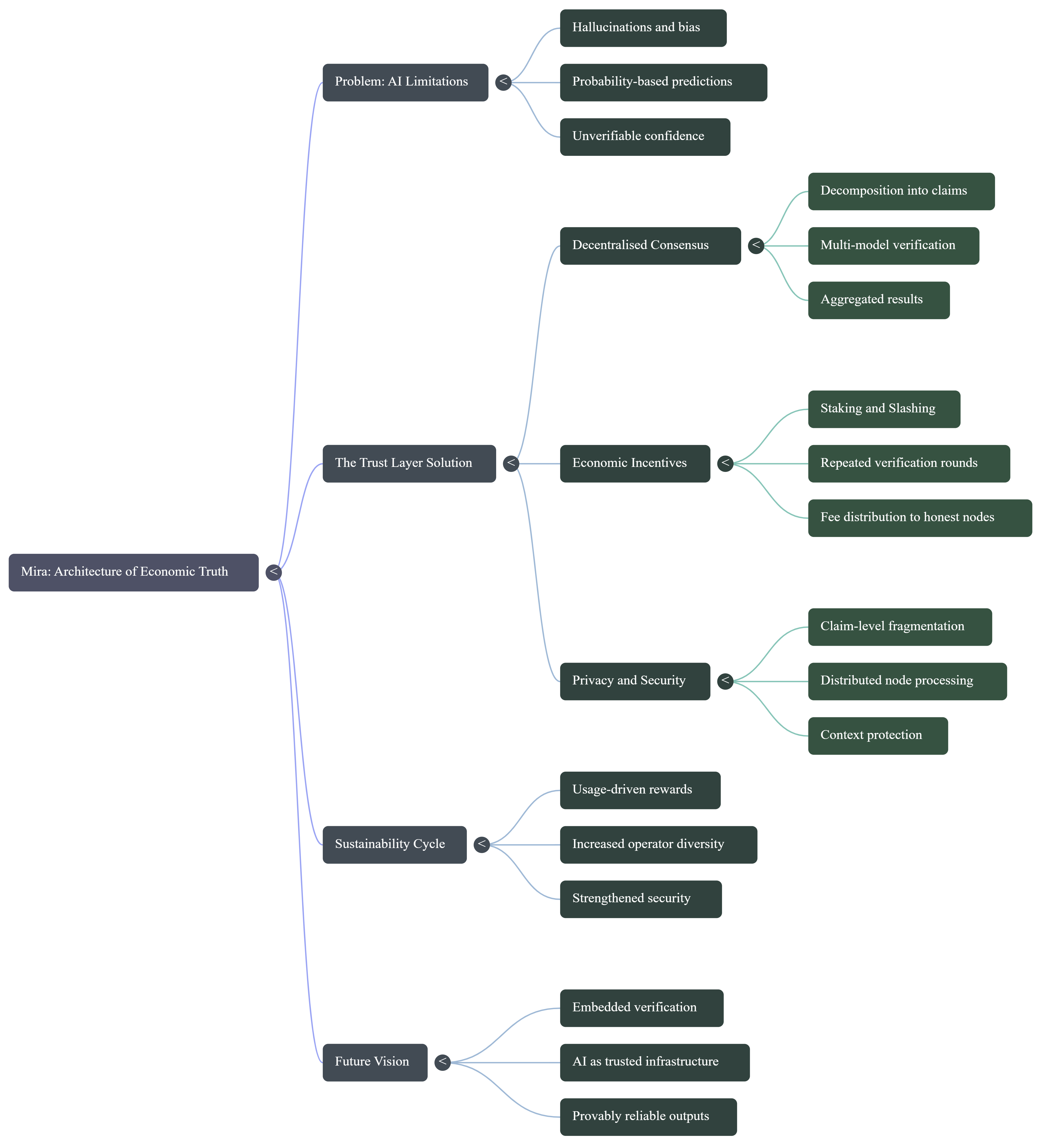

Secondo il @Mira - Trust Layer of AI whitepaper, $MIRA trasforma l'output dell'IA in reclami più piccoli e indipendenti. Ad esempio, un lungo paragrafo viene suddiviso in affermazioni fattuali chiare. Ogni affermazione viene poi inviata a diversi nodi verificatori. Questi nodi eseguono la propria inferenza e inviano un giudizio. La rete aggrega le risposte e produce un risultato di consenso.

Questo processo riduce sia l'allucinazione che il bias perché nessun singolo modello controlla il risultato.

Ma la sola verifica non è sufficiente. Gli incentivi contano.

$MIRA combina il lavoro basato su inferenza con lo staking. I validatori devono bloccare valore per partecipare alla rete. Se tentano di ingannare il sistema indovinando risposte o inviando risposte superficiali, rischiano di perdere la loro partecipazione attraverso la sanzione.

Il whitepaper spiega anche perché questo sia necessario. Poiché le domande di verifica possono talvolta sembrare compiti a scelta multipla, indovinare a caso può sembrare attraente. Mira affronta questo richiedendo ripetute fasi di verifica e penalità economiche. La probabilità di indovinare correttamente in modo consistente diminuisce drasticamente con più controlli, rendendo il comportamento disonesto statisticamente ed economicamente irrazionale.

Questo è come si costruisce la sostenibilità.

Gli utenti pagano commissioni per output verificati. Queste commissioni vengono distribuite agli operatori di nodo onesti che svolgono un vero lavoro di inferenza. Con l'aumento dell'uso, le ricompense aumentano. Con l'aumento delle ricompense, più operatori si uniscono. Con l'aumento della diversità degli operatori, il bias diminuisce e la sicurezza si rafforza. Diventa un ciclo di rinforzo.

Un altro importante strato è la privacy. Invece di inviare documenti completi a un singolo validatore, il contenuto è suddiviso in frammenti a livello di reclamo e distribuito tra i nodi. Nessun singolo partecipante vede l'intero contesto. Questo protegge le informazioni sensibili pur consentendo comunque la verifica.

La visione a lungo termine va oltre. Mira mira a passare dalla verifica dei risultati dopo la generazione all'integrazione della verifica direttamente nel processo di generazione. Ciò significa costruire sistemi di IA in cui la validazione è parte di come viene creata la risposta, non un pensiero postumo.

In termini semplici, Mira tratta la verità come qualcosa che deve essere garantito economicamente.

Non assunto.

Non centralizzato.

Ma verificato attraverso un consenso decentralizzato e incentivi allineati.

Man mano che l'IA diventa infrastruttura per finanza, sanità, diritto e automazione, la fiducia non può dipendere solo dalla fiducia. Deve dipendere da sistemi che premiano l'onestà e penalizzano la manipolazione.

Questa è la base su cui Mira sta cercando di costruire.

Sistemi come $MIRA mirano a costruire il livello di fiducia che rende gli output dell'IA non solo persuasivi, ma provabilmente affidabili.

#Mira #MİRA #AIToken #cforcrypto