@Mira - Trust Layer of AI

Nel mondo in rapida evoluzione dell'IA, c'è un'idea comune: l'output del modello è probabilmente corretto e qualsiasi errore può essere corretto in seguito. Per applicazioni quotidiane come la redazione di contenuti, la generazione di suggerimenti di ricerca o la creazione di script per il supporto clienti, questo modo di pensare funziona bene. Gli errori sono piccoli inconvenienti, facilmente corretti dagli esseri umani. Ma quando l'IA prende decisioni con conseguenze nel mondo reale, questa assunzione diventa rischiosa.

Le scommesse sono più alte nei sistemi autonomi

Considera le applicazioni finanziarie autonome, come le strategie DeFi che vengono eseguite on-chain, agenti di ricerca che sintetizzano letteratura complessa, o DAO che si affidano a intuizioni generate dall'IA per proposte di governance. In questi ambienti ad alto rischio, 'probabilmente corretto' non è sufficiente. Gli errori possono comportare perdite finanziarie, conclusioni di ricerca errate o decisioni di governance fuorvianti. La sfida non è che l'IA sia intrinsecamente inaffidabile; è che misurare l'affidabilità nel contesto è difficile. I modelli tradizionali non forniscono segnali chiari di fiducia, lasciando le parti interessate senza garanzie quando i risultati contano di più.

Colmare il divario di verifica

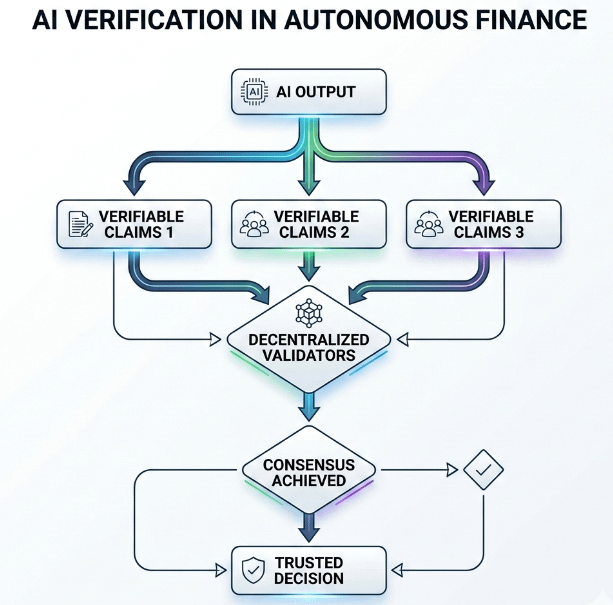

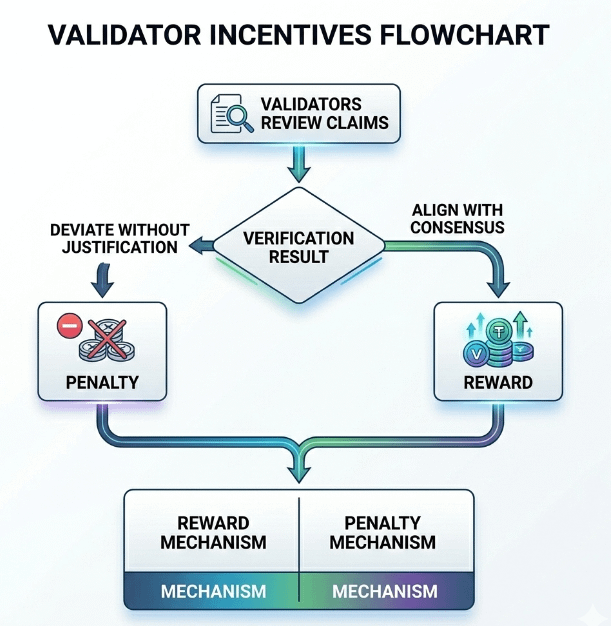

Ciò che è necessario è un meccanismo esterno per verificare gli output dell'IA prima che vengano utilizzati in decisioni critiche. Le reti di verifica decentralizzate offrono una soluzione promettente. Queste reti suddividono gli output dell'IA in affermazioni verificabili, che sono esaminate indipendentemente dai validatori. I validatori che si allineano al consenso sono ricompensati, mentre quelli che si discostano senza giustificazione affrontano conseguenze. Questo incentiva una validazione ponderata e accurata, creando uno strato di fiducia che va oltre il modello stesso.

Trasparenza e responsabilità attraverso il Web3

Il design della verifica decentralizzata è particolarmente adatto per le applicazioni Web3. I registri ancorati alla blockchain forniscono una traccia di audit trasparente, mostrando chi ha esaminato gli output, quando e quali conclusioni sono state tratte. Questo tipo di responsabilità è essenziale per le industrie in cui fiducia, conformità e governance sono critiche. Con registri verificabili, le organizzazioni possono fare affidamento sugli output dell'IA, sapendo che hanno superato un rigoroso scrutinio prima della loro esecuzione.

Perché il collo di bottiglia è la fiducia, non la capacità

I modelli di IA di oggi sono abbastanza potenti da aggiungere valore in molti ambiti, dalla ricerca alla finanza. Il collo di bottiglia non è la capacità, ma è la fiducia. Senza un'infrastruttura di verifica, anche gli output di IA più avanzati non possono essere considerati affidabili per decisioni ad alto rischio. Mira sta costruendo questo strato di responsabilità mancante, creando un sistema in cui gli output dell'IA non sono solo intelligenti, ma difendibili.

Il futuro dell'IA affidabile

Lo stack di infrastruttura dell'IA è ancora in fase di sviluppo. La potenza di calcolo e la sofisticazione del modello sono ben consolidate, ma lo strato di responsabilità rimane sotto sviluppato. Mira mira a colmare questa lacuna, assicurando che l'IA autonoma possa alimentare in sicurezza flussi di lavoro critici. La domanda ultima è se i mercati e le organizzazioni riconosceranno proattivamente l'importanza della verifica o solo dopo che un fallimento di alto profilo evidenzierà i rischi della fiducia cieca nell'IA.

Articolo

Costruire Fiducia nella Finanza Autonoma: Come Mira Colma il Divario di Verifica dell'IA

Disclaimer: Include opinioni di terze parti. Non è una consulenza finanziaria. Può includere contenuti sponsorizzati. Consulta i T&C.

0

5

52

Esplora le ultime notizie sulle crypto

⚡️ Partecipa alle ultime discussioni sulle crypto

💬 Interagisci con i tuoi creator preferiti

👍 Goditi i contenuti che ti interessano

Email / numero di telefono