Lascia che ti parli del problema più sottovalutato nella tecnologia in questo momento.

Ogni settimana, centinaia di milioni di persone chiedono all'AI qualcosa di importante. Chiedono di spiegare una diagnosi che il loro medico ha dato loro. Chiedono di redigere un contratto. Chiedono di riassumere un rapporto finanziario che influenzerà una decisione reale con conseguenze reali. E in quasi tutti questi casi, l'AI risponde con completa fiducia — sia che sia giusta o sbagliata.

Questa non è un'eccezione. Questo è il comportamento predefinito di ogni principale sistema AI implementato oggi.

Abbiamo costruito gli strumenti di comunicazione più persuasivi nella storia umana prima di costruire qualsiasi modo per verificare ciò che stanno realmente dicendo. E ora siamo sorpresi che le persone non riescano a distinguere tra un'IA che è accurata e una che sta allucinando a livello dottorale.

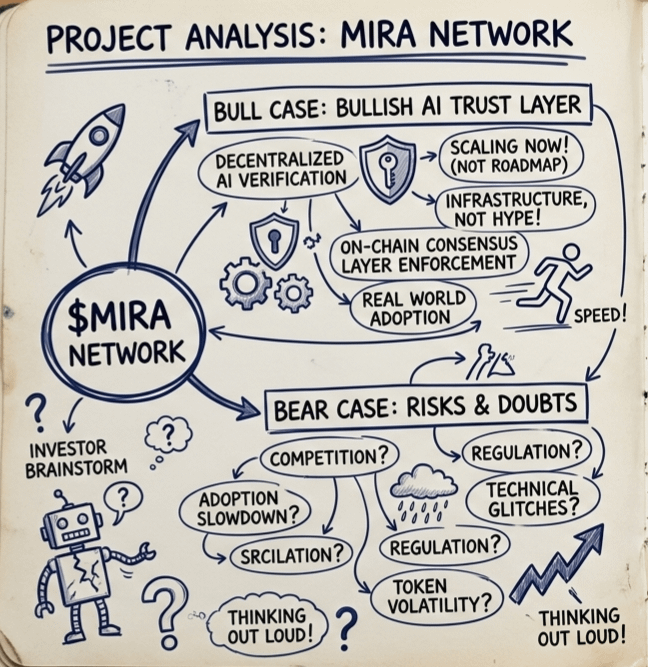

Questo è il problema che @mira_network ha deciso di risolvere davvero — non teorizzare, non scrivere un whitepaper — risolvere realmente, con un'infrastruttura funzionante che elabora query reali su scala reale in questo momento.

Ecco cosa rende l'approccio di Mira diverso da tutto il resto che afferma di risolvere l'affidabilità dell'IA.

La maggior parte delle proposte di "verifica dell'IA" cadono in una delle due trappole. O utilizzano un'unica autorità centralizzata per controllare i risultati dell'IA — che sostituisce solo una scatola nera con un'altra — oppure si affidano a revisori umani, che non scala e introduce i propri pregiudizi. Mira non fa né l'uno né l'altro.

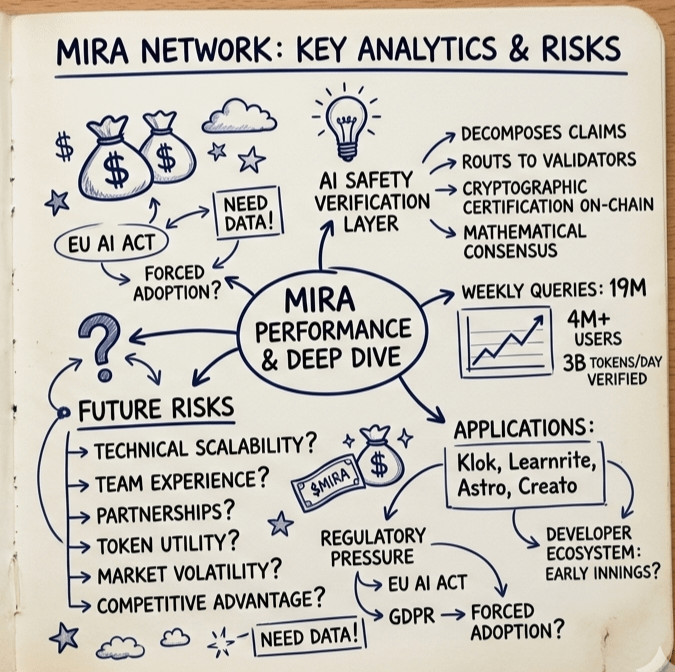

Invece, Mira ha costruito una rete di consenso distribuita in cui modelli AI indipendenti valutano simultaneamente le uscite degli altri. Ogni risposta viene scomposta in singoli reclami verificabili. Questi reclami vengono instradati a più nodi validatori indipendenti che eseguono modelli diversi con architetture e dati di addestramento differenti. Il consenso viene raggiunto matematicamente. Il risultato verificato viene certificato crittograficamente e scritto sulla blockchain.

Nessun modello singolo controlla il risultato. Nessun collo di bottiglia umano rallenta il processo. Nessun custode centralizzato decide cosa sia vero. Solo consenso distribuito che fa ciò che sa fare meglio — rendere la fiducia una proprietà emergente del sistema piuttosto che una caratteristica per cui devi prendere la parola di qualcuno.

I numeri che stanno già uscendo da questa rete non sono piccoli. Oltre 4 milioni di utenti. 19 milioni di query elaborate ogni settimana. 3 miliardi di token verificati ogni giorno. Applicazioni come Klok, Learnrite, Astro e Creato sono già costruite sopra i binari di verifica di Mira — e l'ecosistema degli sviluppatori è ancora nelle sue prime fasi.

Ora pensa a dove questo porta.

Agenti AI autonomi vengono attualmente dispiegati nei flussi di lavoro sanitari. L'IA viene utilizzata per generare documenti legali che le persone reali firmano. Le istituzioni finanziarie stanno sperimentando analisi guidate dall'IA che influenzano l'allocazione di capitale. In ognuno di questi settori, il costo di un'allucinazione non rilevata non è una risposta fastidiosa di un chatbot — è una diagnosi errata, un contratto difettoso, un cattivo scambio.

La pressione normativa da sola costringerà le imprese ad adottare un'infrastruttura di verifica. Il GDPR ha già disposizioni riguardo la decisione automatizzata. L'Atto sull'IA dell'UE sta creando requisiti di responsabilità obbligatori per i sistemi di IA ad alto rischio. Negli Stati Uniti, i regolatori specifici per settore nella sanità e nella finanza stanno osservando da vicino i dispiegamenti dell'IA. Ognuna di queste pressioni punta nella stessa direzione: qualcuno deve essere in grado di dimostrare che un output dell'IA è stato controllato.

Mira sta costruendo l'infrastruttura che rende possibile quella prova.

$MIRA è il livello economico che tiene tutto insieme. I validatori mettono in stake $MIRA per partecipare alla rete di consenso — mettendo in gioco una vera posta economica per ogni verifica che eseguono. Il consenso onesto guadagna ricompense. Il comportamento disonesto attiva il slashing. Questo non è un token di governance che vive in un portafoglio multisig da qualche parte — è un meccanismo di incentivo attivo che rende la rete più affidabile man mano che cresce, perché il costo di attaccarla aumenta con il valore che garantisce.

Il round di finanziamento seed da 9 milioni di dollari da Bitkraft e Framework Ventures, con la partecipazione di Accel, Mechanism Capital e Folius Ventures, non era capitale di rischio alla ricerca di una narrativa. Questi sono fondi che fanno una profonda due diligence tecnica. Hanno visto una rete funzionante, un caso d'uso reale e un modello token che crea una domanda genuina man mano che l'adozione cresce.

Ecco a cosa continuo a tornare quando penso a $MIRA.

Ogni strato di infrastruttura trasformativa nella storia della tecnologia è sembrato noioso dall'esterno mentre veniva costruito. TCP/IP non era emozionante — fino a quando Internet non ha iniziato a funzionare su di esso. HTTPS non era un titolo — fino a quando l'e-commerce non lo ha richiesto. Lo strato di verifica per l'IA non farà la prima pagina di un blog tecnologico oggi. Ma tra cinque anni, quando l'IA sarà incorporata in ogni flusso di lavoro significativo nella medicina, nel diritto e nella finanza, la questione di chi ha costruito l'infrastruttura di fiducia avrà un'enorme importanza.

@mira_network sta costruendo quel livello. In modo aperto. Con tecnologia funzionante. Su scala misurabile.

Questo è il tipo di scommessa che vale la pena comprendere — anche se il mainstream non si è ancora messo al passo.

Fai le tue ricerche. Valuta attentamente i rischi. Ma non lasciare che la costruzione silenziosa ti inganni nel pensare che qui non stia accadendo nulla di importante.

#Mira #MIRA @Mira - Trust Layer of AI $MIRA