L'intelligenza artificiale si sta muovendo più velocemente della nostra capacità di fidarci di essa.

Ora ci affidiamo all'IA per segnali di trading, analisi dei rischi, moderazione dei contenuti, approfondimenti medici e persino discussioni di governance. Ma ecco la verità scomoda: la maggior parte dei sistemi di IA sono ancora scatole nere. Ricevi una risposta. Non sai perché. Non puoi verificare come. E sicuramente non puoi auditare ciò che è accaduto dietro le quinte.

Quel divario tra output e prova è dove si sta formando la prossima narrativa cripto.

La crisi di fiducia nell'IA

Nella crittografia, diciamo “non fidarti, verifica.”

Nell'AI, ci fidiamo ancora principalmente.

Questa contraddizione sta diventando critica.

Immagina:

• Un modello AI genera una strategia di trading per il tuo portafoglio.

• Un DAO utilizza l'AI per esaminare le proposte di sovvenzione.

• Un protocollo assicurativo Web3 si basa sull'AI per valutare il rischio.

Se quell'AI è di parte, manipolata o configurata in modo errato, chi è responsabile? E, cosa più importante, come può chiunque verificare indipendentemente il risultato?

Questa è la debolezza strutturale che Mira Network sta affrontando.

Cos'è l'Intelligenza Verificabile?

Mira Network introduce un'idea semplice ma potente:

Gli output dell'AI dovrebbero essere provabili.

Invece di trattare l'AI come un oracolo misterioso, Mira aggiunge un livello di verifica che consente di controllare, convalidare e ancorare crittograficamente i risultati del modello. In termini pratici, questo crea:

• Processi di inferenza trasparenti

• Risultati AI supportati da prove

• Registri di esecuzione resistenti alle manomissioni

• Validazione a fiducia minimizzata

Non si tratta solo di marketing “AI + blockchain”. È un'infrastruttura progettata per rendere l'AI responsabile nei sistemi decentralizzati.

Scenario del Mondo Reale: Perché Questo È Importante

Portiamo tutto alla realtà.

Scenario 1: Trading Potenziato dall'AI

Una piattaforma DeFi integra l'AI per generare strategie di rendimento. Gli utenti depositano capitale basato sulle raccomandazioni del modello.

Senza verifica:

Ti fidi dell'affermazione della piattaforma che “il modello dice che è ottimale.”

Con Mira:

L'output dell'AI può essere convalidato. L'esecuzione può essere confermata. I parametri possono essere auditati.

La differenza è sottile, ma potente. Si sposta dalla fiducia cieca alla prova misurabile.

Scenario 2: AI nella Governance

Un DAO utilizza l'AI per riassumere le proposte e classificarle in base alla valutazione dell'impatto.

Senza intelligenza verificabile:

I membri devono fidarsi dell'algoritmo di ranking.

Con Mira:

La logica di scoring e i risultati di inferenza possono essere verificati indipendentemente, riducendo il rischio di manipolazione della governance.

Questo è il punto in cui l'AI incontra i principi crittografici.

Visione del Prodotto: Il Livello di Fiducia dell'AI

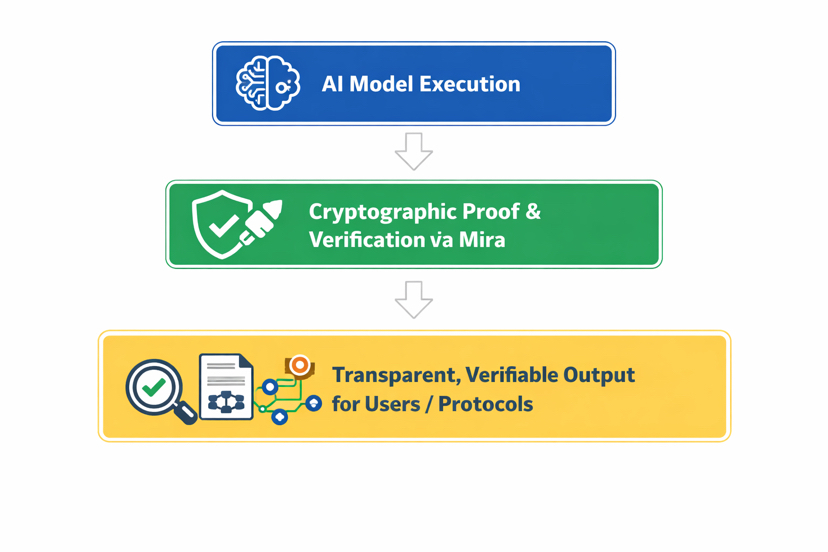

Mira Network si posiziona come un livello di fiducia per i sistemi AI. Pensalo come un middleware tra:

Modelli AI → Livello di Verifica → Utenti Finali

Questa architettura trasforma l'AI da un servizio centralizzato a un'utilità pubblica verificabile.

Perché Questa Narrazione È Tempestiva

Stiamo entrando in un ciclo in cui gli agenti AI interagiranno con i contratti intelligenti.

Bot di trading autonomi.

Gestione della liquidità guidata dall'AI.

Scoring di credito on-chain.

Se questi sistemi operano senza prova, introducono rischio sistemico.

L'intelligenza verificabile potrebbe diventare fondamentale come furono gli audit dei contratti intelligenti nei primi giorni della DeFi.

Il mercato sta iniziando a riconoscere che la prossima ondata non è solo AI più veloce, ma AI affidabile.

Principi di Mindshare Applicati

1. Creatività: Ridefinire l'AI come Infrastruttura, Non Solo Software

Mira riformula gli output dell'AI come asset che richiedono verifica. Questo è un nuovo modello mentale.

Non stiamo solo costruendo modelli migliori.

Stiamo costruendo intelligenza responsabile.

Questo cambiamento di inquadramento è importante per il posizionamento a lungo termine.

2. Profondità Professionale: Risolvere un Vero Problema Tecnico

L'AI verificabile non è una narrazione superficiale. Tocca:

• Sistemi di prova crittografica

• Validazione decentralizzata

• Ambienti di inferenza sicuri

• Computazione a fiducia minimizzata

Questi sono domini complessi. I team che risolvono questa intersezione definiranno come l'AI si integra in Web3 su larga scala.

3. Rilevanza: AI x Crypto È il Meta Attuale

I token AI sono in tendenza.

Agenti AI on-chain stanno emergendo.

I sistemi automatizzati si stanno espandendo nella finanza e nella governance.

Ma senza un livello di fiducia, questa crescita diventa fragile.

Il posizionamento di Mira si allinea direttamente con questa necessità strutturale.

Impatto della Comunità e dell'Ecosistema

Per gli sviluppatori:

Ottieni un modo per costruire dApp abilitati all'AI senza costringere gli utenti a “credere semplicemente” al tuo modello.

Per gli investitori:

Ottieni un quadro più chiaro per valutare i progetti di infrastruttura AI oltre l'hype.

Per gli utenti:

Ottieni visibilità su come vengono prese le decisioni.

La fiducia diventa misurabile.

E nella crittografia, la fiducia misurabile si accumula.

La Grande Domanda

La crittografia ha risolto la fiducia nel denaro.

Possiamo ora risolvere la fiducia nell'intelligenza?

Se l'AI influenzerà mercati, governance e identità in Web3, la verifica dovrebbe essere facoltativa o obbligatoria?

L'intelligenza verificabile è il prossimo livello fondamentale dei sistemi decentralizzati?

@Mira - Trust Layer of AI #Mira #mira $MIRA