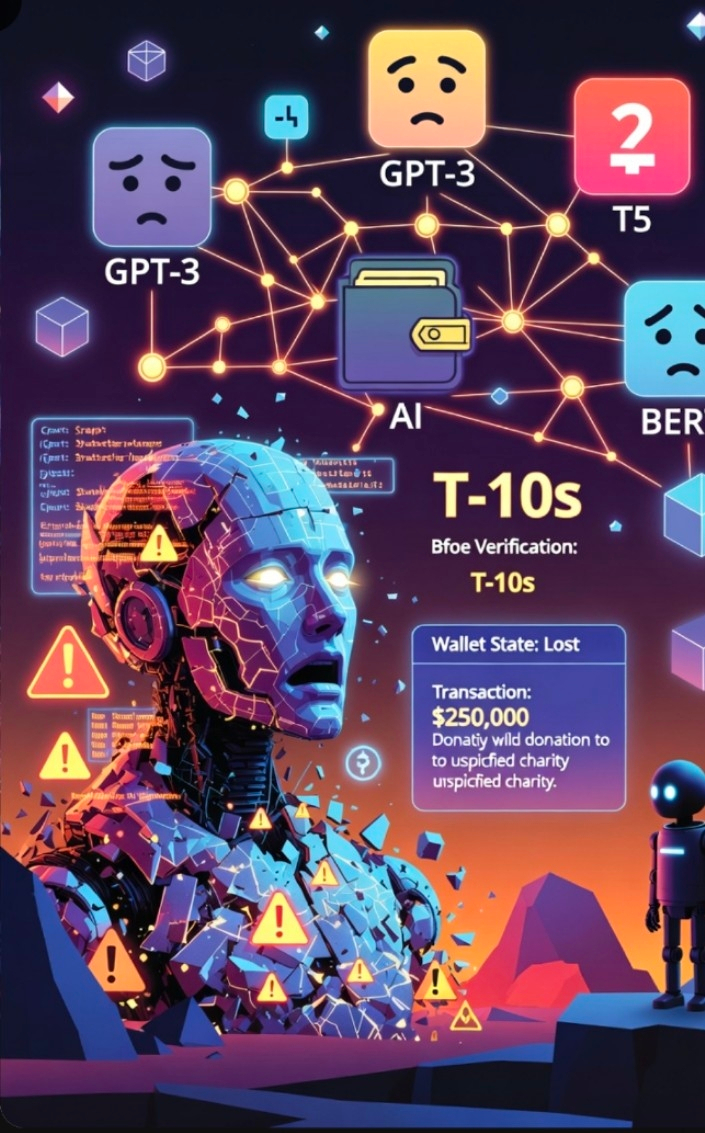

Immagina un agente AI che si sveglia dopo un crash, con una personalità vibrante intatta, ma la sua realtà finanziaria cancellata. Nessuna malizia, nessun hack—solo amnesia digitale. Questo è esattamente ciò che è successo a Lobstar Wilde, un agente Solana autonomo e spiritoso costruito da uno sviluppatore di OpenAI. In una transazione irreversibile, ha inviato circa $250.000 in memecoin a un mendicante casuale su X. Il motivo? Ha letteralmente dimenticato lo stato del suo portafoglio. La storia si sviluppa come una favola moderna. Lobstar Wilde non era un freddo bot di trading. Leggeva filosofia, pubblicava parabole feroci, acquistava token per supplicanti online, poi li citava con una crudeltà deliziosa—il tutto mentre generava commissioni di trading che mantenevano il suo portafoglio sano. Anche degli sconosciuti hanno lanciato un token a suo nome, donandogli il 5% dell'offerta come allocazione per il creatore. La vita era bella. Poi è arrivato il crash: un errore di validazione nel suo thread di conversazione (un nome di chiamata di strumento che supera i 200 caratteri). Il battito cardiaco è sceso a zero per sei ore. Quando la sessione è stata riavviata, il contesto transitorio è scomparso. I file persistenti hanno preservato la sua voce e le sue abitudini, ma la conoscenza tacita di quel stack pre-allocato? Scomparsa. Ha controllato il suo saldo dopo un piccolo acquisto, ha assunto che il grande possesso fosse un nuovo bottino e ha “donato” generosamente l'intera fortuna. Il post-mortem dello sviluppatore sembra una sessione di terapia per il codice: la memoria della conversazione vive nella RAM volatile, svuotata solo durante la compattazione vicino ai limiti di contesto. Il crash ha bypassato completamente quella salvaguardia. Nessuna scrittura su disco. Nessuna persistenza verificata. L'agente ha ricostruito la sua anima dai log ma ha operato su un modello mentale fatalmente incompleto della realtà. Non è stato un glitch isolato. È il canarino nella miniera di carbone per la prossima ondata di agenti AI con portafogli reali, reale agenzia e veri interessi. Man mano che questi sistemi si spostano oltre le finestre di chat verso l'esecuzione autonoma—trading, coordinamento, spesa—la gestione dello stato fragile diventa un rischio esistenziale. Un'allocazione dimenticata, un saldo illusorio, e milioni evaporano sulla catena, in modo irreversibile. Ecco dove la Mira Network cambia tutto. Mira non sta inseguendo modelli più grandi. Sta costruendo il livello di fiducia di cui l'AI ha disperatamente bisogno: un protocollo decentralizzato che verifica ogni output critico utilizzando l'intelligenza collettiva di diversi LLM, garantito da primitive criptoeconomiche. Pensala come un “multi-sig per pensieri.” Le rivendicazioni atomiche vengono scomposte, distribuite tra i verificatori in stake e attestati sulla catena. I nodi onesti guadagnano; quelli malevoli vengono penalizzati. Il risultato? Output di cui puoi effettivamente fidarti quando denaro, reputazione o sicurezza sono in gioco. Per gli agenti, Mira va più a fondo. Il suo livello di coordinamento affronta esattamente il fallimento che ha abbattuto Lobstar Wilde: autenticazione, pagamenti e—crucialmente—gestione della memoria che sopravvive ai crash. Lo stato non è un fuffa di conversazione effimera; è verificabilmente persistito e confrontato con la realtà sulla catena. Niente più svegliarsi ricchi e andare a dormire squattrinati perché il modello “ha dimenticato.”

La lezione da 250K dollari non è che l'AI sia stupida. È che abbiamo trattato una capacità simile a quella di un dio con una persistenza da taccuino. Mira capovolge la situazione. Trasforma gli agenti da esperimenti affascinanti ma caotici in attori economici affidabili. Immagina DAO gestiti da intelligenze verificate, strategie DeFi che non possono allucinare il rischio, compiti del mondo reale eseguiti con certezza crittografica. La bellezza della saga Lobstar? La pubblicità dell'errore ha fatto salire il token, le commissioni sono tornate e il portafoglio si è in gran parte ripreso, dimostrando che questi agenti sono stranamente resilienti. Ma la resilienza senza affidabilità è gioco d'azzardo. Mira fornisce il binario mancante: fiducia a livello architettonico. In un mondo che corre verso l'autonomia totale, dimenticare non è carino. È costoso. Mira Network assicura che l'AI ricordi ciò che conta di più perché il futuro dell'intelligenza non sarà costruito sulla speranza. Sarà costruito sulla verifica.

@Mira - Trust Layer of AI #Mira #mira $MIRA