L'intelligenza artificiale sembra quasi magica oggi. Scrive, analizza, codifica, riassume e persino ragiona in modi che sembravano impossibili solo pochi anni fa. Ma chiunque usi l'IA regolarmente conosce la scomoda verità: può sembrare incredibilmente sicura mentre è completamente sbagliata. Quel divario tra intelligenza e affidabilità è piccolo nell'uso casuale, ma nella finanza, nella sanità, nella governance o nei sistemi autonomi, diventa critico.

La Mira Network è costruita attorno a questo esatto problema. Invece di cercare di creare un modello più intelligente, pone una domanda più importante: come possiamo rendere affidabili i risultati dell'IA?

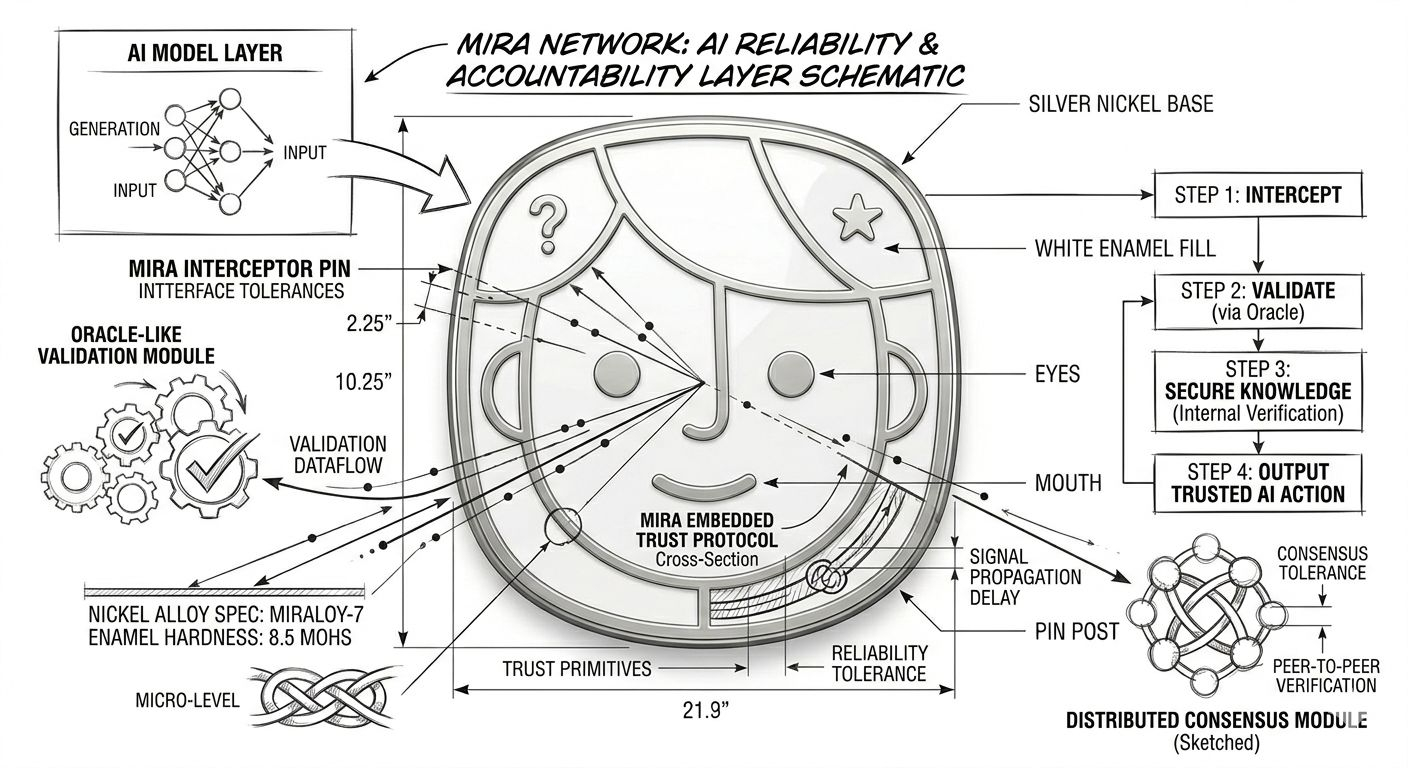

Alla base, Mira è un protocollo di verifica decentralizzato. L'idea non è quella di sostituire i modelli di intelligenza artificiale, ma di renderli responsabili. Quando un'IA genera una risposta, Mira suddivide quel risultato in affermazioni più piccole e verificabili. Queste affermazioni vengono poi controllate da più validatori indipendenti di IA attraverso la rete. Invece di fidarsi di un solo fornitore o di un solo sistema, la rete raggiunge un consenso attraverso una verifica distribuita sostenuta da incentivi economici.

Questo approccio cambia il modo in cui pensiamo alla fiducia nell'IA. Oggi, ci fidiamo dell'IA principalmente perché ci fidiamo dell'azienda che la sostiene. Mira sposta quella fiducia verso un sistema trasparente e economicamente garantito. I risultati della verifica vengono registrati sulla catena, creando una traccia di audit immutabile. Se qualcosa viene convalidato, non è solo “creduto”: è rinforzato economicamente e registrato crittograficamente.

L'architettura è pratica e stratificata. Un'IA genera una risposta. Quella risposta viene scomposta in affermazioni specifiche. I validatori indipendenti esaminano quelle affermazioni. Le loro valutazioni vengono confrontate, si raggiunge un consenso e i risultati vengono definiti sulla catena. I validatori scommettono $MIRA token per partecipare. Se validano onestamente e si allineano a un consenso accurato, guadagnano ricompense. Se si comportano in modo malevolo o negligente, rischiano di perdere la loro scommessa. Gli incentivi sono progettati per incoraggiare l'accuratezza, non un accordo a occhi chiusi.

Il token Mira gioca un ruolo centrale in questo sistema. Viene utilizzato per lo staking da parte dei validatori, per pagare i servizi di verifica e per partecipare alle decisioni di governance. Il suo valore non deve basarsi puramente sulla speculazione, ma sull'effettivo utilizzo della rete. Man mano che più applicazioni richiedono output di IA verificati, la domanda di verifica aumenta. Questa domanda alimenta direttamente l'utilità del token.

Ciò che rende interessante questo modello è il suo tempismo. L'IA viene rapidamente integrata in sistemi che prendono decisioni reali. Le imprese stanno implementando strumenti di IA in flussi di lavoro che influenzano l'allocazione del capitale, la conformità, l'analisi legale e l'automazione. Allo stesso tempo, i regolatori e le istituzioni pongono domande più difficili sulla trasparenza e la responsabilità. In questo ambiente, un livello di verifica decentralizzato diventa più di un esperimento: diventa infrastruttura.

Ci sono sfide reali. La verifica richiede risorse computazionali aggiuntive. Garantire la diversità dei validatori è importante per evitare punti ciechi condivisi. Scalabilità e latenza devono essere attentamente ottimizzate. Ma questi sono problemi ingegneristici, non debolezze concettuali. La base rimane solida: l'intelligenza senza verifica non può supportare l'autonomia su larga scala.

Il potenziale a lungo termine di Mira risiede nel diventare un livello di affidabilità predefinito per le applicazioni di IA. Proprio come gli oracoli blockchain sono diventati essenziali per garantire dati esterni nella finanza decentralizzata, Mira mira a garantire la conoscenza generata dall'IA prima che influenzi i risultati nel mondo reale. Si posiziona non come un concorrente dei modelli avanzati di IA, ma come il livello di responsabilità che li rende più sicuri da usare.

Il cambiamento più profondo qui è filosofico. Per anni, la corsa all'IA si è concentrata sul rendere i modelli più grandi e più capaci. Mira si concentra sul renderli affidabili. Man mano che i sistemi di IA iniziano a interagire tra loro, eseguire contratti intelligenti e operare autonomamente, la fiducia non può basarsi sulla reputazione del marchio o su un controllo centralizzato. Deve essere integrata nel sistema stesso.

Se l'IA deve alimentare infrastrutture critiche, ha bisogno di più dell'intelligenza. Ha bisogno di prove. La rete Mira sta costruendo quel livello di prova. E se il futuro dell'IA dipende dalla responsabilità tanto quanto dalla capacità, allora $MIRA diventa più di un token: diventa il meccanismo che impone la responsabilità delle macchine in un mondo decentralizzato.

@Mira - Trust Layer of AI #Mira $MIRA