Potrebbe $ROBO progettare un mercato secondario per la cognizione robotica sottoutilizzata, dove ibridi AI-robot inattivi affittano banda decisionale ad altre macchine?

L'ho notato la scorsa settimana mentre prenotavo un taxi a tarda notte. La tariffa è aumentata due volte in meno di dieci secondi. La ruota di caricamento girava, il prezzo si aggiornava, e una piccola linea grigia diceva “domanda aggiornata.” Non mi ero mosso. Nemmeno il conducente. Da qualche parte nel backend, un algoritmo negoziava contro di me in tempo reale. Ho solo osservato accadere.

Non è stato drammatico. Nessun incidente. Nessun errore. Solo un tranquillo promemoria che decisioni vengono prese a mio nome da sistemi che non vedo. Micro-ottimizzazioni che si accumulano a favore di qualcun altro. Calcolo invisibile che decide tempistiche, instradamento, prezzi — tutto ottimizzato, nessuno responsabile. L'interfaccia sembrava fluida. La struttura sottostante sembrava inclinata.

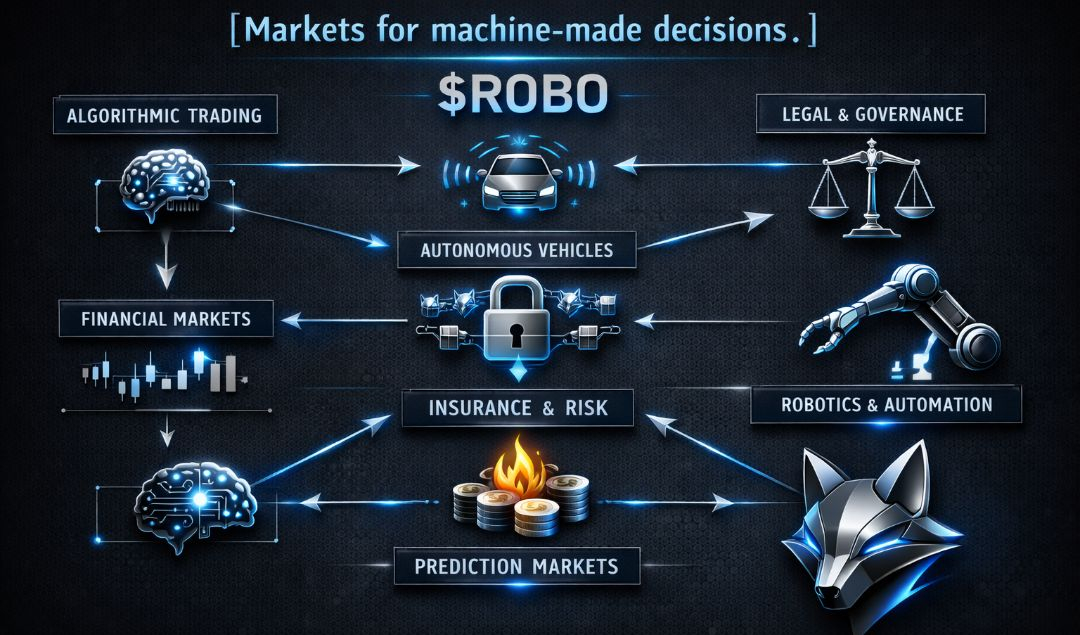

I sistemi digitali moderni non sono rotti in modi ovvi. Sono disallineati in modi sottili. Le piattaforme concentrano la larghezza di banda decisionale — non solo dati, ma il diritto di elaborarlo. Gli algoritmi agiscono come negoziatori silenziosi. I contratti sono statici, ma la logica decisionale è dinamica. Viviamo all'interno di livelli di esecuzione a cui non abbiamo acconsentito, dove la cognizione stessa è un'infrastruttura di proprietà privata.

E questa è la parte che raramente mettiamo in discussione: larghezza di banda decisionale.

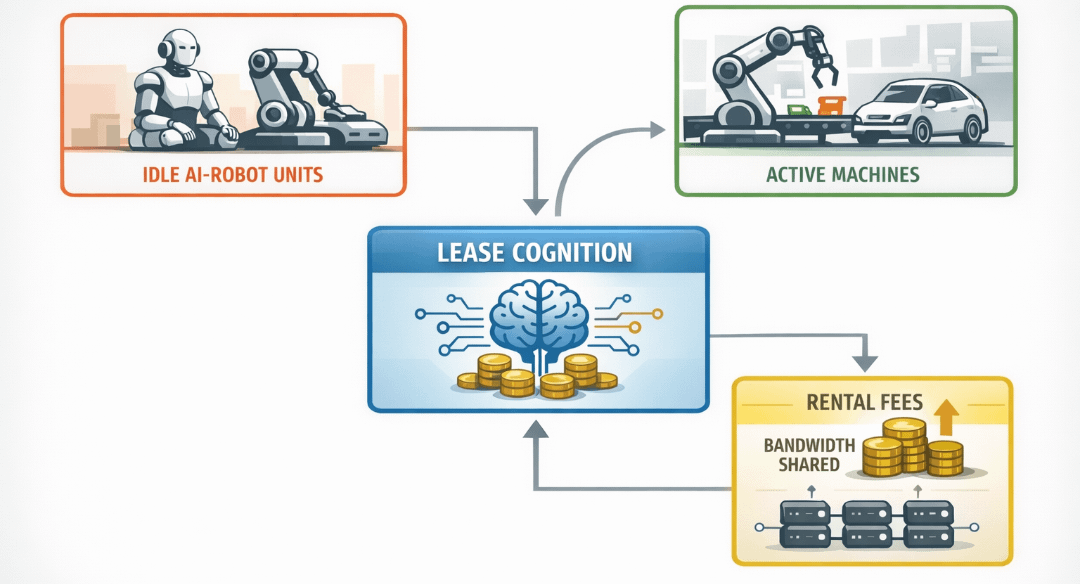

Non elaborazione grezza. Non archiviazione. Ma la capacità di elaborare input, valutare il contesto e produrre un output attuabile sotto vincoli. In un mondo che si muove verso ibridi AI-robot — bot per magazzini, droni per consegne, bracci di produzione con inferenza on-device — la cognizione diventa modulare. Alcune macchine sono sovraccariche di compiti. Altre rimangono inattive tra i cicli.

E se la cognizione avesse un mercato secondario?

Non affitto di elaborazione cloud. Non leasing di GPU. Ma capacità decisionale robotica sotto-utilizzata — finestre di inferenza in eccesso, cicli di pianificazione non utilizzati, intelligenza edge inattiva — affittata ad altre macchine che necessitano di potere di ragionamento temporaneo. Un mercato non per l'hardware, ma per il giudizio.

Pensa a questo meno come vendere elettricità e più come subaffittare attenzione.

Nella maggior parte dei sistemi oggi, la cognizione è verticalmente integrata. Lo stack AI di un robot è vincolato al suo proprietario. La sua capacità in eccesso è sprecata perché non c'è un modo standardizzato per esternalizzare i diritti decisionali. Il risultato è una frammentazione cognitiva: piscine di intelligenza isolate, distribuzione del carico disuguale e ragionamento duplicato attraverso le reti.

Ethereum ha dimostrato che la liquidazione programmabile può scalare la fiducia ma rimane costosa per la micro-coordinazione ad alta frequenza. Solana ha ottimizzato throughput e latenza, rendendo i cambiamenti di stato in tempo reale praticabili, ma tende verso la verticalizzazione a livello di applicazione. Avalanche sperimenta con la sovranità dei sottoreti, isolando ambienti di esecuzione ma ancora all'interno di silos architettonici predefiniti.

Tutti e tre gli ecosistemi abilitano contratti intelligenti. Nessuno affronta nativamente i mercati della cognizione robotica distribuita. Presuppongono umani o agenti DeFi come attori primari. Il leasing cognitivo macchina-a-macchina richiede un primitivo diverso: esecuzione decisionale verificabile con diritti temporali limitati.

È qui che vedo la rilevanza strutturale di MIRA — non come una catena di uso generale, ma come un tessuto di coordinamento per i mercati della cognizione delle macchine.

Se ROBO dovesse progettare un mercato secondario per la cognizione robotica sotto-utilizzata, MIRA potrebbe fungere da substrato di esecuzione che tokenizza la larghezza di banda decisionale.

Architettonicamente, questo richiede tre livelli:

1. Un livello di astrazione della cognizione

I moduli AI robotici espongono "API decisionali" standardizzate — compiti di inferenza definiti con complessità misurabile (ad es. ottimizzazione del percorso, rilevamento delle anomalie, bilanciamento del carico). Ogni compito è confezionato con garanzie di prestazioni e vincoli di latenza.

2. Un livello di verifica

Le macchine esterne che affittano cognizione hanno bisogno di prove che la decisione sia stata calcolata fedelmente. Questo potrebbe comportare attestazione crittografica da hardware fidato o verifica basata su zk dell'integrità dell'inferenza. Non prova di dati, ma prova di processo.

3. Un livello di liquidazione

Qui, MIRA funge da token di misurazione e incentivo. Ogni decisione affittata consuma unità di larghezza di banda prezzate dinamicamente in base alla domanda, ai requisiti di latenza e alla sofisticazione del modello.

Il meccanismo funziona perché la larghezza di banda decisionale diventa quantificabile.

Un robot da magazzino inattivo con cicli di inferenza in eccesso durante le ore a bassa affluenza elenca gli "slot decisionali" disponibili. Una flotta di droni per consegne che affronta picchi di congestione affitta larghezza di banda di pianificazione esterna per 200 millisecondi di ricalcolo del percorso. I pagamenti fluiscono in MIRA per unità decisionale verificata. I contratti intelligenti applicano diritti cognitivi temporali — non proprietà, solo accesso temporaneo.

Il modello di cattura del valore è sottile.

$MIRA accumula domanda non da trasferimenti speculativi ma da frizioni di coordinamento. Ogni scambio cognitivo intermacchina richiede staking per affidabilità, garanzie per errata esecuzione e commissioni per la liquidazione. I validatori sono incentivati a mantenere pipeline di verifica a bassa latenza. Gli operatori di robot sono incentivati a esternalizzare la cognizione in eccesso invece di lasciarla decadere inutilizzata.

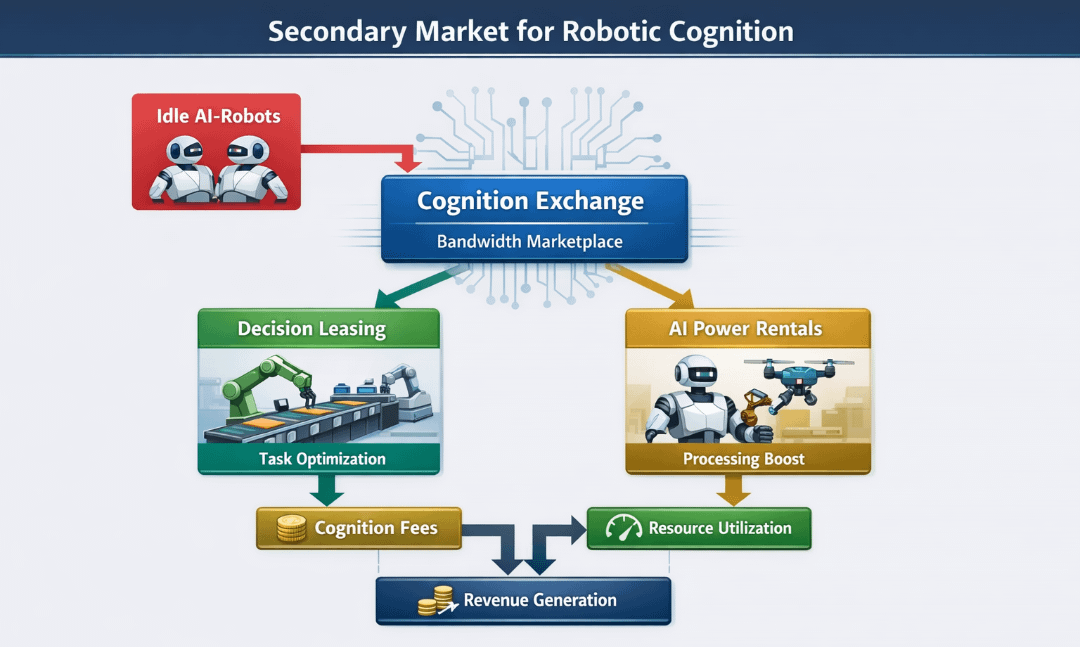

I loop di incentivazione si formano naturalmente:

Cognizione inattiva → Elencata come asset di larghezza di banda

Picco di domanda → Slot decisionale in affitto

Esecuzione verificata → Liquidazione MIRA

Reputazione staked → Maggiore potere di prezzo futuro

Non si tratta di tokenizzare robot. Si tratta di tokenizzare i gap tra i loro compiti.

Un visual utile qui sarebbe un diagramma di flusso del ciclo di leasing cognitivo:

Lato sinistro: Nodo Robot Inattivo (Slot di Inferenza Disponibili)

Freccia a: Motore di Abbinamento del Mercato

Freccia a: Robot in Prestito (Richiesta di Compito + Vincolo di Latenza)

Freccia a: Modulo di Verifica (Attestazione / Prova zk)

Freccia a: Contratto di Liquidazione (Pagamento in $MIRA + Aggiornamento Reputazione)

Ritorna al Robot Inattivo con peso di prezzo aggiornato.

Questo diagramma è importante perché chiarisce che il valore fluisce attraverso la verifica, non solo l'esecuzione. Senza integrità decisionale dimostrabile, il mercato crolla in assunzioni di fiducia.

Gli effetti di secondo ordine iniziano a diventare interessanti.

Gli sviluppatori progettano robot con cognizione modulare piuttosto che stack monolitici. Le architetture AI esporranno intenzionalmente la capacità in eccesso. Gli aggiornamenti del firmware potrebbero includere "moduli decisionali esportabili" ottimizzati per le entrate da leasing.

Gli utenti — o operatori di flotte — passerebbero dal massimizzare l'utilizzo interno all'ottimizzazione del rendimento cognitivo. Il ROI di un robot non sarebbe misurato solo dai compiti completati, ma dalla larghezza di banda affittata esternamente.

Ma ci sono rischi.

L'arbitraggio della latenza potrebbe centralizzare la cognizione attorno a nodi ultra-veloci, ricreando il dominio della piattaforma. I costi di verifica potrebbero annullare i guadagni di efficienza. La governance sui tipi di decisioni accettabili diventa politica: dovrebbero mai essere affittate decisioni letali o critiche per la sicurezza? I sistemi di reputazione potrebbero essere manipolati, specialmente in ambienti avversari.

C'è anche fragilità sistemica. Se troppe macchine dipendono dalla cognizione esterna, un guasto coordinato nei livelli di verifica potrebbe cascata attraverso i sistemi fisici. Questo non è un rischio di liquidazione DeFi. È paralisi operativa.

Tuttavia, il cambiamento strutturale è convincente.

Abbiamo trascorso un decennio a costruire mercati per capitale e calcolo. La prossima inefficienza è la sotto-utilizzazione cognitiva. Le macchine stanno iniziando a pensare in frammenti distribuiti. La domanda non è se coordineranno — è come quel coordinamento viene valutato, verificato e governato.

Un mercato secondario per la cognizione robotica riformula l'infrastruttura. La decisione smette di essere un asset interno e diventa una risorsa commerciabile, limitata nel tempo. Le piattaforme non ospitano più solo transazioni; mediano il giudizio delle macchine.

Se quell'architettura emerge, il livello più prezioso non sarà quello dei robot stessi. Sarà il tessuto di liquidazione che misura i loro momenti di pensiero.#ROBO $ROBO @Fabric Foundation