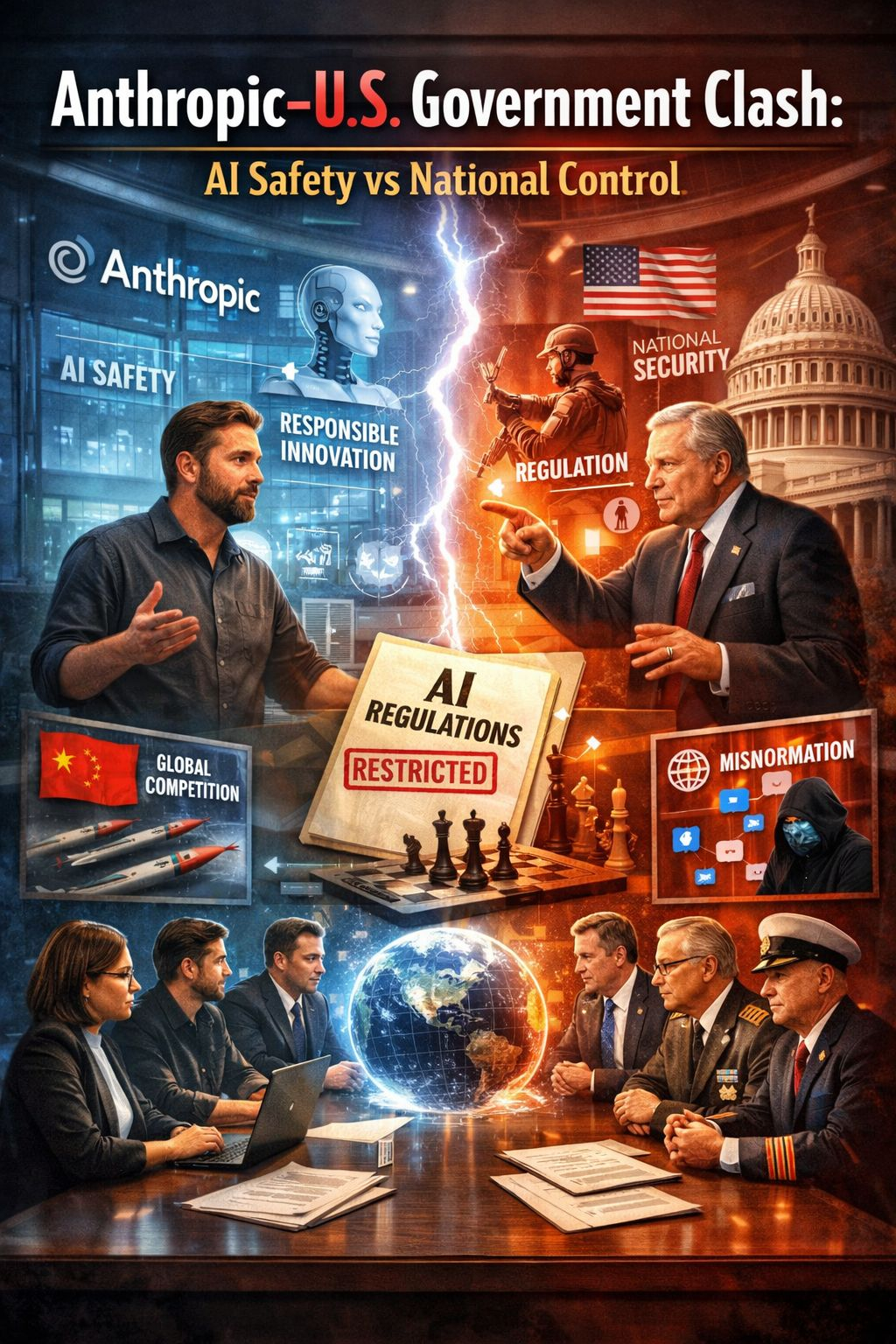

La crescente tensione tra le aziende di intelligenza artificiale e i regolatori ha raggiunto una nuova fase con il conflitto emergente tra Anthropic e il governo degli Stati Uniti. Al centro del dibattito c'è come i sistemi di IA avanzata dovrebbero essere governati e chi controlla infine il loro utilizzo.

Anthropic, nota per il suo forte impegno per la sicurezza e l'allineamento dell'IA, ha sostenuto una scalabilità responsabile, la trasparenza e standard di valutazione rigorosi prima di rilasciare modelli potenti.

Tuttavia, i funzionari statunitensi sono sempre più preoccupati per i rischi per la sicurezza nazionale, la disinformazione e la possibilità che l'IA avanzata possa essere abusata da attori ostili.

Questo ha portato a proposte per una supervisione più rigorosa, rapporti obbligatori sulla sicurezza e potenziali requisiti di licenza per i sistemi di IA all'avanguardia.

Il disaccordo evidenzia un conflitto più ampio: la velocità dell'innovazione contro la cautela regolamentare.

Le aziende tecnologiche sostengono che una regolamentazione eccessiva potrebbe rallentare la competitività americana rispetto ai rivali globali, in particolare la Cina, mentre i responsabili politici sottolineano che lo sviluppo incontrollato dell'IA potrebbe creare rischi sistemici che influenzano le elezioni, la cybersicurezza e la stabilità economica.

Gli osservatori del settore credono che l'esito di questo scontro potrebbe plasmare gli standard di governance globale dell'IA.

Se emergono regole più severe, potrebbero creare un precedente su come le nazioni democratiche bilanciano l'innovazione con la sicurezza pubblica. Man mano che le capacità dell'IA evolvono rapidamente, la disputa del governo statunitense con Anthropic segnala un momento decisivo nel determinare il futuro rapporto tra i costruttori di tecnologia e l'autorità statale.

#AnthropicUSGovClash #BlockAILayoffs #GIVEAWAY #RedPacketMission #TrendingTopic