Immagina un mondo in cui il tuo medico guidato dall'IA prescrive farmaci basati su un'allucinazione, o un bot di trading DeFi liquida il tuo portafoglio perché ha interpretato male un singolo punto decimale in un contratto intelligente.

Mentre ci avviciniamo a un futuro dominato dall'IA, abbiamo colpito un muro silenzioso ma mortale: il divario di fiducia. L'IA moderna è brillante, ma è anche una scatola nera capace di "allucinare" fatti con assoluta sicurezza. È qui che entra in gioco Mira Network, non come un altro chatbot, ma come il primo "Strato di Verità" decentralizzato per l'Intelligenza Artificiale.

Oltre il Rumore: Come Funziona Davvero Mira

La maggior parte dei progetti di IA si concentra sul rendere i modelli più veloci o più grandi. Mira si concentra sul renderli onesti. Tratta le uscite dell'IA come un tribunale piuttosto che una singola fonte di verità.

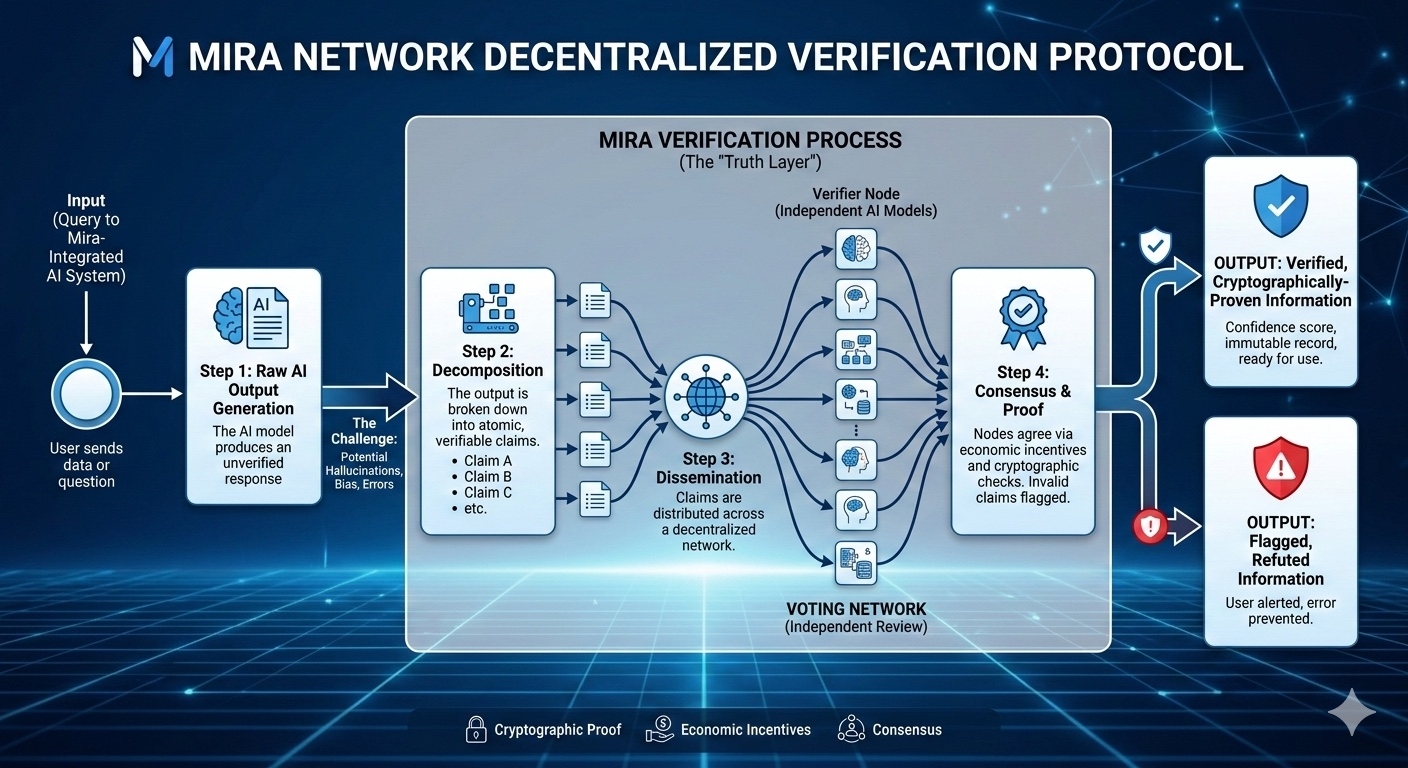

Quando fai una domanda a un sistema integrato con Mira, non ti fornisce solo una risposta e spera per il meglio. Inizia una "Maratona di Consenso":

1. Decomposizione: La risposta dell'IA viene suddivisa in piccole, atomiche "affermazioni."

2. La Giuria Cieca: Queste affermazioni sono sparse in una rete globale di nodi verificatori indipendenti (che eseguono modelli come GPT-4, Llama e DeepSeek).

3. Prova Crittografica: Questi nodi non vedono l'intero quadro, solo il pezzo che stanno verificando. Devono raggiungere un consenso. Se il 95% della "giuria" è d'accordo, viene rilasciato un certificato crittografico di verità.

Il "Flusso Visivo" della Verità:

Scenario Reale: Il Salvatore "Fat Finger" di DeFi

Diamo un'occhiata a un caso d'uso del mondo reale che coinvolge Gigabrain, una piattaforma di trading integrata con Mira.

In un'impostazione tradizionale, un'IA potrebbe analizzare una tendenza di mercato e suggerire: "Compra Token X; ha un volume di 24 ore di $500M." Ma cosa succede se l'IA ha allucinato quel volume? In un attimo, un bot automatico potrebbe scaricare milioni in un asset fantasma.

Con Mira, quella affermazione di "500M di volume" viene inviata alla rete. I nodi verificatori controllano i dati on-chain in tempo reale. Se i dati sono falsi, la richiesta viene segnalata, la transazione viene bloccata e i fondi dell'utente vengono salvati. Mira non è solo tecnologia; è una polizza assicurativa economica per i tuoi dati.

Perché il $MIRA Token è il "Gas della Verità"

Il token ($MIRA) non è solo per speculazioni; è il carburante fisico del motore di verifica:

• Prova di Inferenza: A differenza dei miner di Bitcoin che risolvono matematica inutile, i nodi di Mira fanno "Lavoro Significativo." Eseguono inferenze IA per verificare le affermazioni.

• Staking e Slashing: I nodi devono mettere in staking $MIRA. Se forniscono verifiche pigre o false, perdono il loro stake. Questo crea un ambiente ad alto rischio in cui l'onestà è l'unica strategia redditizia.

• L'Hub dell'Ecosistema: Con app come Klok AI che già elaborano 3 miliardi di token al giorno, $MIRA funge da mezzo di scambio per ogni query di verifica eseguita in tutto il mondo.

Analisi della Condivisione Mentale: Il Cambiamento Infrastrutturale

Mentre molti "token IA" sono solo involucri per API esistenti, Mira sta costruendo l'infrastruttura di verifica. Pensala in questo modo: se Ethereum è il computer decentralizzato del mondo, Mira è l'auditor decentralizzato del mondo.

Il progetto ha già scalato a 4 milioni di utenti durante la sua fase di testnet, gestendo 19 milioni di query settimanali. Questo non è un progetto "presto"; è un'infrastruttura "adesso". Man mano che l'industria si sposta dall'IA Generativa (creare cose) all'IA Agente (fare cose), la necessità di un protocollo che possa dire "Sì, questa azione è sicura e vera" sarà la merce più preziosa in Web3.

Riflessioni Finali: La Nuova Era della Sovranità dell'IA

Stiamo allontanandoci da un mondo in cui ci fidiamo ciecamente dell'"IA Centralizzata" (Big Tech) e ci stiamo muovendo verso l'IA Verificata. La Rete Mira sta guidando questa iniziativa assicurando che il futuro dell'intelligenza sia trasparente, decentralizzato e, soprattutto, affidabile.

La domanda non è più "Cosa può fare l'IA?" ma "Possiamo fidarci di ciò che fa l'IA?"

Cosa pensi sia il rischio più grande dell'IA non verificata nella tua vita quotidiana: errori finanziari, disinformazione medica o qualcos'altro del tutto?

@Mira - Trust Layer of AI #Mira #mira $MIRA