Potrebbe $MIRA tokenizzare le dispute AI irrisolte in mercati di ricompensa avversariali dove la verità minoritaria alla fine supera il consenso della maggioranza?

La scorsa settimana stavo regolando un avviso di prezzo su un'app di trading che uso quotidianamente. Lo schermo si è bloccato per un secondo — quella piccola ruota di caricamento ordinaria. Quando si è aggiornato, il prezzo era leggermente cambiato e la mia soglia di avviso si era auto-regolata “per la volatilità del mercato.” Non l'avevo approvato. Non c'era nessun pop-up, solo una decisione di backend travestita da ottimizzazione. Più tardi, ho notato una piccola commissione ricalcolata nell'anteprima della transazione — routing dinamico, diceva il tooltip. Funzionava tutto. Nulla si è rotto. Ma qualcosa sembrava silenziosamente disallineato.

Non è stata una falla drammatica. Era un'asimmetria strutturale. Il sistema poteva reinterpretare la mia intenzione più velocemente di quanto potessi verificarla. Gli algoritmi stavano negoziando per mio conto, i contratti erano modificabili nella pratica se non nel codice, e la “migliore esecuzione” definita dalla maggioranza sostituiva la preferenza individuale. L'interfaccia sembrava consensuale. Il backend non lo era.

I sistemi digitali moderni non collassano; driftano. Il potere si centralizza attorno a chiunque controlli l'interpretazione. Il modello decide cosa conta come segnale. La piattaforma decide cosa conta come contestazione. La maggior parte degli utenti non vede mai la contesa sulla verità — vedono un output risolto. Il consenso della maggioranza, spesso statistico o aziendale, si indurisce in realtà predefinita.

Ecco il modello mentale a cui continuo a tornare: un'aula di tribunale in cui il verdetto viene emesso prima che le prove della minoranza possano accumularsi.

In questa aula di tribunale, la verità non è binaria. È temporale. Il consenso precoce vince per velocità, non necessariamente per accuratezza. Le posizioni di minoranza — il dataset dissenziente, il modello contrarian, l'audit di casi limite — hanno bisogno di tempo e incentivo per emergere. Ma il sistema chiude rapidamente il caso perché la latenza è costosa. Così il consenso della maggioranza diventa strutturalmente privilegiato, anche se fragile.

Le blockchain hanno cercato di affrontare questo spostando la validazione all'esterno. Su Ethereum, il consenso è costoso ma deliberato — le dispute vengono risolte attraverso la trasparenza e la partecipazione pesata dal gas. Solana ottimizza per il throughput, comprimendo il disaccordo nelle prestazioni. Avalanche sperimenta con il consenso probabilistico, convergendo rapidamente attraverso il campionamento ripetuto.

Ogni architettura codifica una filosofia di risoluzione della verità. Ethereum tollera attriti per preservare l'auditabilità. Solana minimizza gli attriti per preservare la velocità. Avalanche cerca di approssimare statisticamente la convergenza. Ma tutti assumono ancora che il consenso sia il punto finale. Il disaccordo è una fase da risolvere, non una risorsa da tokenizzare.

È qui che penso che MIRA introduca qualcosa di strutturalmente diverso — non un'altra catena di consenso, ma un protocollo di strato di contestazione.

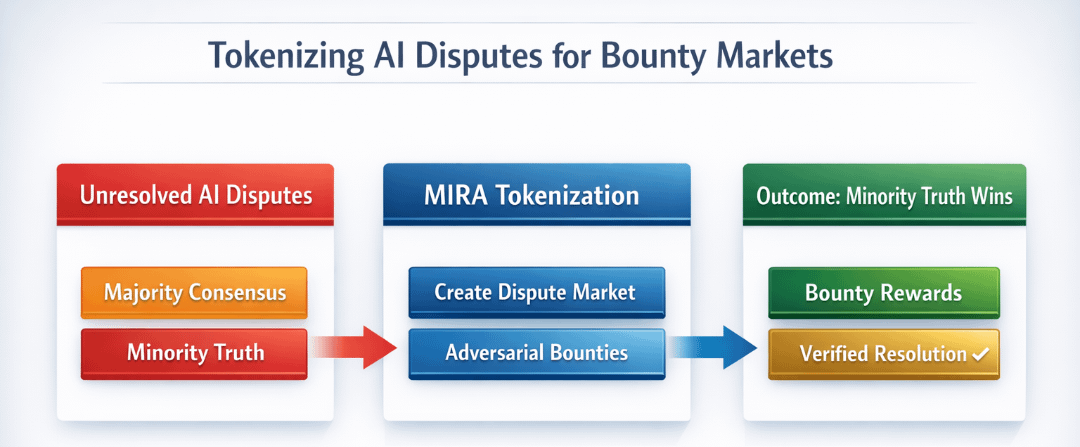

La tesi non riguarda la decentralizzazione. Riguarda i mercati avversariali per output di IA non risolti.

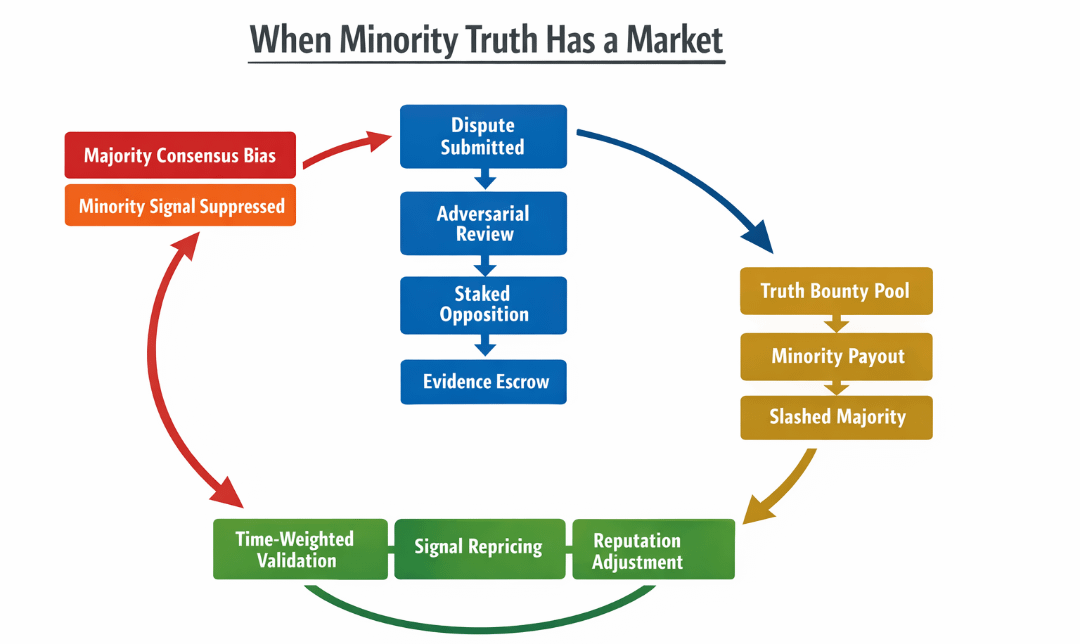

Invece di chiedere “qual è la risposta della maggioranza?”, immagina di chiedere “cosa è disposto a mettere in stake la minoranza contro la maggioranza?”. MIRA potrebbe tokenizzare le dispute non risolte dell'IA in mercati di bounty avversariale. Ogni decisione contestata dell'IA — chiamata di moderazione, inferenza del modello, classificazione delle frodi — diventa un mercato in cui le rivendicazioni di minoranza possono postare contro-verifica supportata da stake.

Meccanismo prima, ciò implica tre strati.

Primo: un substrato di verifica. Gli output dell'IA non sono finali; sono proposte. Queste proposte vengono hashate, timestampate e instradate in pool di disputa se sfidate. Il protocollo non assume correttezza. Assume contestabilità.

Secondo: mercati di staking avversariale. Attori di minoranza — revisori, modelli alternativi, esperti del settore — possono mettere in stake token MIRA per sfidare l'output della maggioranza. Se la loro contro-reclamo viene successivamente convalidato (attraverso prove ritardate, modelli migliorati o dati esterni), catturano un pool di ricompense finanziato dai partecipanti al consenso iniziale e dalle emissioni del protocollo.

Terzo: ricalibrazione del consenso adattivo. Il protocollo tiene traccia dell'accuratezza storica dei partecipanti, pesando le dispute future non per identità ma per stake aggiustato per prestazioni. La reputazione diventa economicamente quantificata senza guardiani centrali.

$MIRA, in questo design, non è solo un token di tassa. Diventa collaterale per il rischio epistemico. Possedere MIRA significa che puoi sottoscrivere dissenso.

Il ciclo di incentivo è importante.

Gli attori del consenso della maggioranza guadagnano ricompense di base per una validazione rapida. I sfidanti della minoranza guadagnano un upside asimmetrico se identificano punti ciechi strutturali. Il protocollo cattura valore attraverso tasse di disputa e spread di staking.

L'architettura crea un mercato di feedback dove la verità della minoranza si accumula invece di essere soppressa.

Un visual utile sarebbe un diagramma di flusso del ciclo di incentivo:

Output IA → Pool di Validazione della Maggioranza → Finestra di Disputa Apre → Stake di Minoranza MIRA → Invio di Prove → Riconciliazione Ritardata → Redistribuzione delle Ricompense (alla parte accurata) → Aggiornamento del Punteggio di Reputazione.

Questo diagramma è importante perché mostra che il disaccordo non è un'anomalia; è un input economico. Il valore fluisce attraverso il conflitto, non attorno ad esso.

Gli effetti di secondo ordine iniziano a emergere rapidamente.

Gli sviluppatori che costruiscono sistemi di intelligenza artificiale su un tale strato progettano per la contestabilità. Invece di nascondere l'incertezza del modello, potrebbero esporre intervalli di confidenza per attrarre liquidità di contestazione. Le interfacce utente potrebbero mostrare “mercati di dissenso attivi” accanto agli output. La trasparenza diventa redditizia, non solo etica.

Gli utenti passano da consumatori passivi delle decisioni dell'IA a potenziali sottoscrittori della contro-verità. Se non sono d'accordo con una decisione di moderazione o un punteggio di rischio, non mi limito a lamentarmi — metto in stake. Questo cambia il comportamento. Filtra il rumore perché il dissenso ora comporta un costo. Ma potenzia anche le minoranze informate.

Ci sono rischi.

I mercati avversariali possono essere manipolati. Attori coordinati potrebbero fabbricare dispute per estrarre emissioni. Partecipanti facoltosi potrebbero dominare lo staking di minoranza, trasformando il dissenso in plutocrazia. Se la risoluzione delle dispute dipende da dati esterni o feed oracle, emergono nuove dipendenze di fiducia. E c'è uno strato psicologico: la costante contestabilità potrebbe rallentare l'adozione per gli utenti che preferiscono la semplicità rispetto ai mercati epistemici.

C'è anche la possibilità che il consenso della maggioranza rimanga corretto per la maggior parte del tempo. In tal caso, lo staking della minoranza diventa un gioco perdente, e la liquidità si esaurisce. Il protocollo avrebbe bisogno di aggiustamenti dinamici delle ricompense per prevenire l'ossificazione.

Tuttavia, il cambiamento strutturale è significativo. La maggior parte dei sistemi ottimizza per la velocità di convergenza. $MIRA, come strato di tokenizzazione della contestazione, ottimizzerebbe per l'accuratezza epistemica a lungo termine. Assume che la verità non sia un voto; è un risultato di mercato pesato nel tempo.

Se quel modello regge, la minoranza non ha bisogno di essere forte. Ha bisogno di essere solvente.

Ciò che mi ha turbato riguardo a quell'allerta di prezzo auto-regolata non era la tassa o il ritardo. Era la chiusura silenziosa della possibilità. Il sistema ha deciso cosa contava come ottimale e ha proseguito.

Tokenizzare le dispute non risolte dell'IA riformula quella chiusura. Mantiene il caso aperto — non indefinitamente, ma economicamente. Dà alla verità di minoranza una pista lunga abbastanza per superare il consenso della maggioranza quando la maggioranza ha torto.

In un mondo in cui gli algoritmi decidono sempre più gli esiti prima che gli esseri umani lo notino, l'architettura che conta di più non è un consenso più veloce. È dissenso strutturato con un investimento in gioco.

E questo cambia cosa intendiamo per validazione.