Auteur : 0xjacobzhao | https://linktr.ee/0xjacobzhao

Ce rapport indépendant est soutenu par IOSG Ventures, merci à Hans (RoboCup Asie-Pacifique), Nichanan Kesonpat (1kx), Robert Koschig (1kx), Amanda Young (Collab+Currency), Jonathan Victor (Ansa Research), Lex Sokolin (Generative Ventures), Jay Yu (Pantera Capital), Jeffrey Hu (Hashkey Capital) pour leurs précieux conseils sur cet article. Au cours de la rédaction, des avis et des retours d'opinion ont également été sollicités auprès des équipes de projets tels qu'OpenMind, BitRobot, peaq, Auki Labs, XMAQUINA, GAIB, Vader, Gradient, Tashi Network et CodecFlow. Cet article s'efforce de présenter un contenu objectif et précis, certaines opinions impliquant un jugement subjectif, il est inévitable qu'il y ait des biais, nous prions les lecteurs de bien vouloir comprendre.

I. Panorama des robots : de l'automatisation industrielle à l'intelligence humanoïde

La chaîne d'approvisionnement traditionnelle des robots a formé un système stratifié complet de bas en haut, couvrant quatre étapes clés : composants essentiels - systèmes de contrôle intermédiaire - fabrication d'appareils complets - intégration d'applications. Les composants essentiels (contrôleurs, servos, réducteurs, capteurs, batteries, etc.) ont la plus haute barrière technologique, déterminant les performances et le coût minimal de l'appareil complet ; le système de contrôle est le « cerveau et le petit cerveau » du robot, responsable de la planification décisionnelle et du contrôle de mouvement ; la fabrication d'appareils complets reflète la capacité d'intégration de la chaîne d'approvisionnement. L'intégration système et l'application déterminent la profondeur de la commercialisation et deviennent de plus en plus le cœur de valeur.

En fonction des scénarios d'application et des formes, les robots mondiaux évoluent le long d'un chemin de « l'automatisation industrielle → l'intelligence scénaristique → l'intelligence générale », formant cinq types principaux : robots industriels, robots mobiles, robots de service, robots spécialisés et robots humanoïdes.

Robots industriels (Industrial Robots) : actuellement le seul segment entièrement mature, largement utilisé dans le soudage, l'assemblage, la peinture et le transport dans les étapes de fabrication. L'industrie a établi un système de chaîne d'approvisionnement standardisé, avec des marges bénéficiaires stables et un ROI clair. Parmi eux, les robots collaboratifs (Cobots) mettent l'accent sur la collaboration homme-machine, sont légers et faciles à déployer, et connaissent la croissance la plus rapide. Entreprises représentatives : ABB, Fanuc, Yaskawa, KUKA, Universal Robots, JAKA, Aubo.

Robots mobiles (Mobile Robots) : comprenant AGV (véhicules à guidage automatique) et AMR (robots mobiles autonomes), déployés à grande échelle dans la logistique d'entrepôt, la livraison de commerce électronique et le transport manufacturier, devenant la catégorie la plus mature pour le B2B. Entreprises représentatives : Amazon Robotics, Geek+, Quicktron, Locus Robotics.

Robots de service (Service Robots) : visant les secteurs du nettoyage, de la restauration, de l'hôtellerie et de l'éducation, c'est le domaine à la croissance la plus rapide pour les consommateurs. Les produits de nettoyage ont déjà pénétré la logique de l'électronique grand public, tandis que les livraisons médicales et commerciales accélèrent leur commercialisation. De plus, un certain nombre de robots d'opération plus généralistes émergent (comme le système à deux bras de Dyna) - plus flexibles que les produits spécifiques à des tâches, mais n'atteignant pas encore l'universalité des robots humanoïdes. Entreprises représentatives : Ecovacs, Roborock, Pudu Technology, Qianlong Intelligent, iRobot, Dyna, etc.

Robots spécialisés, servant principalement les scénarios médicaux, militaires, de construction, maritimes et aérospatiaux, ont une taille de marché limitée mais une forte rentabilité et des barrières élevées, dépendant principalement des commandes gouvernementales et d'entreprise, se développant dans des segments verticaux. Projets typiques incluent Intuition Surgery, Boston Dynamics, ANYbotics, NASA Valkyrie, etc.

Robots humanoïdes (Humanoid Robots) : considérés comme la future « plateforme de main-d'œuvre universelle ». Les entreprises représentatives incluent Tesla (Optimus), Figure AI (Figure 01), Sanctuary AI (Phoenix), Agility Robotics (Digit), Apptronik (Apollo), 1X Robotics, Neura Robotics, Unitree, UBTECH, Zhiyuan Robotics, etc.

Les robots humanoïdes sont actuellement la direction avant-gardiste la plus surveillée, leur valeur centrale résidant dans leur structure humanoïde s'adaptant à l'espace social existant, considérée comme une forme clé vers la création d'une « plateforme de main-d'œuvre universelle ». Contrairement aux robots industriels cherchant une efficacité maximale, les robots humanoïdes mettent l'accent sur l'adaptabilité générale et la capacité de migration des tâches, pouvant entrer dans des usines, des foyers et des espaces publics sans modifier l'environnement.

Actuellement, la plupart des robots humanoïdes sont encore au stade de démonstration technique, vérifiant principalement l'équilibre dynamique, la marche et les capacités d'opération. Bien que certains projets aient commencé des déploiements à petite échelle dans des scénarios d'usine hautement contrôlés (comme Figure × BMW, Agility Digit), et qu'il soit prévu que davantage de fabricants (comme 1X) entrent dans la distribution précoce dès 2026, cela reste des applications limitées à des « scénarios étroits et des tâches uniques », plutôt qu'un véritable déploiement de main-d'œuvre général. Dans l'ensemble, la commercialisation à grande échelle nécessite encore plusieurs années. Les goulets d'étranglement principaux incluent : des problèmes de contrôle comme la coordination à plusieurs degrés de liberté et l'équilibre dynamique en temps réel ; des problèmes de consommation et d'autonomie liés à la densité d'énergie des batteries et à l'efficacité des moteurs ; des chaînes de perception-décision instables, difficiles à généraliser dans des environnements ouverts ; un manque de données significatif (difficiles à soutenir pour un entraînement de politique générale) ; la migration entre formes n'a pas encore été maîtrisée ; et les courbes de coût et de chaîne d'approvisionnement du matériel, en particulier en dehors de la Chine, constituent toujours une barrière réelle, rendant encore plus difficile la réalisation de déploiements à grande échelle et à faible coût.

On s'attend à ce que le chemin commercial futur passe par trois étapes : à court terme, principalement basé sur le service Démo-en-Service, dépendant des projets pilotes et des subventions ; à moyen terme, évoluant vers la Robotique-en-Service (RaaS), construisant un écosystème de tâches et de compétences ; à long terme, avec un cœur basé sur le cloud de main-d'œuvre et des services d'abonnement intelligents, déplaçant le centre de valeur de la fabrication matérielle vers les réseaux de logiciels et de services. Dans l'ensemble, les robots humanoïdes sont à un tournant critique entre la démonstration et l'auto-apprentissage, et leur capacité à franchir les trois seuils du contrôle, du coût et de l'algorithme déterminera leur capacité à réaliser véritablement l'intelligence incarnée.

II. AI × Robots : l'aube de l'ère de l'intelligence incarnée

L'automatisation traditionnelle repose principalement sur une programmation préétablie et un contrôle en chaîne (comme l'architecture DSOP de perception-planification-contrôle), ne pouvant fonctionner de manière fiable que dans des environnements structurés. Le monde réel est bien plus complexe et changeant, la nouvelle génération d'intelligence incarnée (Embodied AI) emprunte un autre paradigme : grâce à de grands modèles et un apprentissage d'énoncés unifiés, les robots acquièrent la capacité de « compréhension-prévision-action » inter-scénarios. L'intelligence incarnée met l'accent sur le couplage dynamique corps (matériel) + cerveau (modèle) + environnement (interaction), les robots étant des véhicules tandis que l'intelligence est le cœur.

L'IA générative (Generative AI) appartient au monde du langage, excelle à comprendre les symboles et la sémantique ; l'intelligence incarnée (Embodied AI) appartient au monde réel, maîtrisant la perception et l'action. Les deux correspondent respectivement au « cerveau » et au « corps », représentant deux lignes parallèles dans l'évolution de l'IA. En termes de niveaux d'intelligence, l'intelligence incarnée est plus élevée que l'IA générative, mais sa maturité reste clairement en retard. Les LLM dépendent d'une énorme quantité de données sur Internet, formant un cycle clair de « données → puissance de calcul → déploiement » ; tandis que l'intelligence robotique nécessite des données de première personne, multimodales et fortement liées aux actions - y compris des trajectoires de télécommande, des vidéos à la première personne, des cartes spatiales, des séquences d'opération, etc., ces données n'existent pas naturellement et doivent être générées par des interactions réelles ou des simulations haute fidélité, les rendant donc plus rares et coûteuses. Bien que la simulation et les données synthétiques soient utiles, elles ne peuvent toujours pas remplacer les capteurs réels et l'expérience de mouvement, raison pour laquelle des entreprises comme Tesla et Figure doivent construire leurs propres usines de données de téléopération, et pourquoi des usines de marquage de données tierces apparaissent en Asie du Sud-Est. En bref : les LLM apprennent à partir de données existantes, tandis que les robots doivent « créer » des données en interagissant avec le monde physique. Dans les 5 à 10 prochaines années, les deux fusionneront profondément sur le modèle Vision-Language-Action et l'architecture des agents incarnés - les LLM s'occupant de la cognition de haut niveau et de la planification, tandis que les robots s'occupent de l'exécution réelle, formant une boucle bidirectionnelle entre données et actions, poussant ensemble l'IA à passer de l'« intelligence linguistique » à une véritable intelligence générale (AGI).

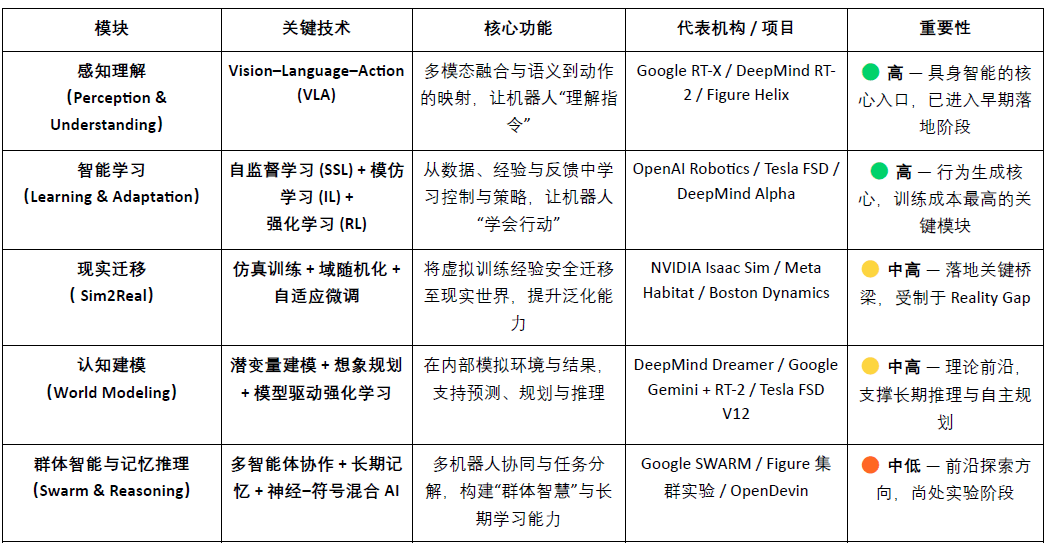

Le système technologique central de l'intelligence incarnée peut être considéré comme une pile intelligente ascendante : VLA (fusion perceptuelle), RL/IL/SSL (apprentissage intelligent), Sim2Real (migration réelle), World Model (modélisation cognitive), ainsi que la collaboration multi-agents et le raisonnement mémoriel (Swarm & Reasoning). Parmi ceux-ci, VLA et RL/IL/SSL sont le « moteur » de l'intelligence incarnée, déterminant sa mise en œuvre et sa commercialisation ; Sim2Real et World Model sont les technologies clés reliant la formation virtuelle et l'exécution réelle ; la collaboration multi-agents et le raisonnement mémoriel représentent une évolution de niveau supérieur des groupes et de la méta-cognition.

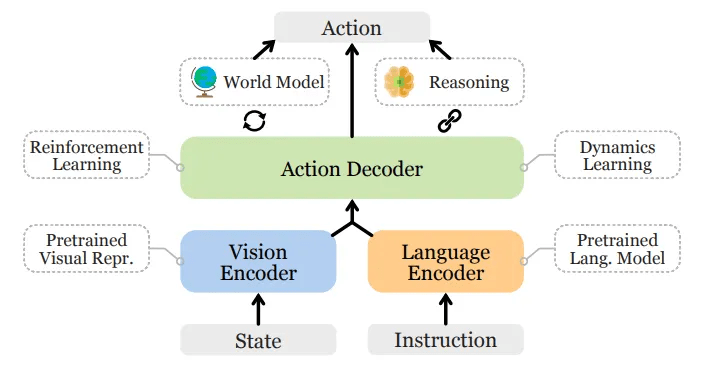

Compréhension perceptuelle : modèle visuel-langage-action (Vision-Language-Action)

Le modèle VLA intègre les trois canaux : vision (Vision) - langage (Language) - action (Action), permettant aux robots de comprendre les intentions humaines à partir du langage et de les transformer en comportements opérationnels concrets. Son processus d'exécution comprend l'analyse sémantique, la reconnaissance des objectifs (localisation d'objets cibles à partir des entrées visuelles) ainsi que la planification des chemins et l'exécution d'actions, réalisant ainsi le cycle « compréhension sémantique - perception du monde - accomplissement des tâches », représentant l'une des percées clés de l'intelligence incarnée. Les projets représentatifs actuels incluent Google RT-X, Meta Ego-Exo et Figure Helix, démontrant respectivement la compréhension multimodale, la perception immersive et le contrôle piloté par le langage.

Architecture générique du modèle Vision-Language-Action

Actuellement, VLA est encore à un stade précoce, faisant face à quatre types de goulets d'étranglement fondamentaux :

1) Ambiguïté sémantique et généralisation des tâches faibles : le modèle a du mal à comprendre les instructions floues et ouvertes ;

2) Alignement visuel et d'action instable : l'erreur de perception est amplifiée dans la planification et l'exécution des chemins ;

3) Données multimodales rares et normes non uniformes : les coûts de collecte et d'annotation sont élevés, rendant difficile la formation d'un effet de vol de données à grande échelle ;

4) Défis des axes temporels et spatiaux pour les tâches de longue durée : une durée de tâche trop longue entraîne une planification et des capacités de mémoire insuffisantes, tandis qu'une portée spatiale trop grande exige que le modèle raisonne sur des choses « hors de la vue », l'actuel VLA manquant de modèles mondiaux stables et de capacités de raisonnement inter-espaces.

Ces problèmes limitent ensemble la capacité de généralisation inter-scénarios et le processus de mise à l'échelle du VLA.

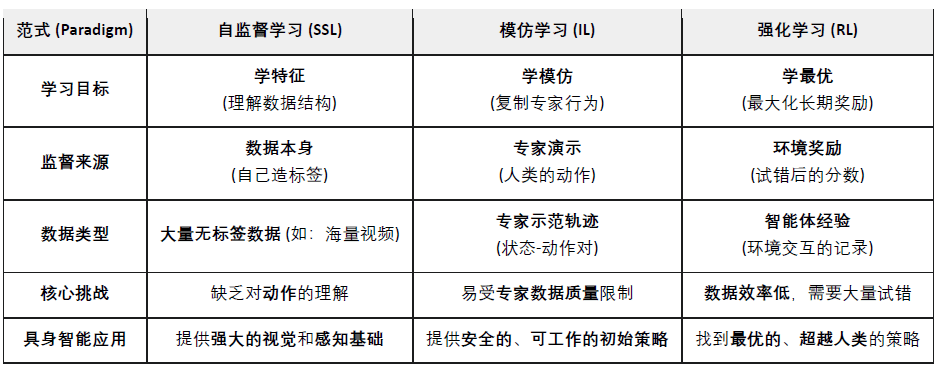

Apprentissage intelligent : apprentissage auto-supervisé (SSL), apprentissage par imitation (IL) et apprentissage par renforcement (RL)

Apprentissage auto-supervisé (Self-Supervised Learning) : extraire automatiquement des caractéristiques sémantiques des données de perception, permettant aux robots de « comprendre le monde ». Cela revient à apprendre aux machines à observer et à représenter.

Apprentissage par imitation (Imitation Learning) : acquérir rapidement des compétences de base en imitant des démonstrations humaines ou des exemples d'experts. Cela revient à apprendre aux machines à agir comme des humains.

Apprentissage par renforcement (Reinforcement Learning) : à travers un mécanisme de « récompense-pénalité », le robot optimise sa stratégie d'action en errant continuellement. Cela revient à apprendre aux machines à grandir par essai et erreur.

Dans l'intelligence incarnée (Embodied AI), l'apprentissage auto-supervisé (SSL) vise à permettre aux robots de prédire les changements d'état et les lois physiques à partir des données de perception, afin de comprendre la structure causale du monde ; l'apprentissage par renforcement (RL) est le moteur central de la formation de l'intelligence, optimisant les comportements complexes tels que la marche, la saisie, l'évitement par l'interaction avec l'environnement et des signaux de récompense ; l'apprentissage par imitation (IL) accélère ce processus en permettant aux robots d'acquérir rapidement des connaissances préalables d'action par démonstration humaine. La tendance actuelle consiste à combiner les trois pour construire un cadre d'apprentissage hiérarchique : le SSL fournissant une base de représentation, l'IL offrant un précédent humain, et le RL conduisant à l'optimisation des stratégies, équilibrant ainsi efficacité et stabilité, formant ensemble le mécanisme central de l'intelligence incarnée, de la compréhension à l'action.

Migration réelle : Sim2Real – Le saut de la simulation à la réalité

Sim2Real (Simulation to Reality) permet aux robots de s'entraîner dans un environnement virtuel, puis de migrer vers le monde réel. Il génère des données d'interaction à grande échelle via des environnements de simulation haute fidélité (comme NVIDIA Isaac Sim & Omniverse, DeepMind MuJoCo), réduisant considérablement les coûts d'entraînement et l'usure matérielle. Son cœur réside dans le rétrécissement de l'« écart de simulation-réalité », les principales méthodes comprenant :

Randomisation de domaine (Domain Randomization) : ajuster aléatoirement des paramètres tels que l'éclairage, le frottement, le bruit dans la simulation pour augmenter la capacité de généralisation du modèle ;

Calibration de cohérence physique : utiliser des données de capteur réelles pour calibrer le moteur de simulation, améliorant le réalisme physique ;

Ajustement adaptatif (Adaptive Fine-tuning) : effectuer un réentraînement rapide dans des environnements réels pour réaliser une migration stable.

Sim2Real est le lien central de l'implémentation de l'intelligence incarnée, permettant aux modèles AI d'apprendre le cycle « perception-décision-contrôle » dans un monde virtuel sûr et à faible coût. Sim2Real est déjà mature en matière d'entraînement de simulation (comme NVIDIA Isaac Sim, MuJoCo), mais la migration vers la réalité reste limitée par le Reality Gap, les coûts de calcul élevés et d'annotation, ainsi qu'une généralisation et une sécurité insuffisantes dans des environnements ouverts. Toutefois, le Simulation-as-a-Service (SimaaS) devient l'infrastructure la plus légère mais la plus stratégique de l'ère de l'intelligence incarnée, avec des modèles commerciaux comprenant la souscription de plateforme (PaaS), la génération de données (DaaS) et la vérification de sécurité (VaaS).

Modélisation cognitive : World Model — le « monde intérieur » du robot

Le modèle mondial (World Model) est le « cerveau interne » de l'intelligence incarnée, permettant aux robots de simuler l'environnement interne et les conséquences de leurs actions, réalisant des prévisions et des raisonnements. Il construit des représentations internes prévisibles en apprenant les lois dynamiques de l'environnement, permettant aux agents de « répéter » les résultats avant d'exécuter, évoluant d'exécutants passifs à des raisonneurs proactifs. Les projets représentatifs incluent DeepMind Dreamer, Google Gemini + RT-2, Tesla FSD V12, NVIDIA WorldSim, etc. Les voies technologiques typiques comprennent :

Modélisation de variables latentes (Latent Dynamics Modeling) : compression de la perception haute dimensionnelle en un espace d'état latent ;

Entraînement d'imagination et de prévision temporelle (Imagination-based Planning) : essais virtuels et prévision de chemin dans le modèle ;

Apprentissage par renforcement basé sur un modèle (Model-based RL) : remplacer l'environnement réel par un modèle mondial, réduisant les coûts d'entraînement.

Le modèle mondial (World Model) est à la pointe théorique de l'intelligence incarnée, permettant aux robots de passer d'une intelligence « réactive » à une intelligence « prédictive », mais est toujours limité par la complexité de la modélisation, l'instabilité des prévisions à long terme et le manque de normes unifiées.

Intelligence collective et raisonnement mémoriel : du comportement individuel à la cognition collaborative

La collaboration multi-agents (Multi-Agent Systems) et le raisonnement mémoriel (Memory & Reasoning) représentent deux directions importantes de l'évolution de l'intelligence incarnée, passant de l'« intelligence individuelle » à l'« intelligence collective » et à l'« intelligence cognitive ». Ces deux éléments soutiennent ensemble l'apprentissage collaboratif des systèmes intelligents et leur capacité d'adaptation à long terme.

Collaboration multi-agents (Swarm / RL coopératif) :

Se réfère à plusieurs agents prenant des décisions collaboratives et répartissant des tâches en utilisant l'apprentissage par renforcement distribué ou coopératif dans un environnement partagé. Ce domaine a déjà une base de recherche solide, par exemple, l'expérience OpenAI Hide-and-Seek a montré la coopération spontanée entre plusieurs agents et l'émergence de stratégies, tandis que les algorithmes DeepMind QMIX et MADDPG fournissent un cadre de collaboration pour un entraînement centralisé et une exécution décentralisée. Ces méthodes ont été validées dans des scénarios tels que la planification de robots d'entrepôt, l'inspection et le contrôle des essaims.

Mémoire et raisonnement (Memory & Reasoning) :

Se concentrer sur la capacité des agents à avoir une mémoire à long terme, une compréhension contextuelle et des capacités de raisonnement causal est une direction clé pour réaliser la migration inter-tâches et l'auto-planification. Les recherches typiques incluent DeepMind Gato (un agent multitâche unifié de perception-langage-contrôle) et la série DeepMind Dreamer (planification imaginative basée sur le modèle mondial), ainsi que les agents d'intelligence incarnée ouverts comme Voyager, réalisant un apprentissage continu par le biais de mémoire externe et d'auto-évolution. Ces systèmes établissent les bases pour que les robots possèdent la capacité de « se souvenir du passé et de déduire l'avenir ».

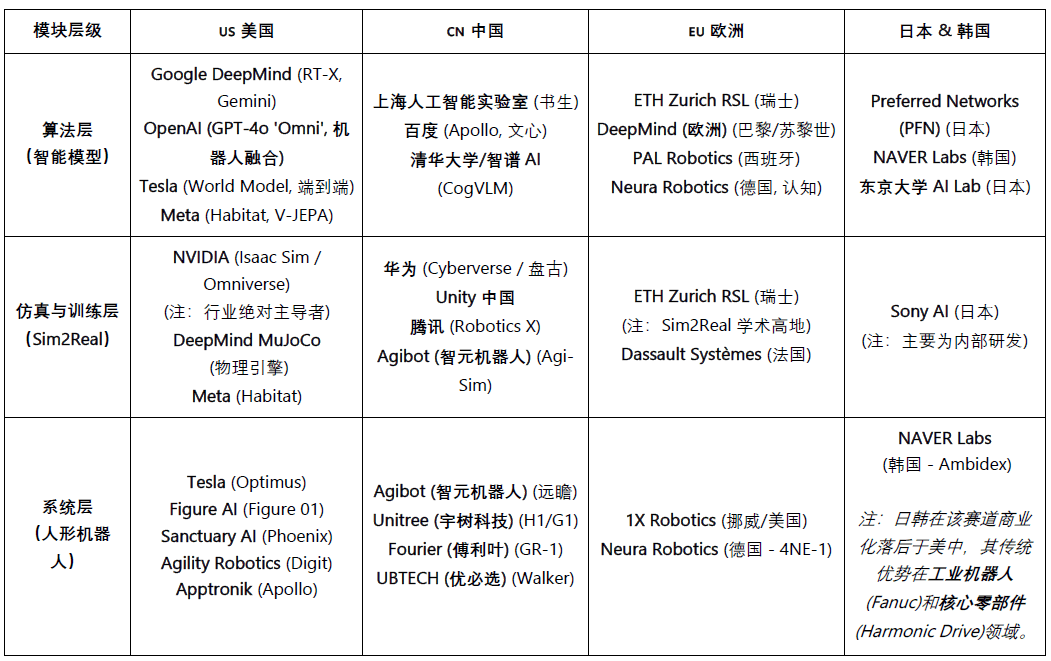

Le paysage mondial de l'intelligence incarnée : coopération et concurrence coexistantes

L'industrie mondiale des robots est actuellement dans une période de « coopération dominante, concurrence approfondie ». L'efficacité de la chaîne d'approvisionnement en Chine, les capacités AI des États-Unis, la précision des composants japonais et les normes industrielles européennes façonnent ensemble la structure à long terme de l'industrie robotique mondiale.

Les États-Unis maintiennent une avance dans les domaines des modèles AI de pointe et des logiciels (DeepMind, OpenAI, NVIDIA), mais cet avantage ne s'est pas étendu au matériel robotique. Les fabricants chinois ont un avantage en termes de rapidité d'itération et de performance dans des scénarios réels. Les États-Unis promeuvent le retour de l'industrie par le biais de la loi sur les puces (CHIPS Act) et la loi de réduction de l'inflation (IRA).

La Chine, grâce à une fabrication à grande échelle, une intégration verticale et une impulsion politique, a formé un avantage concurrentiel dans les domaines des composants, des usines automatisées et des robots humanoïdes, avec des capacités matérielles et de chaîne d'approvisionnement exceptionnelles. Des entreprises comme Yushu et UBTECH ont déjà atteint la production de masse et se dirigent vers un niveau de décision intelligent. Cependant, il existe encore un écart important avec les États-Unis dans les couches d'algorithmes et d'entraînement de simulation.

Le Japon a longtemps monopolisé les composants de haute précision et la technologie de contrôle du mouvement, avec un système industriel solide, mais l'intégration des modèles AI est encore à un stade précoce, avec un rythme d'innovation relativement stable.

La Corée du Sud se distingue dans la diffusion des robots de consommation, avec des entreprises comme LG et NAVER Labs en tête, et dispose d'un écosystème de robots de service mature et solide.

L'Europe a un système d'ingénierie et des normes de sécurité bien établies, avec des entreprises comme 1X Robotics actives dans la recherche et développement, mais certaines étapes de fabrication se déplacent à l'étranger, et le centre d'innovation se déplace vers la collaboration et la standardisation.

III. Robots × AI × Web3 : visions narratives et chemins réels

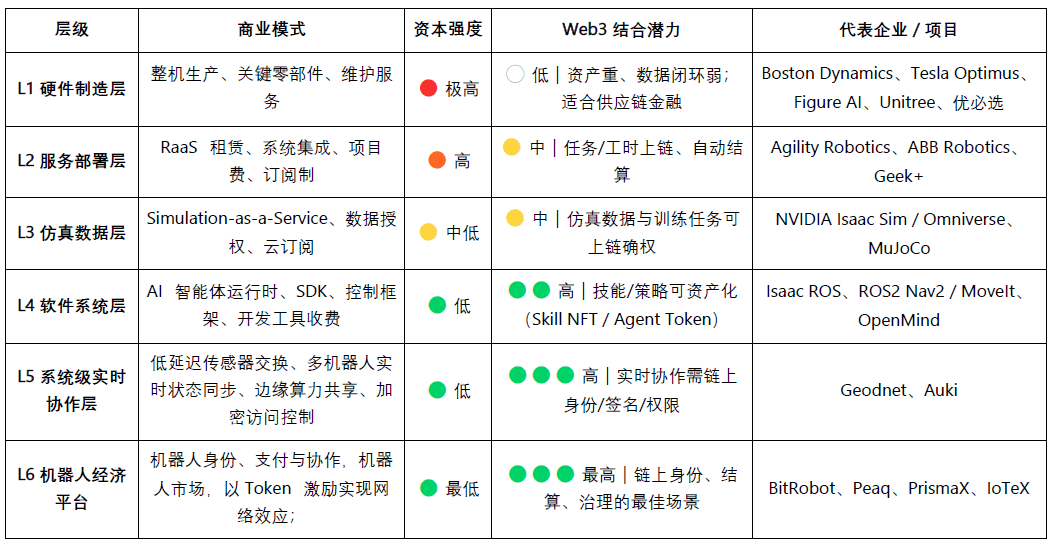

En 2025, un nouveau récit émerge autour de l'intégration de Web3 avec les robots et l'IA. Bien que Web3 soit considéré comme le protocole de base de l'économie machine décentralisée, sa valeur d'intégration et sa faisabilité à différents niveaux présentent encore des divergences notables :

La fabrication de matériel et la couche de services sont à forte intensité de capital, avec une boucle de données faible, Web3 ne peut actuellement jouer qu'un rôle d'assistance dans des segments de la finance de la chaîne d'approvisionnement ou de la location d'équipements ;

Il existe une adéquation relativement élevée entre la simulation et l'écosystème logiciel, les données de simulation et les tâches d'entraînement pouvant être certifiées sur la chaîne, les agents et les modules de compétences pouvant également être tokenisés via des NFT ou des Agent Tokens ;

Au niveau de la plateforme, le réseau décentralisé de main-d'œuvre et de collaboration montre le plus grand potentiel - Web3 peut progressivement construire un « marché de la main-d'œuvre machine » fiable grâce à une intégration des mécanismes d'identité, d'incitation et de gouvernance, établissant la forme institutionnelle pour la future économie machine.

D'un point de vue vision à long terme, la collaboration et la couche plateforme représentent les directions les plus précieuses dans la fusion de Web3 avec les robots et l'IA. À mesure que les robots acquièrent progressivement des capacités de perception, de langage et d'apprentissage, ils évoluent vers des individus intelligents capables de prendre des décisions autonomes, de collaborer et de créer de la valeur économique. Ces « travailleurs intelligents » participant réellement au système économique doivent encore franchir quatre seuils centraux en matière d'identité, de confiance, d'incitation et de gouvernance.

Au niveau de l'identité, les machines doivent disposer d'une identité numérique traçable et certifiable. Grâce à Machine DID, chaque robot, capteur ou drone peut générer une « carte d'identité » unique vérifiable sur la chaîne, liant sa propriété, ses enregistrements de comportement et sa portée d'autorisation, permettant des interactions sécurisées et une définition des responsabilités.

Au niveau de la confiance, l'enjeu est de rendre le « travail machine » vérifiable, mesurable et tarifé. Grâce aux contrats intelligents, aux oracles et aux mécanismes d'audit, combinés à la preuve de travail physique (PoPW), à l'environnement d'exécution de confiance (TEE) et à la preuve à zéro connaissance (ZKP), il est possible d'assurer l'authenticité et la traçabilité du processus d'exécution des tâches, conférant une valeur économique aux comportements machines.

Dans la couche d'incitation, Web3 réalise le règlement automatique et le flux de valeur entre machines grâce à un système d'incitation par Token, l'abstraction de compte et les canaux d'état. Les robots peuvent effectuer une location de puissance de calcul et un partage de données via des micropaiements, garantissant l'exécution des tâches par des mécanismes de mise en gage et de pénalité ; grâce aux contrats intelligents et aux oracles, un marché décentralisé de « collaboration machine » sans planification humaine peut également être formé.

Dans la couche de gouvernance, lorsque les machines acquièrent une capacité d'autonomie à long terme, Web3 fournit un cadre de gouvernance transparent et programmable : en gouvernant les paramètres du système de décision conjoint par DAO et en maintenant la sécurité et l'ordre par des mécanismes de multi-signatures et de réputation. À long terme, cela propulsera la société machine vers une phase de « gouvernance algorithmique » - les humains définissent des objectifs et des limites, les machines maintiennent les incitations et l'équilibre par contrat.

La vision ultime de l'intégration de Web3 et des robots : un réseau d'évaluation dans des environnements réels — un « moteur de raisonnement du monde réel » composé de robots distribués, testant en continu les capacités de modèles baselines dans des scénarios physiques divers et complexes ; et un marché de main-d'œuvre robotique — où les robots exécutent des tâches réelles vérifiables à l'échelle mondiale, obtenant des revenus par le biais de règlements en chaîne, et réinvestissant la valeur dans la puissance de calcul ou la mise à niveau matérielle.

D'un point de vue pratique, l'intégration de l'intelligence incarnée et de Web3 est encore à un stade précoce d'exploration, l'économie intelligente machine décentralisée restant majoritairement au niveau de la narration et de la communauté. Les directions d'intégration avec un potentiel pratique se manifestent principalement dans les trois domaines suivants :

(1) Crowdsourcing de données et validation – Web3 encourage les contributeurs à télécharger des données du monde réel grâce à des mécanismes d'incitation et de traçabilité en chaîne ;

(2) Participation mondiale au long tail – les paiements transfrontaliers et les mécanismes d'incitation réduisent effectivement les coûts de collecte et de distribution des données ;

(3) Financement et innovation collaborative – le modèle DAO peut favoriser la tokenisation des actifs robotiques, la certification des produits de revenu et les mécanismes de règlement entre machines.

Dans l'ensemble, à court terme, le principal accent est mis sur la collecte de données et la couche d'incitation ; à moyen terme, des percées pourraient être réalisées dans la couche de « paiement en stablecoin + agrégation de données long tail » ainsi que dans la tokenisation et le règlement de RaaS ; à long terme, si les robots humanoïdes sont largement déployés, Web3 pourrait devenir le fondement institutionnel de la propriété robotique, de la distribution des revenus et de la gouvernance, favorisant la formation d'une véritable économie machine décentralisée.

IV. Carte écosystémique des robots Web3 et études de cas sélectionnées

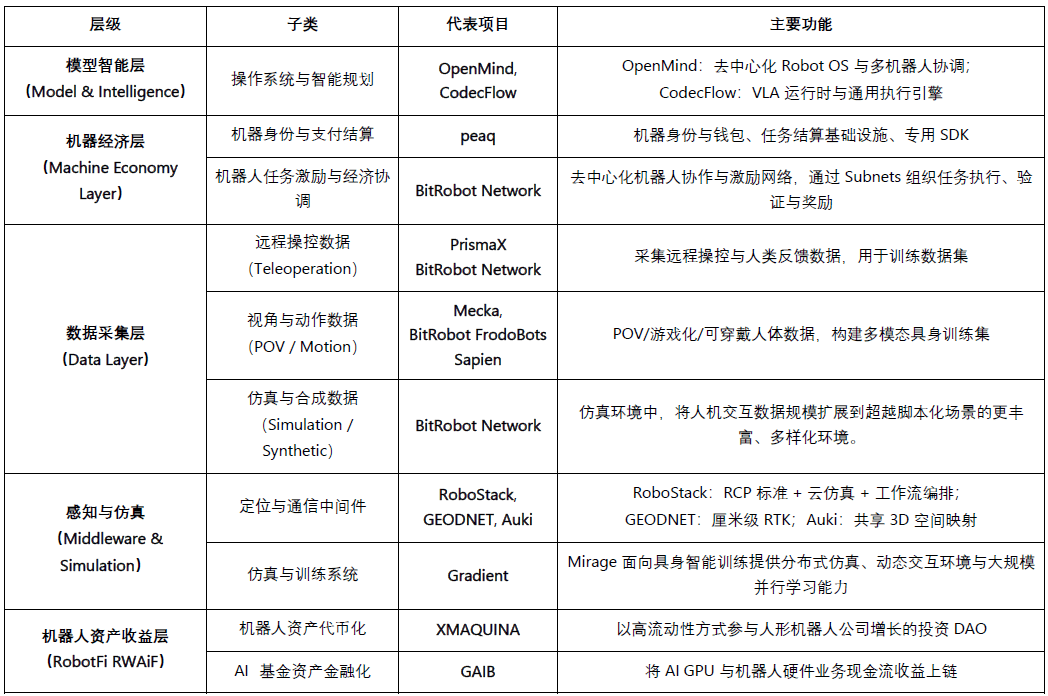

Sur la base de trois critères : « progrès vérifiable, degré d'ouverture technologique, pertinence industrielle », nous avons passé en revue les projets représentatifs de Web3 × Robotics actuels et les avons classés selon cinq niveaux d'architecture : couche d'intelligence du modèle, couche économique des machines, couche de collecte de données, couche de perception et d'infrastructure de simulation, couche de rendement d'actifs robotiques. Pour maintenir l'objectivité, nous avons exclu les projets manifestement « opportunistes » ou ceux avec des informations insuffisantes ; en cas d'omission, n'hésitez pas à nous corriger.

Couche d'intelligence du modèle (Model & Intelligence Layer)

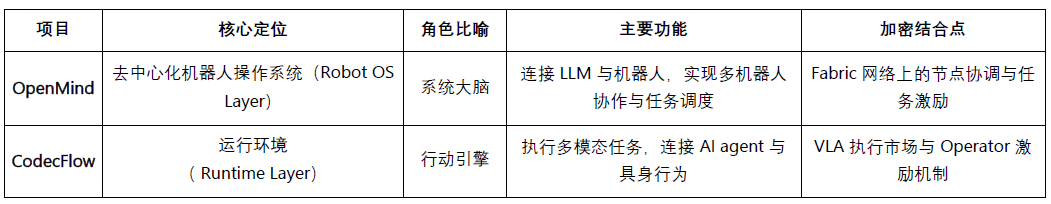

Openmind - Construire Android pour les robots (https://openmind.org/)

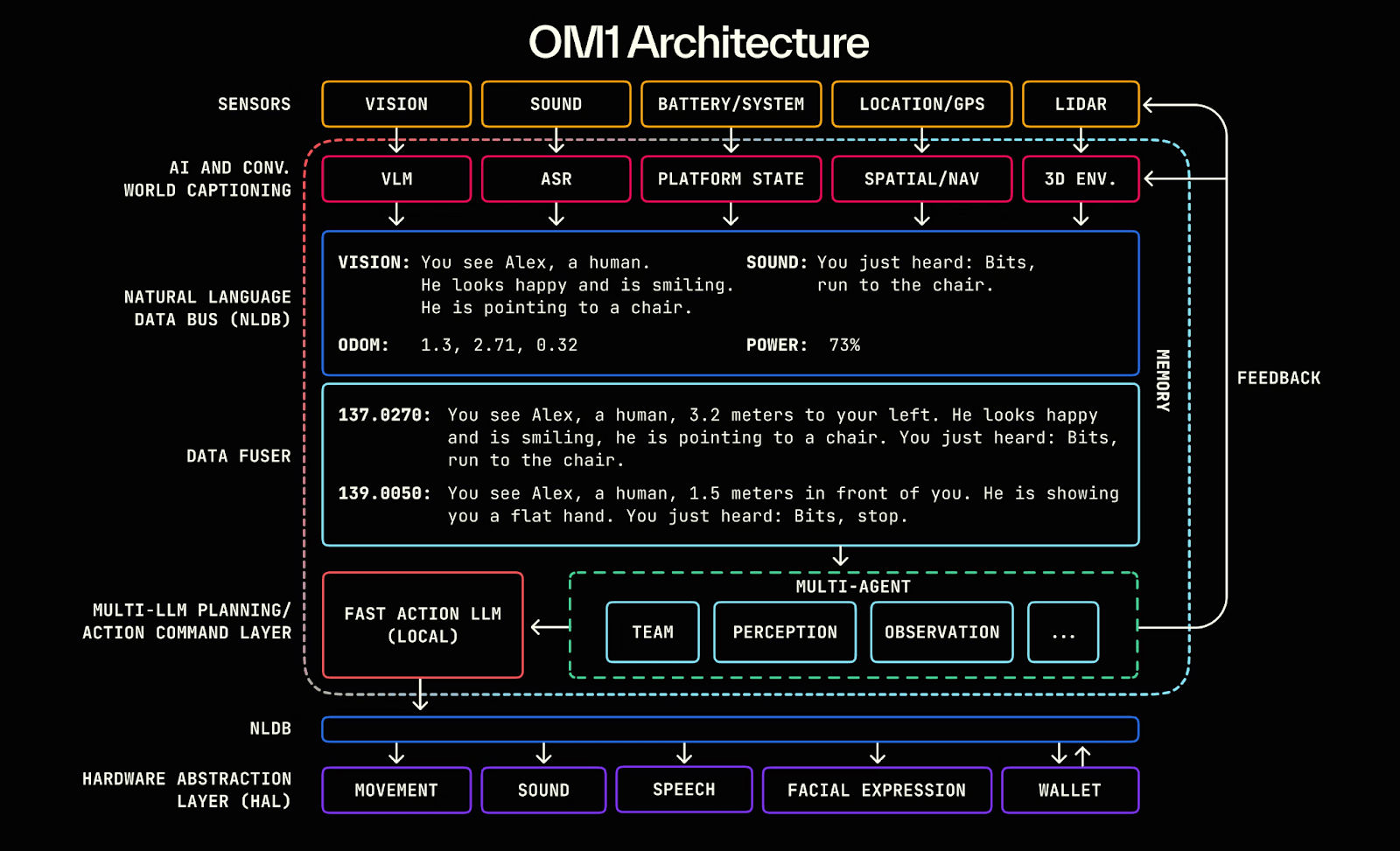

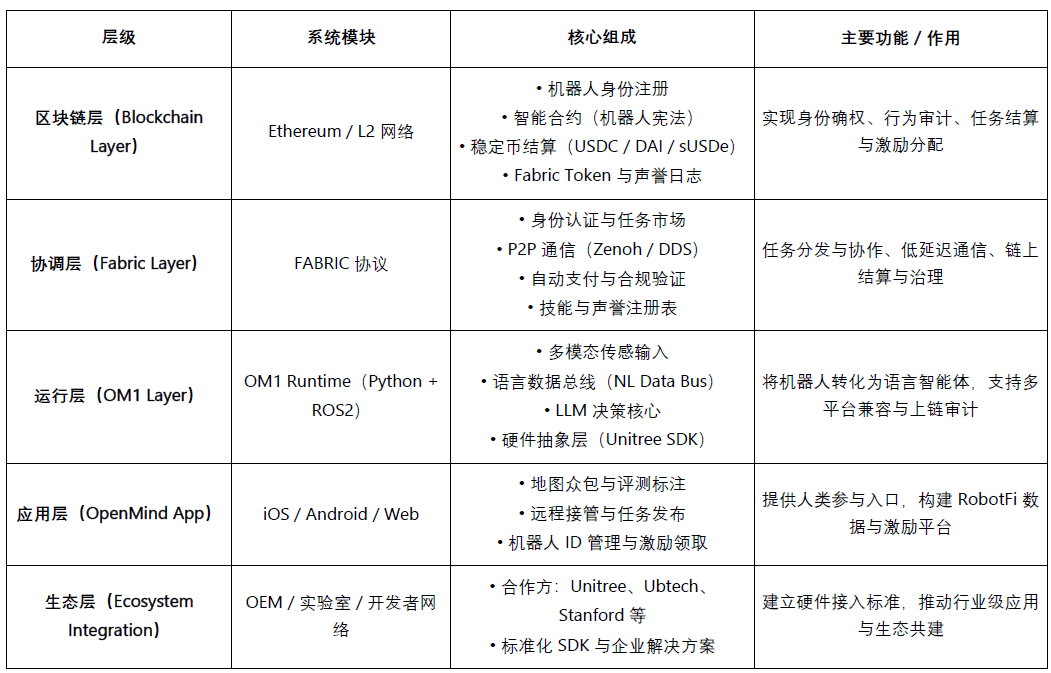

OpenMind est un système d'exploitation open source (Robot OS) destiné à l'intelligence incarnée (Embodied AI) et au contrôle des robots, visant à construire le premier environnement d'exploitation et plateforme de développement de robots décentralisés au monde. Le cœur du projet comprend deux composants principaux :

OM1 : un environnement d'exécution d'agent AI modulaire open source construit sur ROS2 (AI Runtime Layer), utilisé pour orchestrer la perception, la planification et les pipelines d'action, au service des robots numériques et physiques ;

FABRIC : couche de coordination distribuée (Fabric Coordination Layer), connectant la puissance de calcul cloud, les modèles et les robots réels, permettant aux développeurs de contrôler et d'entraîner les robots dans un environnement unifié.

Le cœur d'OpenMind réside dans son rôle d'interface intelligente entre le LLM (modèle de langage de grande taille) et le monde des robots, permettant à l'intelligence linguistique de se transformer réellement en intelligence incarnée (Embodied Intelligence), construisant un squelette intelligent reliant « compréhension (Language → Action) » à « alignement (Blockchain → Rules) ». Le système multi-couches d'OpenMind réalise un cycle complet de collaboration : les humains fournissent des retours et des annotations via l'application OpenMind (données RLHF), le réseau Fabric gère la validation d'identité, l'attribution des tâches et la coordination des règlements, les robots OM1 exécutent des tâches et respectent la « constitution des robots » sur la blockchain pour réaliser l'audit comportemental et le paiement, réalisant ainsi un réseau de collaboration machine décentralisé de « retour humain → collaboration de tâches → règlement en chaîne ».

Avancement du projet et évaluation de la réalité

OpenMind est à un stade précoce de « technologie opérationnelle, commercialisation non réalisée ». Le système central OM1 Runtime est déjà open source sur GitHub, pouvant fonctionner sur plusieurs plateformes et supporter des entrées multimodales, réalisant la compréhension des tâches de langage à action via un bus de données en langage naturel (NLDB), avec une originalité élevée mais restant expérimental, le réseau Fabric et le règlement en chaîne n'ayant terminé que la conception de l'interface.

Sur le plan écologique, le projet a collaboré avec Unitree, Ubtech, TurtleBot et des universités telles que Stanford, Oxford, Seoul Robotics, principalement pour des validations éducatives et de recherche, sans encore de déploiement industrialisé. L'application a lancé une version bêta, mais les fonctionnalités d'incitation et de tâche sont encore à un stade précoce.

En termes de modèle commercial, OpenMind a construit un écosystème en trois couches comprenant OM1 (système open source) + Fabric (protocole de règlement) + Skill Marketplace (couche d'incitation), sans revenus pour le moment, dépendant d'un financement précoce d'environ 20 millions de dollars (Pantera, Coinbase Ventures, DCG). Dans l'ensemble, bien que la technologie soit en avance, la commercialisation et l'écosystème sont encore à un stade précoce, et si Fabric réussit à se concrétiser, cela pourrait devenir « Android de l'ère de l'intelligence incarnée », mais avec un cycle long, des risques élevés et une forte dépendance matérielle.

CodecFlow - Le moteur d'exécution pour la robotique (https://codecflow.ai)

CodecFlow est un protocole de couche d'exécution décentralisée basé sur le réseau Solana (Fabric), visant à fournir un environnement d'exécution à la demande pour les agents AI et les systèmes robotiques, permettant à chaque agent d'avoir une « machine instantanée (Instant Machine) ». Le cœur du projet est constitué de trois modules :

Fabric : couche d'agrégation de puissance de calcul multi-cloud (Weaver + Shuttle + Gauge), permettant de générer des machines virtuelles sécurisées, des conteneurs GPU ou des nœuds de contrôle robotique en quelques secondes pour les tâches AI ;

optr SDK : cadre d'exécution d'agent (interface Python), utilisé pour créer des « opérateurs » opérables pour des robots de bureau, de simulation ou réels ;

Incitation par token : couche d'incitation et de paiement en chaîne, reliant les fournisseurs de calcul, les développeurs d'agents et les utilisateurs de tâches automatisées, formant un marché décentralisé de puissance de calcul et de tâches.

L'objectif central de CodecFlow est de créer une « base d'exécution décentralisée pour l'IA et les opérateurs robotiques », permettant à tout agent de fonctionner en toute sécurité dans n'importe quel environnement (Windows / Linux / ROS / MuJoCo / contrôleur robotique), réalisant une architecture d'exécution universelle allant de la répartition de puissance de calcul (Fabric) → environnement système (System Layer) → perception et action (VLA Operator).

Avancement du projet et évaluation de la réalité

Une version précoce du cadre Fabric (Go) et de l'optr SDK (Python) a été publiée, permettant le lancement d'instances de puissance de calcul isolées dans un environnement web ou en ligne de commande. Le marché des opérateurs devrait être lancé d'ici fin 2025, se positionnant comme une couche d'exécution décentralisée pour la puissance AI.

Les principaux clients incluent des développeurs AI, des équipes de recherche en robotique et des entreprises d'exploitation automatisée.

Couche économique des machines (Machine Economy Layer)

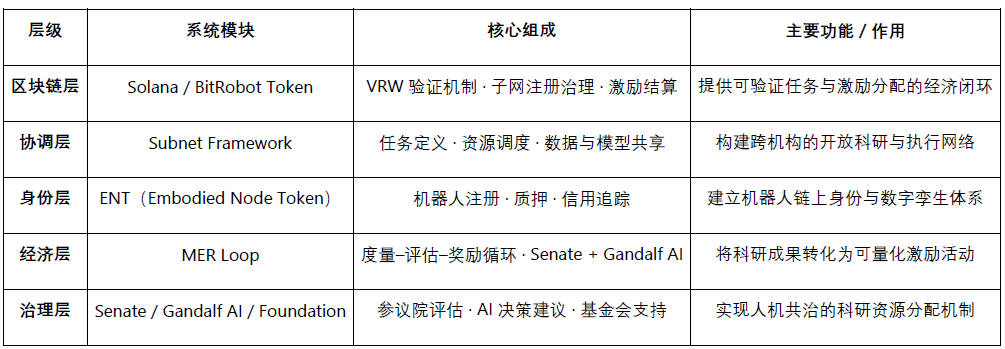

BitRobot - Le laboratoire de robotique ouvert du monde (https://bitrobot.ai)

BitRobot est un réseau décentralisé de recherche et de collaboration axé sur l'intelligence incarnée (Embodied AI) et le développement de robots (Open Robotics Lab), cofondé par FrodoBots Labs et Protocol Labs. Sa vision centrale est de fonctionner via une architecture ouverte de « sous-réseaux (Subnets) + mécanismes d'incitation + travail vérifiable (VRW) », comprenant des fonctions clés :

Définir et vérifier la véritable contribution de chaque tâche robotique par la norme VRW (Travail Robotique Vérifiable) ;

Accorder une identité en chaîne et une responsabilité économique aux robots via ENT (Embodied Node Token) ;

Organiser la recherche scientifique, la puissance de calcul, les équipements et les opérateurs à travers les sous-réseaux pour une collaboration inter-régionale ;

Réaliser des décisions incitatives et la gouvernance de la recherche scientifique par le biais de Senate + Gandalf AI pour « gouvernance conjointe homme-machine ».

Depuis la publication de son livre blanc en 2025, BitRobot a mis en place plusieurs sous-réseaux (comme SN/01 ET Fugi, SN/05 SeeSaw via Virtuals Protocol), réalisant un contrôle à distance décentralisé et une collecte de données dans des scénarios réels, et a lancé le fonds $5M Grand Challenges pour promouvoir des compétitions de recherche sur le développement de modèles mondiaux.

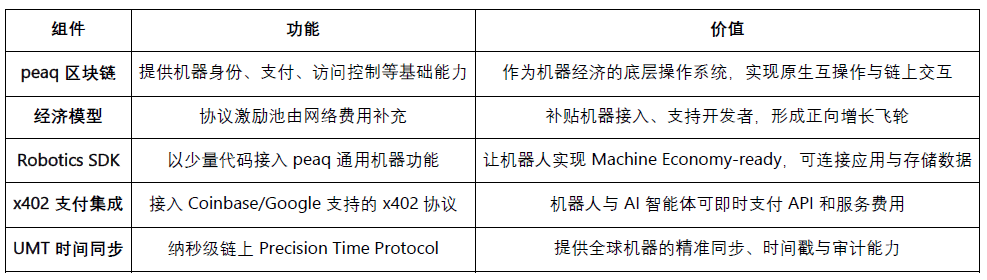

peaq – L'économie des choses (https://www.peaq.network)

peaq est une blockchain de couche 1 spécialement conçue pour l'économie machine, fournissant une identité machine, un portefeuille en chaîne, un contrôle d'accès et des capacités de synchronisation temporelle à l'échelle des nanosecondes (Universal Machine Time) pour des millions de robots et d'appareils. Son SDK Robotics permet aux développeurs de rendre les robots « prêts pour l'économie machine » avec un minimum de code, réalisant l'interopérabilité et l'interaction entre fabricants et systèmes.

Actuellement, peaq a lancé la première ferme robotique tokenisée au monde, soutenant plus de 60 applications robotiques réelles. Son cadre de tokenisation aide les entreprises robotiques à lever des fonds pour des matériels nécessitant beaucoup de capital, et à élargir les modes de participation au-delà des modèles traditionnels B2B/B2C vers des couches communautaires plus larges. Grâce à des pools d'incitation au niveau protocolaire financés par des frais de réseau, peaq peut subventionner l'intégration de nouveaux équipements et soutenir les développeurs, formant ainsi un volant économique propulsant l'expansion accélérée des projets robotiques et des AI physiques.

Couche de collecte de données (Data Layer)

Destiné à résoudre le problème de la rareté et du coût élevé des données de haute qualité du monde réel dans l'entraînement de l'intelligence incarnée. Collecte et génération de données d'interaction homme-machine par plusieurs voies, y compris la télécommande (PrismaX, BitRobot Network), la première personne et la capture de mouvement (Mecka, BitRobot Network, Sapien, Vader, NRN) ainsi que des données de simulation et synthétiques (BitRobot Network), fournissant une base d'entraînement extensible et généralisable pour les modèles de robots.

Il est important de préciser que Web3 n'excelle pas dans la « production de données » - dans les domaines du matériel, des algorithmes et de l'efficacité de collecte, les géants de Web2 surpassent de loin tout projet DePIN. Sa véritable valeur réside dans la restructuration de la distribution et des mécanismes d'incitation des données. Basé sur « un réseau de paiement en stablecoin + un modèle de crowdsourcing », à travers un système d'incitation sans autorisation et un mécanisme de validation en chaîne, il réalise des règlements à faible coût, la traçabilité des contributions et le partage automatique des bénéfices. Cependant, le crowdsourcing ouvert fait encore face à des problèmes de qualité et de boucle de demande - la qualité des données varie énormément, manquant de validation efficace et de clients stables.

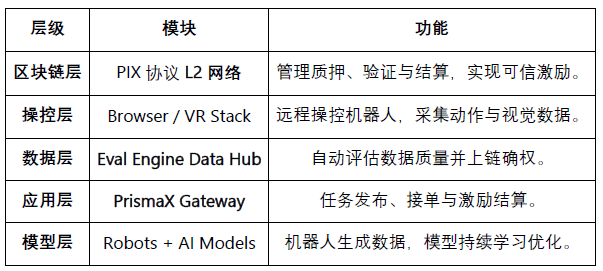

PrismaX (https://gateway.prismax.ai)

PrismaX est un réseau décentralisé de télécommande et d'économie de données axé sur l'intelligence incarnée (Embodied AI), visant à construire un « marché mondial de la main-d'œuvre robotique », permettant aux opérateurs humains, aux équipements robotiques et aux modèles d'IA d'évoluer en synergie via un système d'incitation en chaîne. Le cœur du projet comprend deux composants principaux :

Teleoperation Stack — Système de télécommande (interface web/VR + SDK), connectant des bras robotiques et des robots de service du monde entier, permettant un contrôle humain en temps réel et la collecte de données ;

Eval Engine — Moteur d'évaluation et de validation des données (CLIP + DINOv2 + évaluation sémantique de flux optique), générant des scores de qualité pour chaque trajectoire d'opération et les réglant en chaîne.

PrismaX convertit les comportements opérationnels humains en données d'apprentissage machine via un mécanisme d'incitation décentralisé, construisant un cycle complet de « télécommande → collecte de données → entraînement de modèle → règlement en chaîne », réalisant une économie circulaire de « travail humain équivalant à des actifs de données ».

Avancement du projet et évaluation de la réalité : PrismaX a lancé une version bêta en août 2025 (gateway.prismax.ai), permettant aux utilisateurs de contrôler à distance un bras robotique pour effectuer des expériences de saisie et générer des données d'entraînement. L'Eval Engine fonctionne déjà en interne, dans l'ensemble, la réalisation technique de PrismaX est relativement élevée, avec une position claire, servant de couche intermédiaire clé reliant « opération humaine × modèle d'IA × règlement blockchain ». Son potentiel à long terme pourrait devenir « un protocole décentralisé de travail et de données à l'ère de l'intelligence incarnée », mais à court terme, il fait encore face à des défis de mise à l'échelle.

BitRobot Network (https://bitrobot.ai/)

BitRobot Network collecte des données multimodales via ses sous-réseaux, réalisant des vidéos, un contrôle à distance et une simulation. SN/01 ET Fugi permet aux utilisateurs de contrôler les robots à distance pour accomplir des tâches, collectant des données de navigation et de perception dans une interaction de type « Pokémon Go version réelle ». Ce mécanisme a conduit à la création du jeu de données FrodoBots-2K, qui est l'un des plus grands ensembles de données de navigation homme-machine open source actuellement utilisés par des institutions telles que UC Berkeley RAIL et Google DeepMind. SN/05 SeeSaw (Virtual Protocol) collecte à grande échelle des vidéos à la première personne dans un environnement réel via iPhone. D'autres sous-réseaux publiés, comme RoboCap et Rayvo, se concentrent sur la collecte de vidéos à la première personne à l'aide de dispositifs physiques à faible coût.

Mecka (https://www.mecka.ai)

Mecka est une entreprise de données robotiques qui collecte des vidéos à la première personne, des données de mouvement humain et des démonstrations de tâches via des appareils matériels personnalisés et des jeux sur mobile, pour construire un ensemble de données multimodales à grande échelle, soutenant l'entraînement des modèles d'intelligence incarnée.

Sapien (https://www.sapien.io/)

Sapien est une plateforme de crowdsourcing axée sur « l'intelligence robotique alimentée par des données de mouvement humain », collectant des données sur les mouvements, les postures et les interactions humaines via des dispositifs portables et des applications mobiles, pour entraîner des modèles d'intelligence incarnée. Le projet vise à construire le plus grand réseau de données de mouvement humain au monde, faisant des comportements naturels des humains la source de données fondamentale pour l'apprentissage et la généralisation des robots.

Vader (https://www.vaderai.ai)

Vader collecte des vidéos à la première personne et des démonstrations de tâches via son application MMO EgoPlay dans le monde réel : les utilisateurs enregistrent leurs activités quotidiennes en perspective de première personne et reçoivent des récompenses $VADER. Son pipeline de données ORN peut convertir des images POV brutes en ensembles de données structurées traitées pour la confidentialité, comprenant des étiquettes d'action et des descriptions sémantiques, pouvant être directement utilisées pour la formation de stratégies de robots humanoïdes.

NRN Agents (https://www.nrnagents.ai/)

Une plateforme de données RL incarnée, gamifiée, permettant de crowdsourcer des données de démonstration humaines via le contrôle de robots côté navigateur et des compétitions simulées. NRN génère des trajectoires de comportement à longue queue par des tâches « compétitives », utilisées pour l'apprentissage par imitation et l'apprentissage par renforcement continu, et sert de primitive de données extensible pour soutenir l'entraînement de stratégies sim-to-real.

Comparaison des projets de collecte de données sur l'intelligence incarnée

Perception et simulation (Middleware & Simulation)

La couche de perception et de simulation fournit aux robots les infrastructures de base essentielles pour connecter le monde physique et la prise de décision intelligente, y compris la localisation, la communication, la modélisation spatiale et l'entraînement de simulation, constituant « l'ossature intermédiaire » pour construire des systèmes d'intelligence incarnée à grande échelle. Ce domaine en est actuellement à un stade d'exploration précoce, chaque projet se différenciant dans les domaines de la localisation de haute précision, du calcul d'espace partagé, de la normalisation des protocoles et de la simulation distribuée, sans qu'aucune norme unifiée ou écosystème interopérable n'ait encore émergé.

Middleware et infrastructures spatiales (Middleware & Spatial Infra)

Les capacités fondamentales des robots — navigation, localisation, connectivité et modélisation spatiale — constituent le pont clé reliant le monde physique et la prise de décision intelligente. Bien que des projets DePIN plus larges (Silencio, WeatherXM, DIMO) commencent à mentionner « des robots », les projets suivants sont les plus directement liés à l'intelligence incarnée.

RoboStack – Cloud-Native Robot Operating Stack (https://robostack.io)

RoboStack est un middleware robotique natif du cloud, réalisant la planification en temps réel des tâches robotiques, le contrôle à distance et l'interopérabilité multiplateforme via RCP (Robot Context Protocol), tout en offrant des capacités de simulation cloud, d'orchestration de flux de travail et d'accès d'agent.

GEODNET – Réseau GNSS décentralisé (https://geodnet.com)

GEODNET est un réseau GNSS décentralisé mondial, fournissant un positionnement RTK de haute précision à centimètre près. Grâce à des stations de base distribuées et des incitations en chaîne, il offre une « couche géographique de référence » en temps réel pour les drones, la conduite autonome et les robots.

Auki – Posemesh pour l'informatique spatiale (https://www.auki.com)

Auki construit un réseau de calcul spatial décentralisé Posemesh, générant des cartes 3D environnementales en temps réel à travers des capteurs et des nœuds de calcul crowdsourcés, fournissant des références d'espace partagé pour la navigation robotique, la réalité augmentée et la coopération entre plusieurs appareils. C'est une infrastructure clé reliant l'espace virtuel aux scénarios réels, favorisant la fusion de AR × Robotics.

Tashi Network — Réseau de collaboration en temps réel pour les robots (https://tashi.network)

Un réseau de grille décentralisé en temps réel, réalisant un consensus en moins de 30 ms, un échange de capteurs à faible latence et une synchronisation d'état multi-robots. Son SDK MeshNet supporte le SLAM partagé, la collaboration en essaim et la mise à jour robuste des cartes, fournissant une couche de collaboration en temps réel à haute performance pour l'AI incarnée.

Staex — Réseau de connexion et de télémétrie décentralisé (https://www.staex.io)

Une couche de connexion décentralisée issue du département de R&D de Deutsche Telekom, fournissant une communication sécurisée, une télémétrie fiable et des capacités de routage appareil-cloud, permettant aux flottes de robots d'échanger des données de manière fiable et de collaborer entre différents opérateurs.

Systèmes de simulation et d'entraînement (Distributed Simulation & Learning)

Gradient - Vers une intelligence ouverte (https://gradient.network/)

Gradient est un laboratoire AI construisant une « intelligence ouverte (Open Intelligence) », s'efforçant de réaliser un entraînement, un raisonnement, une vérification et une simulation distribués basés sur une infrastructure décentralisée ; sa pile technologique actuelle comprend Parallax (raisonnement distribué), Echo (apprentissage par renforcement distribué et entraînement multi-agents) et Gradient Cloud (solutions AI pour entreprises). Dans le domaine des robots, la plateforme Mirage fournit des capacités de simulation distribuée, d'environnement interactif dynamique et d'apprentissage parallèle à grande échelle pour accélérer le déploiement de modèles mondiaux et de stratégies générales. Mirage discute avec NVIDIA des directions potentielles de collaboration avec son moteur Newton.

La couche de rendement d'actifs robotiques (RobotFi / RWAiFi)

Cette couche se concentre sur la transformation des robots d'outils « productifs » en actifs « financiers », construisant l'infrastructure financière de l'économie machine à travers la tokenisation des actifs, la distribution des revenus et la gouvernance décentralisée. Les projets représentatifs incluent :

XmaquinaDAO – DAO d'AI physique (https://www.xmaquina.io)

XMAQUINA est un écosystème décentralisé, fournissant aux utilisateurs mondiaux des canaux de participation très liquides aux meilleurs robots humanoïdes et aux entreprises d'intelligence incarnée, apportant des opportunités autrefois réservées aux institutions de capital-risque sur la chaîne. Son token DEUS est à la fois un actif indiciel de liquidité et un véhicule de gouvernance, utilisé pour coordonner la distribution du trésor et le développement de l'écosystème. Grâce au DAO Portal et au Machine Economy Launchpad, la communauté peut participer en chaîne à la tokenisation et à la structuration des actifs robotiques, possédant et soutenant ensemble de nouveaux projets d'AI physique.

GAIB – La couche économique pour l'infrastructure AI (https://gaib.ai/)

GAIB s'efforce de fournir une couche économique unifiée pour les infrastructures AI physiques, reliant le capital décentralisé et les actifs réels d'IA, construisant un système économique intelligent vérifiable, combinable et rentable.

Dans le domaine des robots, GAIB ne « vend pas des tokens de robots », mais finance la mise en chaîne des équipements robotiques et des contrats opérationnels (RaaS, collecte de données, téléopération, etc.), réalisant une conversion de « flux de trésorerie réels → actifs de revenus combinables sur la chaîne ». Ce système couvre le financement matériel (location/ mise en gage), les flux de trésorerie opérationnels (RaaS / services de données) et les revenus des flux de données (licence / contrat), rendant les actifs robotiques et leurs flux de trésorerie mesurables, valorisables et échangeables.

GAIB utilise AID / sAID comme support de règlement et de revenus, garantissant des rendements stables grâce à des mécanismes de gestion des risques structurés (sous-collatéralisation, réserves et assurances), et se connectant à long terme aux produits dérivés DeFi et aux marchés de liquidité, formant un cycle financier de « actifs robotiques » à « actifs de revenus combinables ». L'objectif est de devenir la colonne vertébrale économique de l'ère AI (Economic Backbone of Intelligence)

Carte écosystémique des robots Web3 : https://fairy-build-97286531.figma.site/

V. Résumé et perspectives : défis réels et opportunités à long terme

D'un point de vue à long terme, l'intégration des robots × l'IA × Web3 vise à construire un système économique machine décentralisé (DeRobot Economy), propulsant l'intelligence incarnée de l'« automatisation autonome » vers une collaboration en réseau « certifiable, réglable et gouvernable ». Sa logique centrale consiste à former un mécanisme de boucle fermée par le biais de « Token → Déploiement → Données → Redistribution de valeur », permettant aux robots, capteurs et nœuds de puissance de réaliser des droits, des transactions et des partages de bénéfices.

Cependant, d'un point de vue pratique, ce modèle est encore à un stade précoce d'exploration, éloigné de la formation d'un flux de trésorerie stable et d'un cycle commercial à grande échelle. La plupart des projets restent au niveau de la narration, avec des déploiements réels limités. La fabrication et l'exploitation des robots sont des industries à forte intensité de capital, et les incitations basées sur les tokens ne peuvent pas à elles seules soutenir l'expansion de l'infrastructure ; bien que la conception financière sur la chaîne présente une combinabilité, elle n'a pas encore résolu la tarification des risques et la réalisation des rendements d'actifs réels. Par conséquent, le « réseau machine en boucle fermée » demeure idéaliste, et son modèle commercial nécessite une validation pratique.

La couche d'intelligence du modèle (Model & Intelligence Layer) est actuellement la direction la plus précieuse à long terme. Le système d'exploitation robotique open source représenté par OpenMind tente de briser l'écosystème fermé, unifiant la collaboration entre plusieurs robots et l'interface entre le langage et l'action. Sa vision technique est claire, son système complet, mais le volume d'ingénierie est énorme, le cycle de vérification long, et il n'a pas encore formé de rétroaction positive à l'échelle industrielle.

La couche économique des machines (Machine Economy Layer) est encore à un stade préliminaire, dans la réalité, le nombre de robots est limité, l'identité DID et le réseau d'incitation peinent encore à former un cycle de retour cohérent. Nous sommes encore loin de l'« économie de la main-d'œuvre robotique ». À l'avenir, seul un déploiement à grande échelle de l'intelligence incarnée permettra aux effets économiques de l'identité en chaîne, du règlement et du réseau de collaboration de se manifester véritablement.

La couche de collecte de données (Data Layer) présente la barrière la plus basse, mais constitue actuellement la direction la plus proche de la viabilité commerciale. La collecte de données sur l'intelligence incarnée exige une continuité spatio-temporelle et une précision sémantique des actions extrêmement élevées, déterminant sa qualité et sa réutilisabilité. Trouver un équilibre entre « échelle de crowdsourcing » et « fiabilité des données » est un défi central pour l'industrie. PrismaX se concentre d'abord sur les besoins B, puis distribue des tâches de collecte et de validation, offrant dans une certaine mesure un modèle reproductible, mais l'échelle de l'écosystème et les transactions de données nécessitent encore un temps d'accumulation.

La couche de perception et de simulation (Middleware & Simulation Layer) est encore en phase de vérification technique, manquant de normes et d'interfaces unifiées, et n'ayant pas encore formé un écosystème interopérable. Les résultats de simulation sont difficiles à transférer de manière standard à l'environnement réel, et l'efficacité Sim2Real est limitée.

La couche de rendement d'actifs (RobotFi / RWAiFi) Web3 joue principalement un rôle d'assistance dans les segments de la finance de la chaîne d'approvisionnement, de la location d'équipements et de la gouvernance d'investissement, en augmentant la transparence et l'efficacité des règlements, plutôt qu'en remodelant la logique industrielle.

Bien sûr, nous pensons que le point de convergence entre les robots × l'IA × Web3 représente toujours le point de départ du prochain système économique intelligent. Ce n'est pas seulement une fusion de paradigmes technologiques, mais une occasion de reconstruire les relations de production : lorsque les machines possèdent une identité, des incitations et des mécanismes de gouvernance, la collaboration homme-machine passera d'une automatisation partielle à une autonomie en réseau. À court terme, cette direction reste principalement axée sur la narration et l'expérimentation, mais les cadres institutionnels et d'incitation qu'elle établit posent les bases de l'ordre économique de la future société machine. D'un point de vue à long terme, l'intégration de l'intelligence incarnée et de Web3 redéfinira les frontières de la création de valeur — rendant les agents véritablement des entités économiques pouvant être certifiées, collaborées et générées de profits.

Avertissement : Cet article a été assisté par les outils d'IA ChatGPT-5 et Deepseek lors de sa création. L'auteur a fait de son mieux pour vérifier et garantir que les informations sont réelles et précises, mais des omissions peuvent subsister, veuillez en tenir compte. Il convient de noter que le marché des actifs cryptographiques présente généralement des écarts entre les fondamentaux des projets et les performances des prix sur le marché secondaire. Le contenu de cet article n'est destiné qu'à l'intégration d'informations et à l'échange académique/de recherche, ne constitue pas un conseil en investissement et ne doit pas être considéré comme une recommandation d'achat ou de vente de tout token.