Je reviens toujours à une question simple : lorsqu'un système d'IA prend une décision, que doit-on laisser derrière comme preuve ? J'ai l'impression que l'"inférence auditable" est la plus importante lorsque nous cessons de traiter une sortie comme une réponse magique et commençons à la considérer comme un événement qui devrait être enregistré. Dans le Fabric Protocol, du moins tel que le projet se décrit aujourd'hui, l'objectif n'est pas seulement d'exécuter des charges de travail d'IA ou de robotique, mais de coordonner le calcul de données et la supervision à travers des registres publics afin que le travail puisse être observé, récompensé et contesté au lieu d'être simplement confiance.

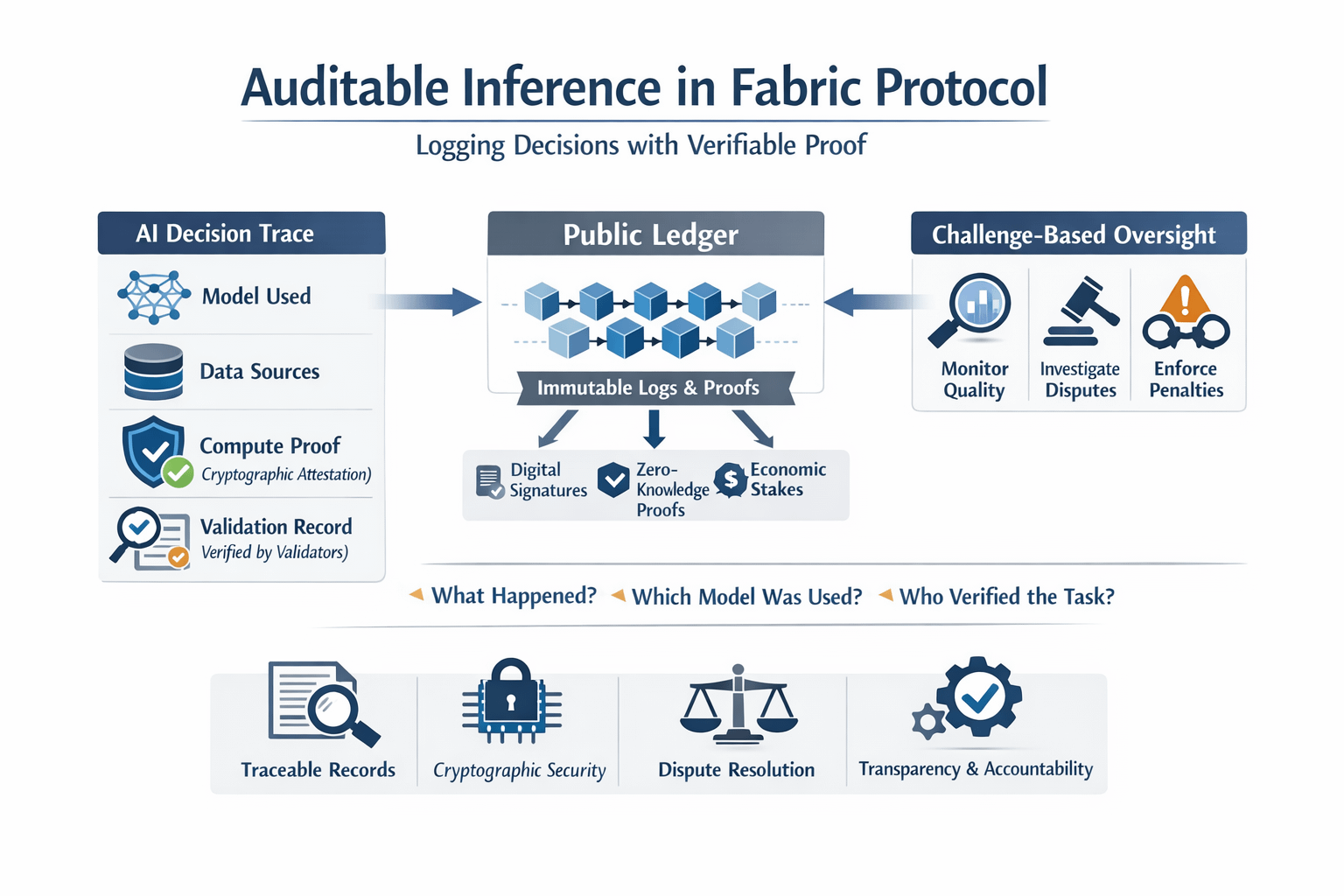

Ce que je trouve utile, c'est de séparer l'explication de la preuve, car les gens veulent souvent qu'un système d'IA s'explique lui-même et cela n'est qu'une partie du problème. Une explication fluide peut toujours être fausse, incomplète ou commode, tandis que la preuve est quelque chose de totalement différent. Dans la conception de Fabric, le travail « vérifiable » est lié à des contributions mesurables telles que l'achèvement de tâches, la fourniture de données, la fourniture de calcul et le travail de validation. Le livre blanc dit même que le calcul fourni pour l'entraînement ou l'inférence du modèle devrait être accompagné d'une attestation cryptographique prouvant que le travail a été accompli. Cela ne signifie pas que chaque décision devient parfaitement compréhensible. Cela signifie que le système essaie de laisser une trace montrant qu'une certaine tâche, un certain modèle ou une certaine contribution s'est produite dans des conditions déclarées et que d'autres peuvent vérifier ces affirmations plus tard.

Je croyais auparavant que si vous aviez suffisamment de journaux, vous étiez pratiquement terminé, mais je ne pense plus cela, car les journaux eux-mêmes peuvent être modifiés, cachés ou rédigés de manière à raconter une histoire flatteuse. Ce qui rend l'idée de Fabric plus intéressante, c'est qu'elle essaie d'associer le journalisation à des vérifications économiques et cryptographiques tout en étant également anormalement directe concernant une limite stricte. Elle ne prétend pas que chaque tâche physique peut être vérifiée universellement, car cela serait trop coûteux et, dans de nombreux cas, pas techniquement réaliste. Au lieu de cela, elle propose un système basé sur des défis dans lequel les validateurs surveillent la qualité et la disponibilité, enquêtent sur les litiges et peuvent déclencher des pénalités lorsque la fraude est prouvée. J'apprécie cette honnêteté, car dans les systèmes réels, la question n'est souvent pas « Pouvons-nous prouver tout ? » mais « Quelles preuves pouvons-nous conserver suffisamment à bas coût pour que la tricherie devienne peu attrayante ? »

C'est aussi pourquoi le sujet attire plus d'attention maintenant qu'il y a cinq ans, car le côté technologique a évolué de manière à rendre l'idée plus pratique. Des recherches récentes sur les pipelines d'IA vérifiables de bout en bout indiquent que les avancées dans les signatures numériques, les engagements cryptographiques et les preuves à connaissance nulle rendent plus plausible la preuve de certaines parties du cycle de vie de l'IA, y compris l'inférence, sans exposer des entrées sensibles ou des détails de modèle. En même temps, cette recherche est claire : un pipeline vérifiable de bout en bout est encore plus un cadre et une direction de recherche qu'une réalité achevée. En d'autres termes, les outils deviennent suffisamment réels pour être utilisés, même si l'architecture finie n'est pas encore là, et cela ressemble exactement à la phase où les choix de conception concernant l'auditabilité commencent à compter.

La pression n'est pas seulement technique, car elle est également réglementaire et culturelle. Le cadre de gestion des risques en IA du NIST et son manuel insistent tous deux sur la documentation, la traçabilité et les mécanismes qui rendent les systèmes d'IA vérifiables, y compris la journalisation des processus, des résultats et des impacts. La loi sur l'IA de l'UE va plus loin pour les systèmes à haut risque en exigeant explicitement la journalisation des activités afin d'assurer la traçabilité des résultats, avec de grandes règles de transparence arrivant en 2026. Une fois que les systèmes sont utilisés dans l'embauche, le crédit, les soins de santé, les services publics ou la robotique, « faites-nous confiance » cesse de sembler un modèle de gouvernance sérieux, car l'enregistrement autour d'une décision commence à compter presque autant que la décision elle-même.

Donc, quand je pense à l'inférence vérifiable dans le Fabric Protocol, je n'entends pas une promesse que les machines deviendront moralement auto-explicatives. J'entends une affirmation plus modeste et plus utile selon laquelle une décision devrait laisser suffisamment de preuves structurées pour qu'une autre partie puisse demander ce qui s'est passé, quel modèle ou flux de travail a été utilisé, qui l'a garanti, ce qui peut être vérifié et que se passe-t-il si l'enregistrement ne tient pas. Cela me semble être une norme plus saine, car cela ne promet pas de certitude ou de visibilité parfaite. Cela demande quelque chose de plus ancré que cela. Cela demande un système qui s'attend à des doutes, conserve des reçus et considère la vérification comme faisant partie du travail plutôt que comme une réflexion après coup.

@Fabric Foundation #ROBO #robo $ROBO