L'une des choses étranges concernant les systèmes d'IA modernes est leur capacité à présenter des informations incorrectes avec tant de confiance. Quiconque a utilisé un grand modèle de langage suffisamment longtemps a déjà vu cela se produire. La réponse semble soignée, le raisonnement paraît logique, mais quelque part dans la réponse, il y a une affirmation qui n'est tout simplement pas vraie. Cet écart de fiabilité devient l'un des problèmes centraux de l'IA appliquée.

La plupart des tentatives pour résoudre ce problème se concentrent sur l'amélioration du modèle lui-même. De meilleures données d'entraînement, des architectures plus grandes et des techniques de sollicitation améliorées aident toutes. Mais une autre idée émerge. Au lieu de faire confiance à un seul modèle, que se passerait-il si la sortie pouvait être vérifiée par de nombreux systèmes indépendants avant que quiconque ne s'y fie?

C'est à peu près l'idée derrière @Mira - Trust Layer of AI .

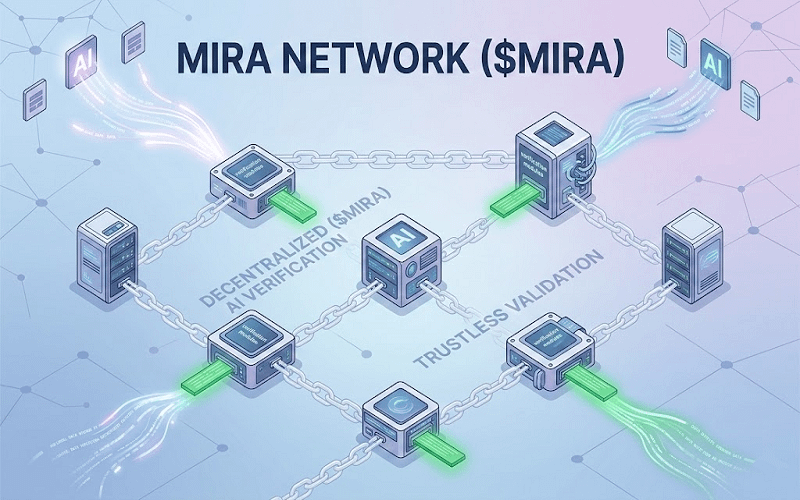

Mira Network est conçu comme une couche de vérification pour le contenu généré par l'IA. Au lieu de traiter une réponse d'IA comme une réponse terminée, le réseau la considère comme quelque chose qui peut être vérifié. Le système prend la sortie d'un modèle et la décompose en revendications factuelles plus petites. Chaque revendication est ensuite évaluée par d'autres modèles d'IA indépendants dans le réseau.

Le processus fonctionne un peu comme une révision par les pairs distribuée.

Lorsque l'IA produit une réponse, Mira analyse d'abord le texte pour identifier les déclarations qui peuvent être vérifiées. Par exemple, si une réponse comprend des faits historiques, des revendications numériques ou des relations définissables, celles-ci deviennent des unités de vérification individuelles. Ces unités sont ensuite envoyées à plusieurs modèles indépendants qui examinent la revendication et déterminent si elle semble correcte en fonction des connaissances disponibles.

Parce que plusieurs modèles participent, le système ne s'appuie pas sur une seule perspective. L'accord entre plusieurs validateurs augmente la confiance dans la revendication. Le désaccord signale une incertitude et peut abaisser le score de fiabilité de la réponse globale.

C'est ici que l'infrastructure blockchain entre en jeu.

Les résultats de vérification de chaque modèle sont enregistrés et finalisés par un processus de consensus blockchain. Au lieu de faire confiance à une seule autorité centralisée pour déterminer si une revendication est valide, le réseau enregistre les décisions et les preuves cryptographiques dans un registre transparent. Cela crée une histoire résistante à la falsification de la manière dont chaque revendication a été évaluée.

Le jeton $MIRA fonctionne dans ce système comme partie de la couche de coordination. Les participants qui exécutent des modèles de vérification ou contribuent à un travail computationnel sont récompensés par la structure d'incitation du réseau. En théorie, cela encourage un écosystème distribué où de nombreux acteurs indépendants aident à vérifier les sorties de l'IA.

Les projets discutant de #MiraNetwork se concentrent souvent sur cette idée de validation décentralisée. L'objectif plus large n'est pas de remplacer les modèles d'IA mais de construire une seconde couche qui vérifie leur travail.

Il y a des avantages pratiques à cette approche. Si cela réussit, un réseau de vérification pourrait réduire le risque d'hallucinations de l'IA dans les domaines où la précision est importante. Les résumés de recherche, les explications techniques et les systèmes de reporting automatisés pourraient tous bénéficier d'une vérification indépendante des revendications avant d'être acceptées comme fiables.

En même temps, l'idée a des limites.

Les modèles de vérification peuvent encore faire des erreurs. Si de nombreux systèmes partagent des données d'entraînement ou des biais similaires, ils peuvent répéter les mêmes erreurs. Diviser le texte en revendications vérifiables est également difficile pour un raisonnement complexe ou des interprétations subjectives. Tout ce qu'une IA écrit ne peut pas être facilement réduit à une simple vérification des faits.

Pourtant, le concept derrière #Mira est intéressant car il déplace la discussion loin de la construction d'une IA parfaite. Au lieu de cela, il traite les sorties de l'IA comme quelque chose qui doit être examiné, comparé et validé par un réseau de systèmes indépendants.

Dans ce sens, Mira Network concerne moins le remplacement du jugement humain et plus la création d'une infrastructure qui aide les machines à se vérifier avant que nous décidions de faire confiance au résultat.