J'ai passé assez de temps à intégrer des systèmes d'IA dans des flux de travail réels pour connaître une vérité inconfortable : la plupart de l'industrie célèbre la production, pas la responsabilité. Des métriques comme la taille du modèle, les scores de référence et les utilisateurs quotidiens semblent impressionnants sur les tableaux de bord, mais elles ne vous disent que rarement si les réponses entrant dans les systèmes de production sont réellement fiables. Lorsque vous êtes responsable d'une infrastructure réelle, la différence entre « semble correct » et « est prouvé correct » devient douloureusement claire.

C'est là que l'architecture derrière le réseau Mira commence à avoir du sens pour moi.

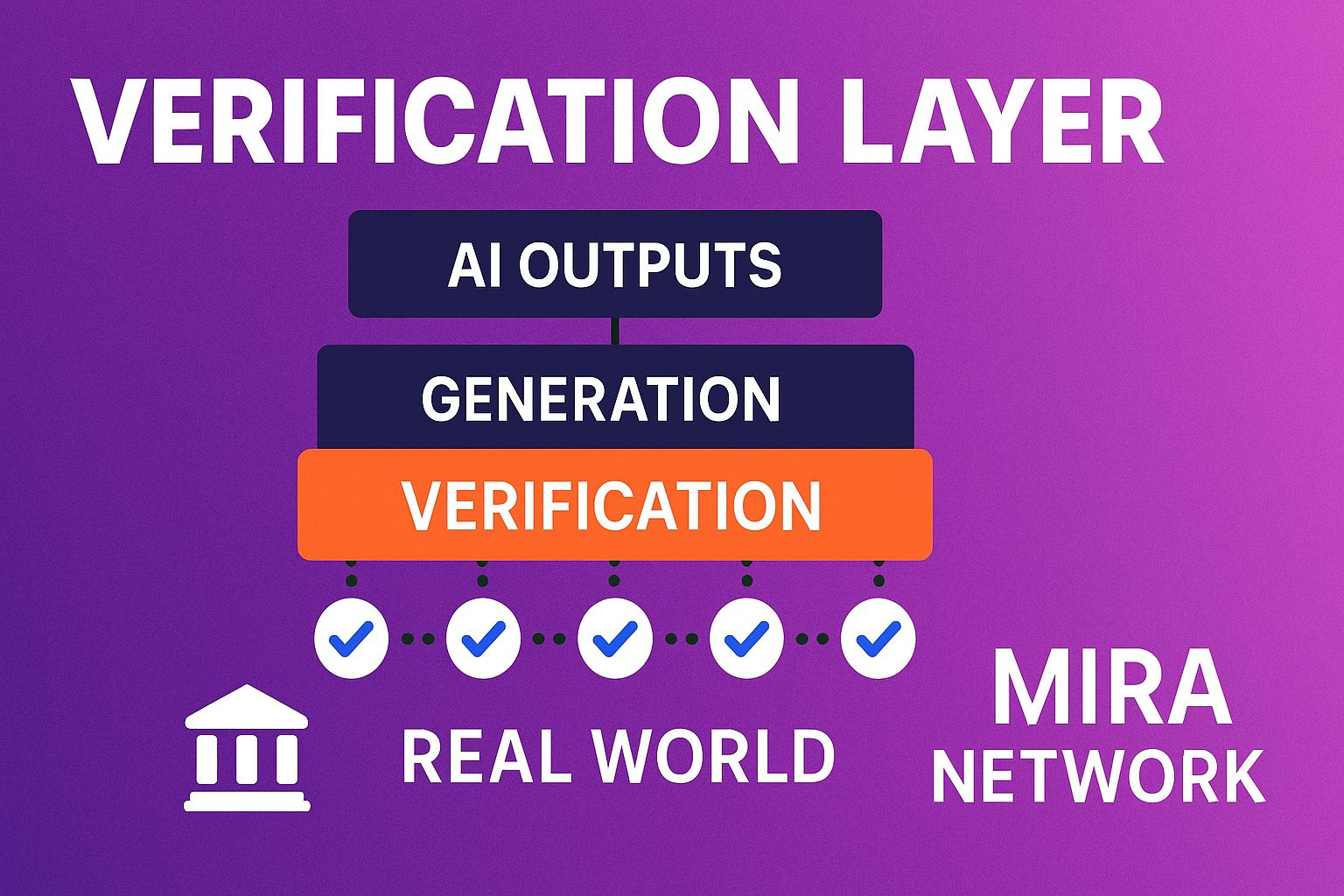

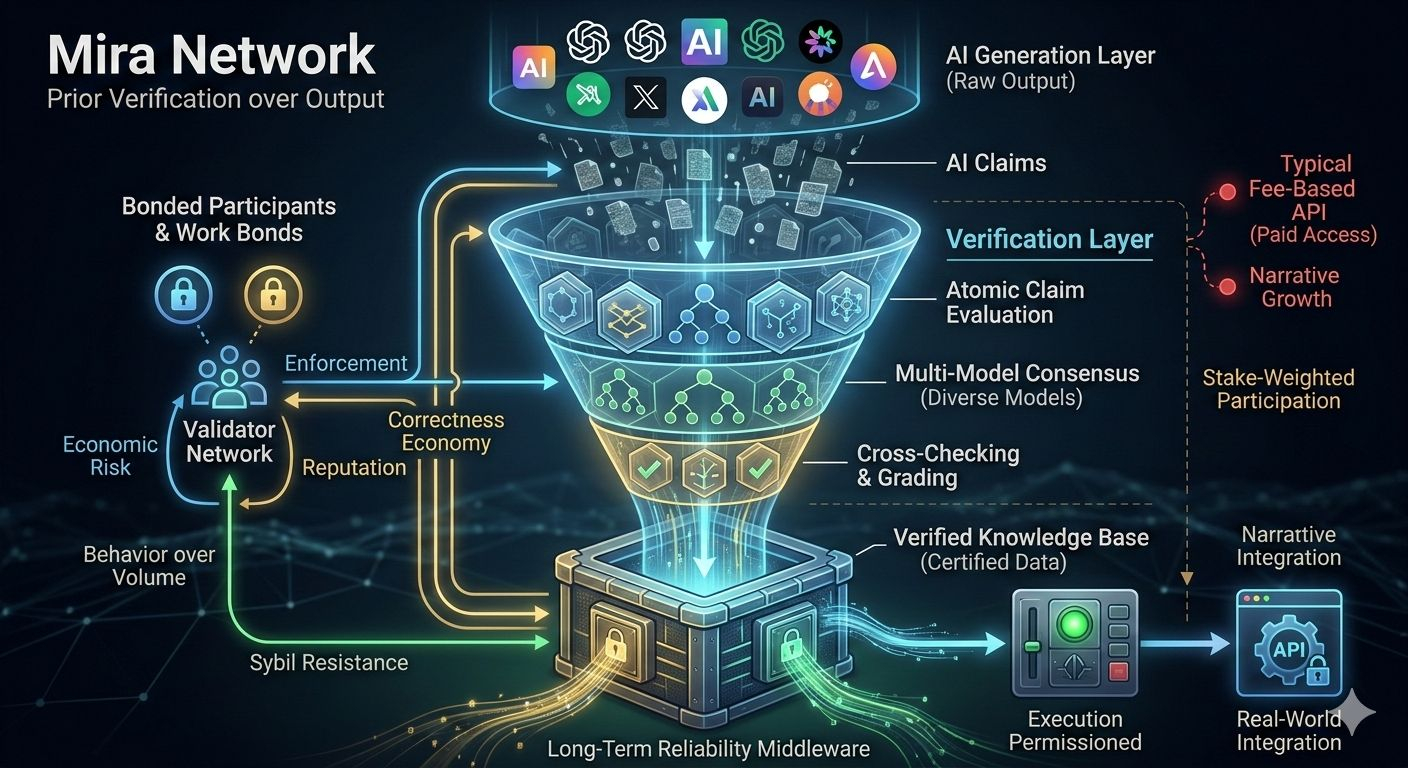

Du point de vue d'un opérateur, la partie intéressante n'est pas la couche de génération — c'est la couche de vérification qui se situe entre les sorties de l'IA et l'exécution dans le monde réel. Mira traite les réponses de l'IA comme des matières premières, pas comme une vérité finale. Les revendications sont décomposées en plus petits composants atomiques et évaluées à travers plusieurs modèles avec différentes perspectives. Ce n'est qu'après l'émergence d'un consensus que le système permet à la réponse de passer à quelque chose de plus proche de la connaissance certifiée.

Ce qui compte ici n'est pas la croissance narrative mais l'application.

La plupart des plateformes d'IA reposent sur un accès payant : vous payez pour les appels API et espérez que le modèle se comporte bien. Mais les frais seuls ne créent pas de responsabilité. La conception de Mira s'oriente davantage vers une participation pondérée par la mise et des obligations de travail, où les acteurs du processus de vérification portent une exposition économique liée à la justesse. En d'autres termes, la participation n'est pas seulement rémunérée — elle est garantie.

Cette différence est subtile mais critique.

Les systèmes basés sur des frais s'optimisent pour le volume d'utilisation. Les systèmes garantis s'optimisent pour le comportement. Lorsque les participants risquent leur mise ou leur réputation à travers un travail garanti, l'exactitude devient une stratégie rationnelle plutôt qu'une revendication marketing. Cela transforme le réseau d'un marché de services en quelque chose de plus proche d'une économie de justesse.

Les implications pour l'infrastructure sont significatives.

La vérification multi-modèle introduit la diversité dans le jugement. L'évaluation des revendications atomiques empêche les grandes hallucinations de passer inaperçues. Et l'application au niveau du protocole crée une forme de résistance Sybil où inonder le système de faux validateurs devient économiquement coûteux plutôt que trivialement bon marché.

Au fil du temps, les faits vérifiés s'accumulent en une couche de fond synthétique — une base de connaissances à laquelle les futurs modèles peuvent se référer sans recalculer la confiance depuis le début. À ce moment-là, Mira cesse d'être simplement un autre outil d'IA et commence à se comporter comme un middleware de fiabilité entre la génération d'IA et les systèmes de décision du monde réel.

Et c'est l'élément que la plupart des gens sous-estiment.

À long terme, l'infrastructure gagne non pas parce qu'elle commercialise mieux, mais parce qu'elle impose un meilleur comportement. L'architecture de Mira penche vers l'application. Que le marché reconnaisse cela tôt ou tard est une autre question entièrement.

@Mira - Trust Layer of AI #mira #MIRA $MIRA