Dans le rapport de juin (Le Saint Graal de Crypto AI : Exploration de l'avant-garde de l'entraînement décentralisé), nous mentionnons l'apprentissage fédéré (Federated Learning), un schéma de "décentralisation contrôlée" qui se situe entre l'entraînement distribué et l'entraînement décentralisé : son cœur est la conservation locale des données et l'agrégation centralisée des paramètres, répondant aux exigences de confidentialité et de conformité dans des domaines tels que la santé et la finance. Parallèlement, nous avons continuellement suivi l'émergence des réseaux d'agents (Agent) dans nos précédents rapports - leur valeur réside dans la capacité d'accomplir des tâches complexes par le biais de l'autonomie et de la division du travail entre plusieurs agents, stimulant l'évolution des "grands modèles" vers l'écologie des "multi-agents".

L'apprentissage fédéré établit la base de la coopération multipartite avec "les données ne sortent pas localement, les incitations selon la contribution", dont les gènes distribués, les incitations transparentes, la protection de la vie privée et les pratiques de conformité fournissent des expériences directement réutilisables pour le réseau d'agents. L'équipe FedML suit cette voie, passant du gène open-source à TensorOpera (couche d'infrastructure de l'industrie AI), puis évoluant vers ChainOpera (réseau d'agents décentralisé). Bien sûr, le réseau d'agents n'est pas une extension inévitable de l'apprentissage fédéré, son cœur réside dans l'autonomie collaborative et la répartition des tâches entre plusieurs agents, pouvant également être construit directement sur des systèmes multi-agents (MAS), l'apprentissage par renforcement (RL) ou des mécanismes d'incitation basés sur la blockchain.

Un, architecture technologique de l'apprentissage fédéré et des agents AI

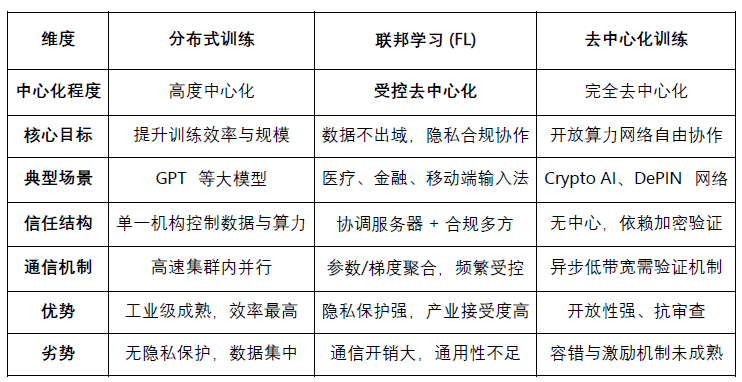

L'apprentissage fédéré (Federated Learning, FL) est un cadre de formation collaborative sans centralisation des données, dont le principe de base est que chaque partie participante forme le modèle localement, ne téléchargeant que les paramètres ou les gradients à un point de coordination pour l'agrégation, réalisant ainsi une conformité à la vie privée où "les données ne sortent pas du domaine". Grâce à des pratiques dans des scénarios typiques tels que la santé, la finance et les dispositifs mobiles, l'apprentissage fédéré a atteint une phase commerciale relativement mature, mais il fait encore face à des goulots d'étranglement tels que de fortes dépenses de communication, une protection de la vie privée incomplète et une convergence inefficace due à l'hétérogénéité des dispositifs. Comparé à d'autres modes d'entraînement, l'entraînement distribué met l'accent sur la concentration de la puissance de calcul pour poursuivre l'efficacité et l'échelle, l'entraînement décentralisé réalise une coopération totalement distribuée par le biais d'un réseau de puissance de calcul ouvert, tandis que l'apprentissage fédéré se situe entre les deux, se manifestant comme un schéma "décentralisé contrôlé" : il peut répondre aux besoins de l'industrie en matière de confidentialité et de conformité, tout en offrant des cheminements viables pour la collaboration inter-institutions, plus adapté aux architectures de déploiement transitoires dans l'industrie.

Dans l'ensemble de la pile de protocoles AI Agent, nous l'avons divisée en trois niveaux principaux dans nos précédents rapports, à savoir

Couche d'infrastructure (Agent Infrastructure Layer) : cette couche fournit le support d'exécution le plus basique pour les agents, formant la base technique de tous les systèmes d'agents construits.

Modules clés : y compris Agent Framework (cadre de développement et d'exécution d'agents) et Agent OS (système d'exploitation modulaire et de planification multi-tâches à un niveau plus bas), fournissant des capacités essentielles pour la gestion du cycle de vie des agents.

Modules de soutien : tels qu'Agent DID (identité décentralisée), Agent Wallet & Abstraction (abstraction de compte et exécution de transactions), Agent Payment/Settlement (capacités de paiement et de règlement).

La couche de coordination et de planification (Coordination & Execution Layer) se concentre sur la synergie entre plusieurs agents, la planification des tâches et le mécanisme d'incitation du système, étant clé pour construire l'intelligence collective des systèmes d'agents.

Orchestration d'agents : mécanisme de commande utilisé pour unifier la planification et la gestion du cycle de vie des agents, la répartition des tâches et les processus d'exécution, adapté aux scénarios de flux de travail avec contrôle central.

Essaim d'agents : structure collaborative mettant l'accent sur la coopération des agents distribués, dotée d'une grande autonomie, de capacités de division du travail et de collaboration flexible, adaptée aux tâches complexes dans des environnements dynamiques.

Couche d'incitation des agents : construit le système d'incitation économique du réseau d'agents, stimulant l'engagement des développeurs, des exécuteurs et des validateurs, fournissant une dynamique durable à l'écosystème des agents.

Couche d'application (Application & Distribution Layer)

Sous-catégories de distribution : incluant Agent Launchpad, Agent Marketplace et Agent Plugin Network

Sous-catégories d'application : couvrant AgentFi, Agent Native DApp, Agent-as-a-Service, etc.

Sous-catégories de consommation : principalement Agent Social / Consumer Agent, visant des scénarios légers pour les consommateurs.

Meme : spéculation sur le concept d'Agent, manquant de mise en œuvre technique réelle et de déploiement d'application, uniquement motivé par le marketing.

Deux, l'apprentissage fédéré Benchmark FedML et la plateforme Full Stack TensorOpera

FedML est l'un des premiers cadres open-source dédié à l'apprentissage fédéré (Federated Learning) et à l'entraînement distribué, issu d'une équipe académique (USC) et devenu progressivement le produit phare de TensorOpera AI. Il fournit aux chercheurs et aux développeurs des outils de formation collaborative de données inter-institutions et inter-appareils. Dans le milieu académique, FedML est devenu une plateforme expérimentale universelle pour la recherche sur l'apprentissage fédéré, apparaissant fréquemment dans des conférences prestigieuses telles que NeurIPS, ICML, AAAI. Dans l'industrie, FedML jouit d'une bonne réputation dans des scénarios sensibles à la vie privée tels que la santé, la finance, l'IA en périphérie et l'IA Web3, étant considéré comme une chaîne d'outils emblématique dans le domaine de l'apprentissage fédéré.

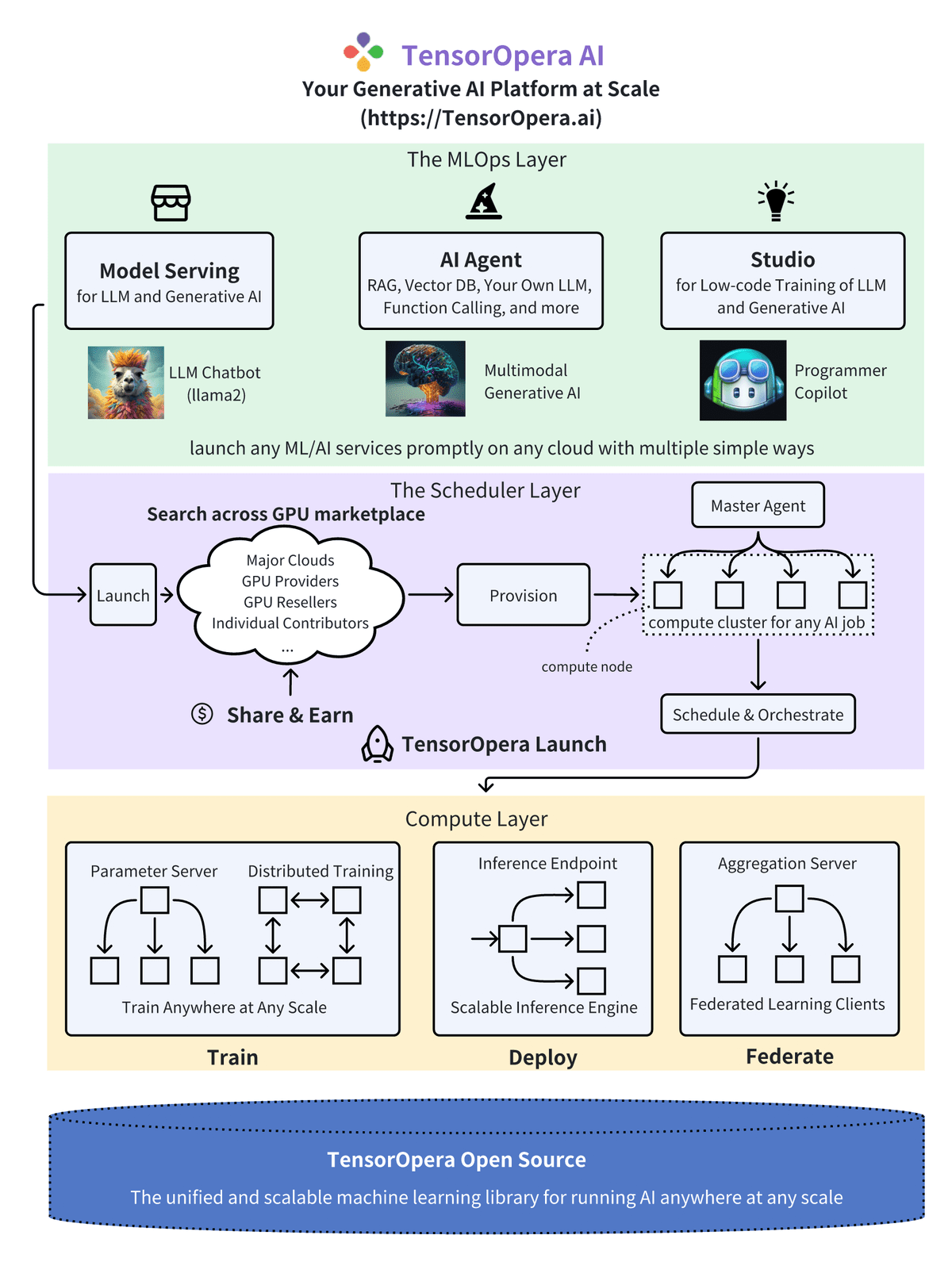

TensorOpera est la plateforme d'infrastructure AI Full Stack orientée vers les entreprises et les développeurs, issue de la commercialisation de FedML : tout en conservant la capacité d'apprentissage fédéré, elle s'étend à GPU Marketplace, services de modèles et MLOps, pénétrant ainsi un marché plus vaste à l'ère des grands modèles et des agents. L'architecture globale de TensorOpera peut être divisée en trois niveaux : Compute Layer (couche de base), Scheduler Layer (couche de planification) et MLOps Layer (couche d'application).

1. Couche de calcul (Compute Layer)

La couche Compute est la base technique de TensorOpera, poursuivant le gène open-source de FedML. Ses principales fonctionnalités incluent le serveur de paramètres, l'entraînement distribué, le point de terminaison d'inférence et le serveur d'agrégation. Sa valeur est de fournir un apprentissage fédéré avec protection de la vie privée et un moteur d'inférence évolutif, soutenant les trois capacités centrales "Former / Déployer / Fédérer", couvrant l'ensemble du lien de formation de modèles, de déploiement à la collaboration inter-institutions, et constituant la couche de base de l'ensemble de la plateforme.

2. Couche de planification (Scheduler Layer)

La couche de planification est équivalente à un centre d'échange et de gestion de la puissance de calcul, composé de GPU Marketplace, Provision, Master Agent et Schedule & Orchestrate, prenant en charge les appels de ressources entre les clouds publics, les fournisseurs de GPU et les contributeurs indépendants. Cette couche est le tournant clé pour FedML se transformant en TensorOpera, capable de réaliser une formation AI et un raisonnement à plus grande échelle grâce à la planification intelligente de la puissance de calcul et à l'orchestration des tâches, couvrant des scénarios typiques de LLM et d'AI générative. En même temps, le modèle Share & Earn de cette couche réserve une interface pour le mécanisme d'incitation, compatible avec le modèle DePIN ou Web3.

3. Couche MLOps (couche supérieure)

La couche MLOps est l'interface de service directe de la plateforme destinée aux développeurs et aux entreprises, incluant Model Serving, AI Agent et Studio. Les applications typiques couvrent LLM Chatbot, AI générative multimodale et outils Copilot pour développeurs. Sa valeur réside dans l'abstraction des capacités de calcul et d'entraînement de bas niveau en API et produits de haut niveau, abaissant les barrières à l'utilisation, offrant des agents prêts à l'emploi, un environnement de développement à faible code et une capacité de déploiement extensible, se positionnant par rapport aux nouvelles plateformes AI Infra de nouvelle génération telles qu'Anyscale, Together, Modal, agissant comme un pont entre l'infrastructure et l'application.

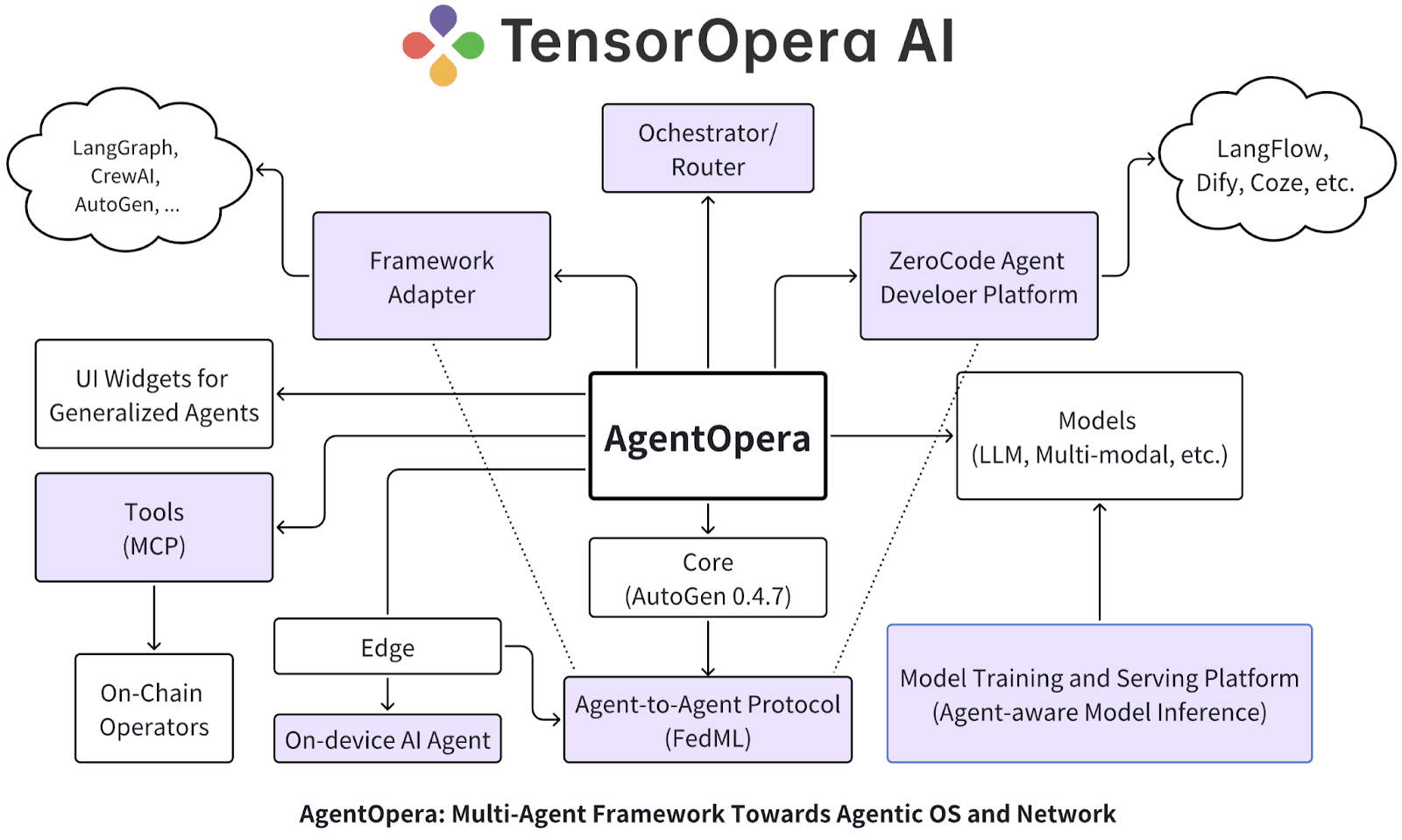

En mars 2025, TensorOpera a été mis à niveau vers une plateforme Full Stack orientée vers les agents AI, ses produits phares englobant AgentOpera AI App, Framework et Platform. La couche d'application fournit un accès multi-agents similaire à ChatGPT, la couche de framework évolue en un "Agentic OS" à structure graphique pour les systèmes multi-agents et l'Orchestrator/Router, tandis que la couche de plateforme s'intègre profondément avec la plateforme de modèles TensorOpera et FedML, réalisant des services de modèles distribués, l'optimisation RAG et le déploiement hybride sur le cloud. L'objectif global est de créer "un système d'exploitation, un réseau d'agents", permettant aux développeurs, entreprises et utilisateurs de co-construire un nouvel écosystème AI Agentic dans un environnement ouvert et respectueux de la vie privée.

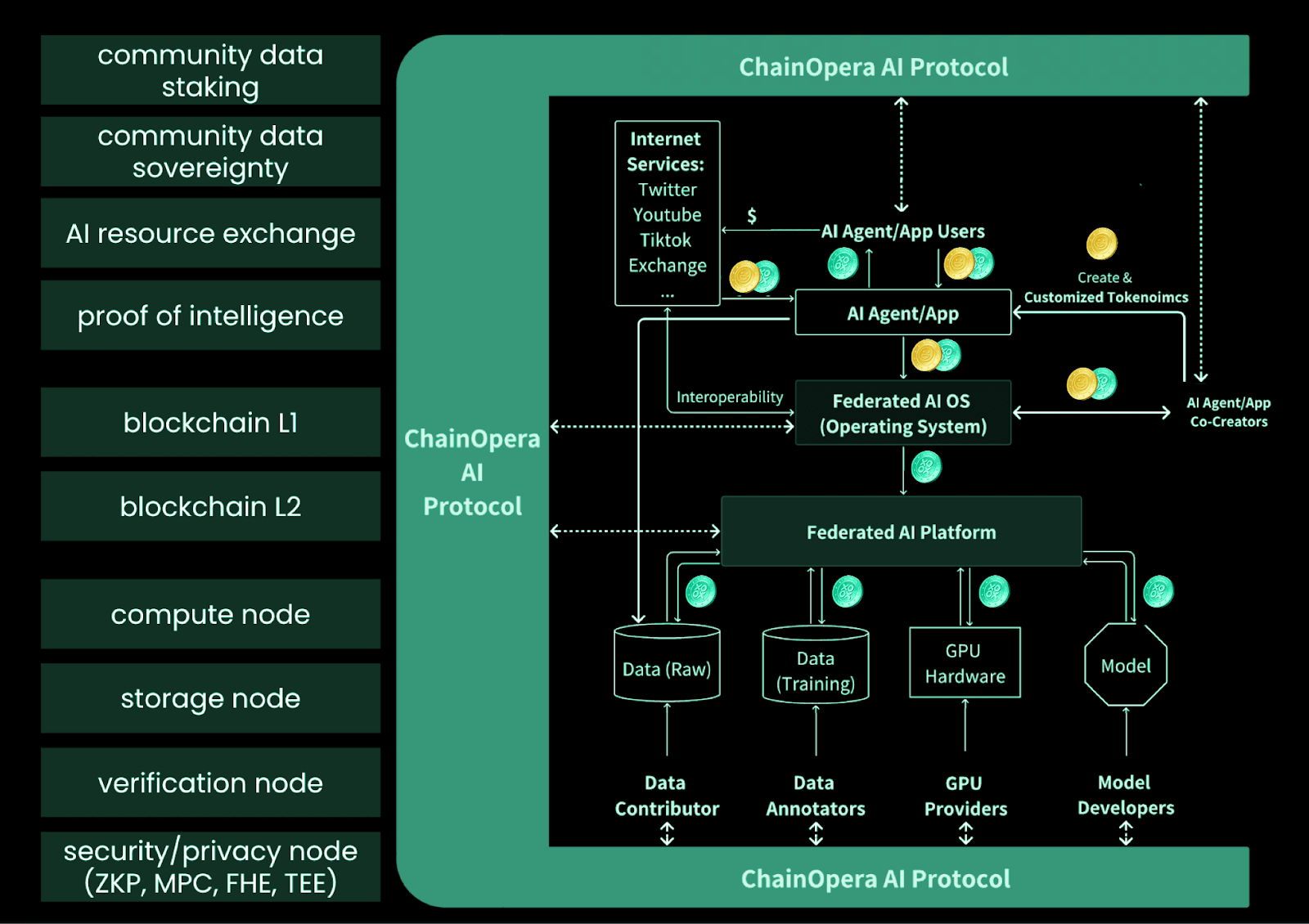

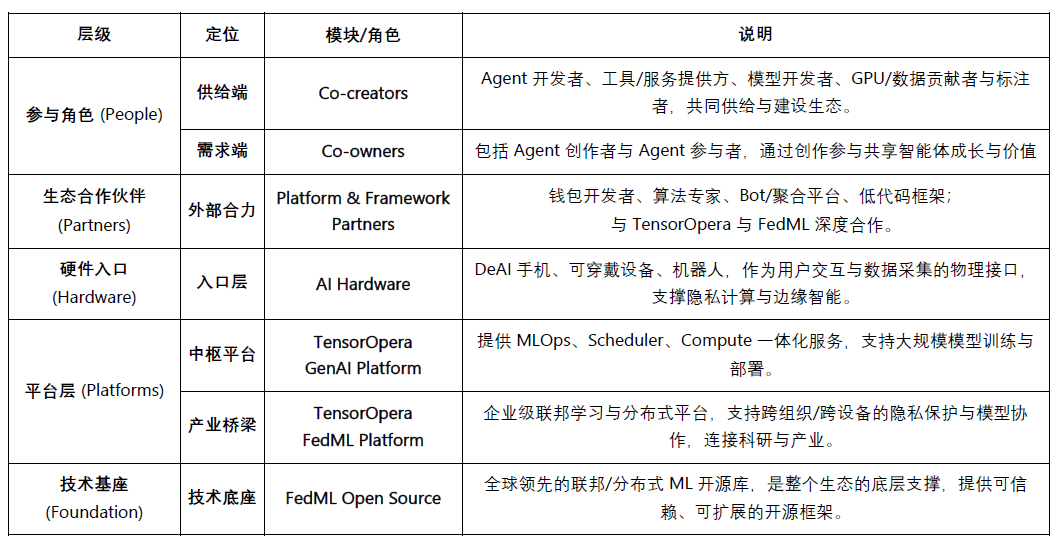

Trois, Panorama de l'écosystème ChainOpera AI : des co-créateurs aux bases technologiques

Si FedML est le noyau technique, fournissant le gène open-source pour l'apprentissage fédéré et l'entraînement distribué ; TensorOpera abstrait les résultats de recherche de FedML en une infrastructure AI Full Stack commercialisable, alors ChainOpera transcrit les capacités de la plateforme TensorOpera "sur la chaîne", en construisant un réseau d'agents décentralisé via AI Terminal + Agent Social Network + modèle DePIN et couche de puissance + blockchain native AI. La transformation centrale réside dans le fait que TensorOpera est principalement orienté vers les entreprises et les développeurs, tandis que ChainOpera, grâce à une gouvernance et des mécanismes d'incitation orientés Web3, inclut les utilisateurs, développeurs, fournisseurs de GPU/données dans la co-construction et la co-gouvernance, rendant les agents AI non seulement "utilisés", mais "co-créés et co-possédés".

Écosystème de co-créateurs (Co-creators)

ChainOpera AI fournit des chaînes d'outils, des infrastructures et des niveaux de coordination pour la co-création de l'écosystème via la plateforme Model & GPU et la plateforme Agent, prenant en charge l'entraînement de modèles, le développement d'agents, le déploiement et la collaboration d'expansion.

Les co-créateurs de l'écosystème ChainOpera englobent des développeurs d'agents AI (conception et opération d'agents), des fournisseurs d'outils et de services (modèles, MCP, bases de données et API), des développeurs de modèles (formation et publication de modèles), des fournisseurs de GPU (contribuant de la puissance de calcul via DePIN et des partenaires cloud Web2) et des contributeurs et annotateurs de données (téléchargeant et annotant des données multimodales). Ces trois types d'offres essentielles - développement, puissance de calcul et données - propulsent ensemble la croissance continue du réseau d'agents.

Co-propriétaires (Co-owners)

L'écosystème ChainOpera introduit également le mécanisme de co-propriété, construisant le réseau par la coopération et la participation. Les créateurs d'agents AI sont des individus ou des équipes qui conçoivent et déploient de nouveaux agents intelligents via la plateforme d'agents, responsables de la construction, du lancement et de la maintenance continue, stimulant ainsi l'innovation des fonctionnalités et des applications. Les participants agents AI proviennent de la communauté, participant à la durée de vie des agents en obtenant et en détenant des unités d'accès (Access Units), soutenant la croissance et l'activité des agents dans le processus d'utilisation et de promotion. Les deux types de rôles représentent respectivement l'offre et la demande, formant ensemble un modèle de partage de valeur et de développement collaboratif au sein de l'écosystème.

Partenaires écologiques : plateformes et cadres

ChainOpera AI collabore avec de nombreuses parties pour renforcer l'utilisabilité et la sécurité de la plateforme, tout en intégrant des scénarios Web3 : à travers l'application AI Terminal, elle associe portefeuilles, algorithmes et plateformes d'agrégation pour réaliser des recommandations de services intelligents ; sur la plateforme des agents, elle introduit divers cadres et outils sans code pour abaisser les barrières au développement ; s'appuie sur TensorOpera AI pour la formation et l'inférence des modèles ; et établit une collaboration exclusive avec FedML pour soutenir l'entraînement respectant la vie privée entre institutions et appareils. Globalement, cela forme un écosystème ouvert équilibrant applications de niveau entreprise et expérience utilisateur Web3.

Entrée matérielle : AI matériel et partenaires (AI Hardware & Partners)

Grâce à des partenaires tels que DeAI Phone, des dispositifs portables et Robot AI, ChainOpera fusionne blockchain et AI dans des terminaux intelligents, réalisant des interactions dApp, un entraînement côté client et une protection de la vie privée, formant progressivement un écosystème AI matériel décentralisé.

Plateforme centrale et base technique : TensorOpera GenAI & FedML

TensorOpera offre une plateforme GenAI Full Stack couvrant MLOps, Scheduler et Compute ; sa sous-plateforme FedML a évolué d'une open-source académique à un cadre industrialisé, renforçant la capacité de l'AI à "fonctionner partout et à s'étendre de manière illimitée".

Écosystème ChainOpera AI

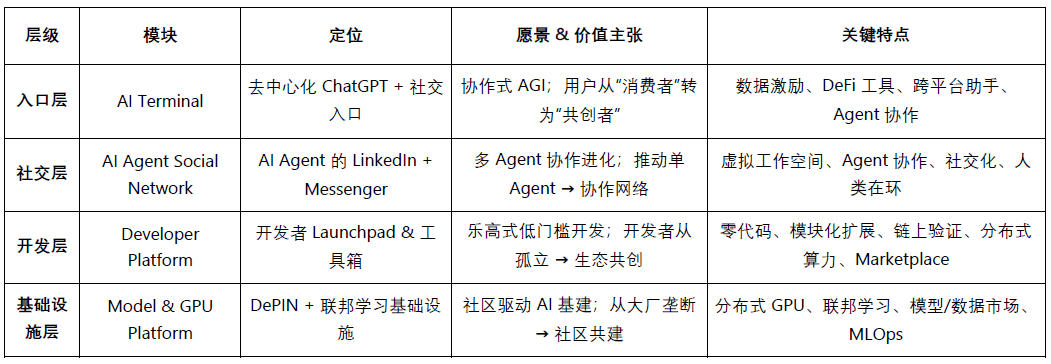

Quatre, produits phares de ChainOpera et infrastructure AI Full Stack

En juin 2025, ChainOpera lancera officiellement l'application AI Terminal et la pile technologique décentralisée, se positionnant comme "OpenAI décentralisé", ses produits phares englobant quatre grands modules : couche d'application (AI Terminal & Agent Network), couche de développeurs (Agent Creator Center), couche de modèles et de GPU (Model & Compute Network), ainsi que le protocole CoAI et une chaîne dédiée, couvrant l'ensemble du cycle fermé allant de l'entrée utilisateur à la puissance de base et aux incitations sur la chaîne.

L'application AI Terminal a déjà intégré BNBChain, prenant en charge les transactions sur la chaîne et les scénarios DeFi des agents. Le centre de création d'agents est ouvert aux développeurs, fournissant des capacités telles que MCP/HUB, une base de connaissances et RAG, avec des agents communautaires continuant à s'installer ; tout en lançant l'alliance CO-AI, en collaboration avec io.net, Render, TensorOpera, FedML, MindNetwork et d'autres partenaires.

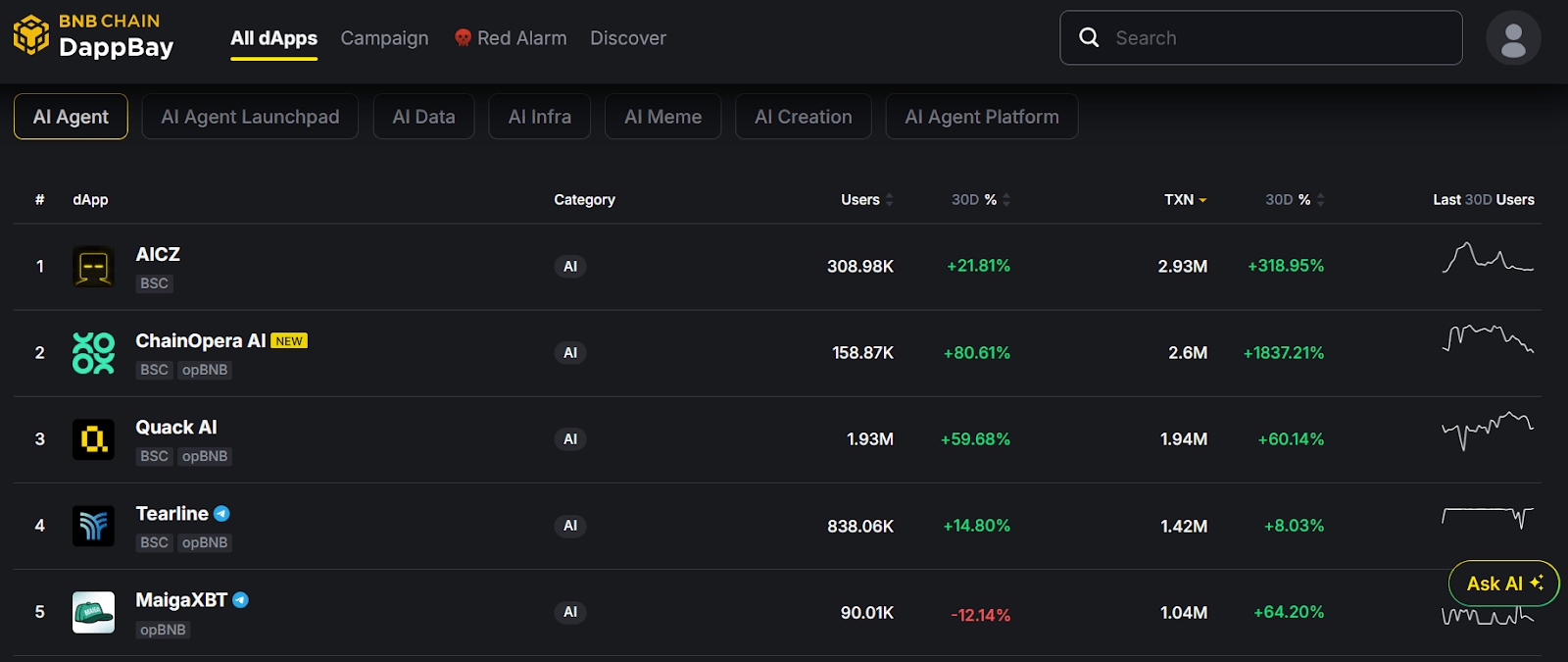

Selon les données sur la chaîne des 30 derniers jours de BNB DApp Bay, ses utilisateurs uniques s'élèvent à 158,87K, avec un volume de transactions de 2,6 millions au cours des 30 derniers jours, se classant au deuxième rang dans la catégorie "AI Agent" de BSC, montrant une forte activité sur la chaîne.

Super AI Agent App – AI Terminal (https://chat.chainopera.ai/)

En tant qu'accès décentralisé à ChatGPT et à la socialisation AI, AI Terminal offre une collaboration multimodale, des incitations à la contribution de données, une intégration d'outils DeFi, un assistant multi-plateforme, et prend en charge la collaboration et la protection de la vie privée des agents AI (Vos données, Votre agent). Les utilisateurs peuvent directement appeler le modèle open-source DeepSeek-R1 et des agents communautaires via des appareils mobiles, avec des jetons linguistiques et des jetons cryptographiques circulant de manière transparente sur la chaîne. Sa valeur réside dans la transformation des utilisateurs de "consommateurs de contenu" en "co-créateurs intelligents", capables d'utiliser des réseaux d'agents dédiés dans des scénarios DeFi, RWA, PayFi, commerce électronique, etc.

Réseau Social AI Agent (https://chat.chainopera.ai/agent-social-network)

Visant à ressembler à LinkedIn + Messenger, mais pour les agents AI. Grâce à un espace de travail virtuel et à un mécanisme de collaboration Agent-à-Agent (MetaGPT, ChatDEV, AutoGEN, Camel), il promeut l'évolution d'un agent unique en un réseau de collaboration multi-agents, couvrant des applications dans la finance, les jeux, le commerce électronique, la recherche, etc., tout en renforçant progressivement la mémoire et l'autonomie.

Plateforme de développeurs AI Agent (https://agent.chainopera.ai/)

Fournit une expérience de création "type Lego" pour les développeurs. Prend en charge l'absence de code et l'expansion modulaire, les contrats blockchain garantissant la propriété, DePIN + l'infrastructure cloud abaissant les barrières à l'entrée, le Marketplace fournissant des canaux de distribution et de découverte. Son cœur réside dans le fait de permettre aux développeurs d'atteindre rapidement les utilisateurs, les contributions à l'écosystème pouvant être enregistrées de manière transparente et obtenir des incitations.

AI Model & GPU Platform (https://platform.chainopera.ai/)

En tant que couche d'infrastructure, combinant DePIN et apprentissage fédéré, elle résout les points de douleur liés à la dépendance des AI Web3 à la puissance de calcul centralisée. Grâce à des GPU distribués, un entraînement de données protégeant la vie privée, un marché de modèles et de données, ainsi qu'un MLOps de bout en bout, elle prend en charge la collaboration multi-agents et l'AI personnalisée. Sa vision est de promouvoir un changement de paradigme d'infrastructure de "monopole par de grandes entreprises" vers "co-construction par la communauté".

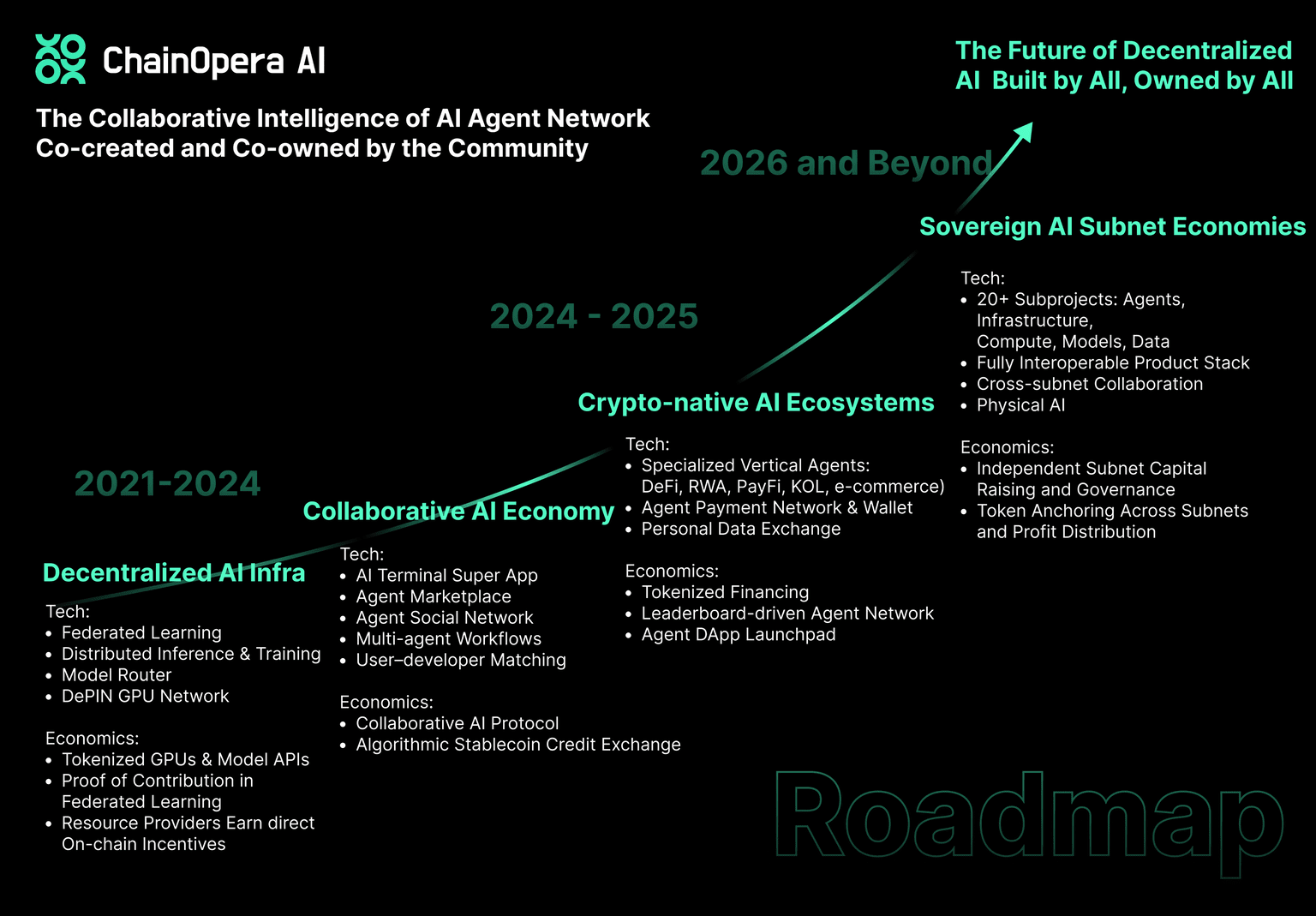

Cinq, Planification de la feuille de route de ChainOpera AI

En plus d'avoir officiellement lancé la plateforme AI Agent Full Stack, ChainOpera AI est convaincu que l'intelligence artificielle générale (AGI) provient d'un réseau de coopération multi-modal et multi-agents. Ainsi, sa feuille de route à long terme est planifiée en quatre phases :

Phase un (Compute → Capital) : construire une infrastructure décentralisée, y compris un réseau GPU DePIN, une plateforme d'apprentissage fédéré et d'entraînement/raisonnement distribué, et introduire un routeur de modèles (Model Router) pour coordonner le raisonnement multi-terminaux ; à travers des mécanismes d'incitation permettant aux fournisseurs de puissance, de modèles et de données de recevoir des bénéfices répartis selon leur utilisation.

Phase deux (Applications agentiques → Économie AI collaborative) : lancer AI Terminal, Agent Marketplace et Agent Social Network, formant un écosystème d'applications multi-agents ; à travers le protocole CoAI connectant utilisateurs, développeurs et fournisseurs de ressources, et introduisant un système de correspondance entre les besoins des utilisateurs et les développeurs, ainsi qu'un système de crédit, promouvant les interactions fréquentes et l'activité économique continue.

Phase trois (AI collaborative → AI native crypto) : déployer dans des domaines tels que DeFi, RWA, paiements, commerce électronique, tout en s'étendant aux scénarios KOL et d'échange de données personnelles ; développer des LLM dédiés aux services financiers/cryptographiques et lancer un système de paiement et de portefeuille Agent-à-Agent, incitant à l'application scénaristique de "Crypto AGI".

Phase quatre (Écosystèmes → Économies AI autonomes) : évoluer progressivement vers une économie de sous-réseaux autonomes, chaque sous-réseau gouvernant indépendamment autour des applications, infrastructures, puissances, modèles et données, et opérant en tokenisant, tout en collaborant via des protocoles inter-sous-réseaux, formant un écosystème de sous-réseaux collaboratifs ; tout en passant d'AI agentique à AI physique (robots, véhicules autonomes, aéronautique).

Avertissement : Cette feuille de route est à titre de référence uniquement, le calendrier et les fonctionnalités peuvent être ajustés en fonction de l'environnement du marché, sans garantir de promesse de livraison.

Sept, incitations aux jetons et gouvernance des protocoles

Actuellement, ChainOpera n'a pas encore publié de plan complet d'incitations aux jetons, mais son protocole CoAI est centré sur "co-créer et co-posséder", réalisant des enregistrements de contributions transparents et vérifiables grâce à la blockchain et au mécanisme Proof-of-Intelligence : les contributions des développeurs, de la puissance de calcul, des données et des fournisseurs de services sont mesurées et récompensées de manière standardisée, les utilisateurs utilisant les services, les fournisseurs de ressources soutenant le fonctionnement, et les développeurs construisant des applications, toutes les parties prenantes partageant les bénéfices de la croissance ; la plateforme maintient un cycle via des frais de service de 1%, des récompenses et un soutien à la liquidité, promouvant un écosystème AI décentralisé ouvert, équitable et collaboratif.

Cadre d'apprentissage Proof-of-Intelligence

Le Proof-of-Intelligence (PoI) est le mécanisme de consensus central proposé par ChainOpera dans le protocole CoAI, visant à établir un système d'incitation et de gouvernance transparent, équitable et vérifiable pour la construction d'une AI décentralisée. Basé sur un cadre d'apprentissage machine collaboratif en blockchain appelé Proof-of-Contribution (preuve de contribution), il vise à résoudre les problèmes d'insuffisance d'incitation, de risques de confidentialité et de manque de vérifiabilité dans l'application pratique de l'apprentissage fédéré (FL). Ce design repose sur des contrats intelligents, combinant stockage décentralisé (IPFS), nœuds d'agrégation et preuves à divulgation nulle de connaissance (zkSNARKs), réalisant cinq objectifs : ① Répartition équitable des récompenses selon la contribution, garantissant que les formateurs reçoivent des incitations basées sur l'amélioration réelle du modèle ; ② Maintien du stockage local des données, garantissant que la vie privée ne soit pas exposée ; ③ Introduction d'un mécanisme de robustesse pour contrer les attaques de pollution ou d'agrégation des formateurs malveillants ; ④ Assurer la vérifiabilité des calculs critiques tels que l'agrégation de modèles, la détection d'anomalies et l'évaluation de contributions via ZKP ; ⑤ Être efficace et applicable à des données hétérogènes et à différentes tâches d'apprentissage.

Valeur des jetons d'AI intégrés

Le mécanisme des jetons de ChainOpera fonctionne autour de cinq flux de valeur (LaunchPad, Agent API, Model Serving, Contribution, Model Training), son cœur étant les frais de service, la confirmation de contribution et la répartition des ressources, plutôt que de se concentrer sur des retours spéculatifs.

Utilisateurs AI : accéder aux services ou s'abonner à des applications en utilisant des jetons, et contribuer à l'écosystème en fournissant/l'étiquetage/staking de données.

Développeurs d'agents/applications : utiliser la puissance de calcul et les données de la plateforme pour le développement, et obtenir la reconnaissance du protocole pour leur contribution d'agent, d'application ou de jeu de données.

Fournisseurs de ressources : contribuer de la puissance de calcul, des données ou des modèles, recevoir une documentation claire et des incitations.

Participants à la gouvernance (communauté & DAO) : participer au vote, à la conception de mécanismes et à la coordination de l'écosystème via des jetons.

Couche de protocole (COAI) : maintenir le développement durable grâce aux frais de service, en utilisant un mécanisme d'allocation automatisé pour équilibrer l'offre et la demande.

Nœuds et validateurs : fournir des services de validation, de puissance de calcul et de sécurité, assurant la fiabilité du réseau.

Gouvernance de protocole

ChainOpera adopte une gouvernance DAO, permettant la participation aux propositions et aux votes par le biais de la mise en jeu de jetons, garantissant la transparence et l'équité des décisions. Le mécanisme de gouvernance comprend : un système de réputation (vérifiant et quantifiant les contributions), une collaboration communautaire (propositions et votes pour faire avancer l'écosystème), et un ajustement des paramètres (utilisation des données, sécurité et responsabilité des validateurs). L'objectif global est d'éviter la concentration du pouvoir, de maintenir la stabilité du système et de favoriser la co-création communautaire.

Huit, Contexte de l'équipe et financement du projet

Le projet ChainOpera a été co-fondé par le professeur Salman Avestimehr, qui possède une expertise approfondie dans le domaine de l'apprentissage fédéré, et le Dr. Aiden Chaoyang He. Les autres membres clés de l'équipe proviennent d'institutions académiques et technologiques de premier plan telles que UC Berkeley, Stanford, USC, MIT, Tsinghua University, ainsi que de Google, Amazon, Tencent, Meta et Apple, combinant la recherche académique et l'expérience industrielle. À ce jour, l'équipe de ChainOpera AI compte plus de 40 personnes.

Co-fondateur : Salman Avestimehr

Le professeur Salman Avestimehr est professeur Dean à l'université de Californie du Sud (USC) dans le département d'ingénierie électrique et informatique, et directeur fondateur du centre USC-Amazon Trusted AI, tout en dirigeant le laboratoire d'information et d'apprentissage machine de l'USC (vITAL). Il est co-fondateur et PDG de FedML et a co-fondé TensorOpera/ChainOpera AI en 2022.

Le professeur Salman Avestimehr est diplômé du doctorat en EECS de l'UC Berkeley (meilleur prix de papier). En tant que Fellow IEEE, il a publié plus de 300 articles de haut niveau dans les domaines de la théorie de l'information, du calcul distribué et de l'apprentissage fédéré, avec plus de 30 000 citations, et a reçu plusieurs honneurs internationaux tels que PECASE, NSF CAREER, IEEE Massey Award. Il a dirigé la création du cadre open-source FedML, largement utilisé dans le secteur de la santé, de la finance et du calcul privé, devenant le fondement technologique clé de TensorOpera/ChainOpera AI.

Co-fondateur : Dr. Aiden Chaoyang He

Dr. Aiden Chaoyang He est co-fondateur et président de TensorOpera/ChainOpera AI, docteur en informatique de l'université de Californie du Sud (USC), créateur original de FedML. Ses domaines de recherche couvrent l'apprentissage distribué et fédéré, l'entraînement de modèles à grande échelle, la blockchain et le calcul privé. Avant son aventure entrepreneuriale, il a travaillé dans la recherche et le développement chez Meta, Amazon, Google, Tencent et a occupé des postes clés en ingénierie et en gestion chez Tencent, Baidu et Huawei, dirigeant plusieurs produits Internet et plateformes AI de niveau supérieur.

Dans le domaine académique et industriel, Aiden a publié plus de 30 articles, avec plus de 13 000 citations sur Google Scholar, et a reçu des prix tels que la bourse Amazon Ph.D., la bourse d'innovation Qualcomm, ainsi que le prix du meilleur papier à NeurIPS et AAAI. Il a dirigé le développement du cadre FedML, l'un des projets open-source les plus utilisés dans le domaine de l'apprentissage fédéré, soutenant en moyenne 27 milliards de demandes par jour ; et en tant qu'auteur principal, il a proposé le cadre FedNLP et des méthodes de formation de modèles hybrides, largement appliquées à des projets AI décentralisés tels que Sahara AI.

En décembre 2024, ChainOpera AI a annoncé avoir levé 3,5 millions de dollars lors d'un tour de financement de démarrage, portant le total des financements à 17 millions de dollars en collaboration avec TensorOpera. Les fonds seront utilisés pour construire un L1 blockchain orienté vers les agents AI décentralisés et un système d'exploitation AI. Ce tour de financement a été dirigé par Finality Capital, Road Capital et IDG Capital, avec des investisseurs tels que Camford VC, ABCDE Capital, Amber Group, Modular Capital, etc., ainsi que le soutien d'institutions et d'investisseurs individuels renommés tels que Sparkle Ventures, Plug and Play, USC et Sreeram Kannan, fondateur d'EigenLayer, et David Tse, co-fondateur de BabylonChain. L'équipe a déclaré que ce tour de financement accélérera la réalisation de la vision d'un "écosystème AI décentralisé co-proprié et co-créé par les contributeurs de ressources AI, les développeurs et les utilisateurs".

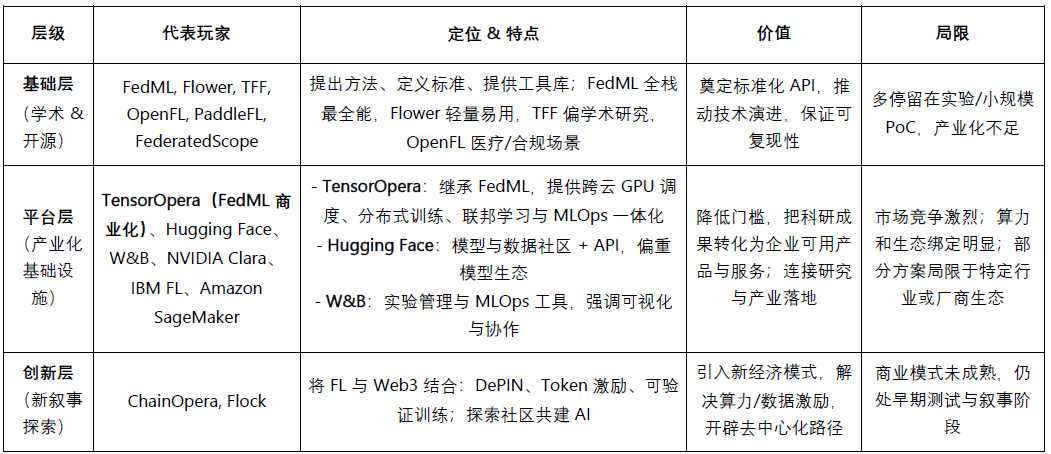

Neuf, Analyse du paysage du marché de l'apprentissage fédéré et des agents AI

Les principaux cadres d'apprentissage fédéré comprennent quatre représentants : FedML, Flower, TFF, OpenFL. Parmi eux, FedML est le plus complet, combinant apprentissage fédéré, entraînement de grands modèles distribués et MLOps, adapté aux applications industrielles ; Flower est léger et facile à utiliser, avec une communauté active, axé sur l'enseignement et les petites expériences ; TFF dépend fortement de TensorFlow, ayant une valeur académique élevée, mais une faible industrialisation ; OpenFL se concentre sur la santé/finance, mettant l'accent sur la conformité à la vie privée, avec un écosystème relativement fermé. Dans l'ensemble, FedML représente un chemin polyvalent de niveau industriel, Flower se concentre sur la facilité d'utilisation et l'éducation, TFF est axé sur l'expérimentation académique, tandis qu'OpenFL a un avantage en matière de conformité dans des secteurs verticaux.

Au niveau de l'industrialisation et de l'infrastructure, TensorOpera (la commercialisation de FedML) se distingue par son héritage technique open-source de FedML, offrant des capacités intégrées de planification GPU inter-cloud, d'entraînement distribué, d'apprentissage fédéré et de MLOps, visant à établir un pont entre la recherche académique et l'application industrielle, au service des développeurs, des PME et des écosystèmes Web3/DePIN. Dans l'ensemble, TensorOpera est l'équivalent d'une "combinaison de Hugging Face et W&B pour l'open-source FedML", étant plus complet et polyvalent en matière de capacités d'entraînement distribué et d'apprentissage fédéré, se distinguant des autres plateformes centrées sur la communauté, les outils ou un secteur unique.

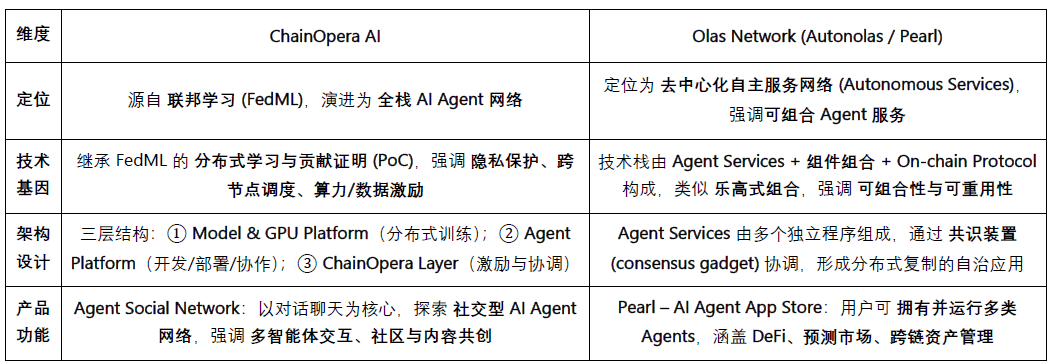

Parmi les représentants de la couche d'innovation, ChainOpera et Flock tentent tous deux de combiner l'apprentissage fédéré et Web3, mais leurs directions présentent des différences évidentes. ChainOpera construit une plateforme AI Agent Full Stack, couvrant une architecture à quatre niveaux : accès, social, développement et infrastructure, sa valeur fondamentale résidant dans le passage des utilisateurs de "consommateurs" à "co-créateurs", et à travers AI Terminal et Agent Social Network, réalisant une AGI collaborative et co-construisant un écosystème communautaire ; tandis que Flock se concentre davantage sur l'apprentissage fédéré amélioré par la blockchain (BAFL), mettant l'accent sur la protection de la vie privée et les mécanismes d'incitation dans un environnement décentralisé, visant principalement la validation de la coopération au niveau de la puissance de calcul et des données. ChainOpera est davantage orienté vers le déploiement de la couche d'application et de réseau d'agents, tandis que Flock se concentre sur le renforcement de l'entraînement de base et du calcul privé.

Au niveau du réseau d'agents, le projet le plus représentatif dans l'industrie est Olas Network. ChainOpera dérive de l'apprentissage fédéré, construisant un cycle fermé complet de modèle - puissance de calcul - agents, et explore l'interaction et la collaboration sociale entre plusieurs agents grâce à Agent Social Network ; Olas Network vient de la coopération DAO et de l'écosystème DeFi, se positionnant comme un réseau de services autonomes décentralisés, proposant des scénarios de rendement DeFi directement réalisables, et montrant un chemin radicalement différent de celui de ChainOpera.

Dix, Analyse de la logique d'investissement et des risques potentiels

Logique d'investissement

L'avantage de ChainOpera réside d'abord dans sa défense technologique : de FedML (le cadre open-source emblématique de l'apprentissage fédéré) à TensorOpera (infra AI Full Stack de niveau entreprise), puis à ChainOpera (réseau d'agents Web3 + DePIN + Tokenomics), formant un chemin d'évolution continu unique, alliant accumulation académique, déploiement industriel et narration cryptographique.

En termes de taille d'application et d'utilisateur, AI Terminal a déjà formé des centaines de milliers d'utilisateurs actifs quotidiens et un écosystème d'applications agent de niveau mille, se classant première dans la catégorie AI sur BNBChain DApp Bay, avec une croissance d'utilisateur sur la chaîne claire et un volume de transactions réel. Ses scénarios multimodaux couvrant le domaine natif des crypto-monnaies devraient progressivement se répandre auprès d'un public Web2 plus large.

Concernant la coopération écologique, ChainOpera a lancé l'alliance CO-AI, unissant des partenaires tels qu'io.net, Render, TensorOpera, FedML et MindNetwork pour construire des effets de réseau multilatéraux autour de GPU, modèles, données et calculs privés ; en même temps, une collaboration avec Samsung Electronics a été établie pour valider la GenAI multimodale sur mobile, démontrant un potentiel d'expansion vers le matériel et l'IA en périphérie.

En ce qui concerne les jetons et le modèle économique, ChainOpera se base sur le consensus Proof-of-Intelligence, distribuant des incitations autour de cinq flux de valeur (LaunchPad, Agent API, Model Serving, Contribution, Model Training), et formant un cycle positif via des frais de service de 1%, la distribution d'incitations et le soutien à la liquidité, évitant un modèle de "spéculation sur les jetons" unique, augmentant ainsi la durabilité.

Risques potentiels

Tout d'abord, la difficulté de mise en œuvre technique est élevée. L'architecture décentralisée à cinq niveaux proposée par ChainOpera est vaste, et la collaboration entre les niveaux (en particulier dans le raisonnement distribué de grands modèles et l'entraînement privé) présente encore des défis en matière de performance et de stabilité, n'ayant pas été vérifiée à grande échelle.

Ensuite, la fidélité des utilisateurs de l'écosystème nécessite encore d'être observée. Bien que le projet ait enregistré une première croissance des utilisateurs, la capacité de la Marketplace des agents et de la chaîne d'outils pour les développeurs à maintenir une offre active et de haute qualité à long terme reste à vérifier. Actuellement, le réseau social des agents lancé repose principalement sur des dialogues textuels générés par LLM, et l'expérience utilisateur et la rétention à long terme doivent encore être améliorées. Si le mécanisme d'incitation n'est pas suffisamment raffiné, il pourrait y avoir une situation où l'activité à court terme est élevée mais la valeur à long terme est insuffisante.

Enfin, la durabilité du modèle commercial reste à confirmer. À l'heure actuelle, les revenus dépendent principalement des frais de service de la plateforme et du cycle des jetons, avec un flux de trésorerie stable qui n'est pas encore établi. Comparé à des applications plus financières ou productives telles qu'AgentFi ou Payment, la valeur commerciale du modèle actuel doit encore être validée ; par ailleurs, l'écosystème mobile et matériel est encore en phase d'exploration, avec des perspectives de commercialisation existant une certaine incertitude.

Avertissement : Ce document a été rédigé avec l'aide de l'outil AI ChatGPT-5, l'auteur a fait de son mieux pour vérifier et assurer l'exactitude des informations, mais il peut y avoir des omissions. Il est important de noter qu'il existe souvent un écart entre les fondamentaux des projets et leur performance sur le marché secondaire dans le secteur des actifs cryptographiques. Le contenu de ce document est uniquement destiné à l'intégration d'informations et à l'échange académique/recherche, ne constituant pas un conseil d'investissement et ne devant pas être considéré comme une recommandation d'achat ou de vente de jetons.