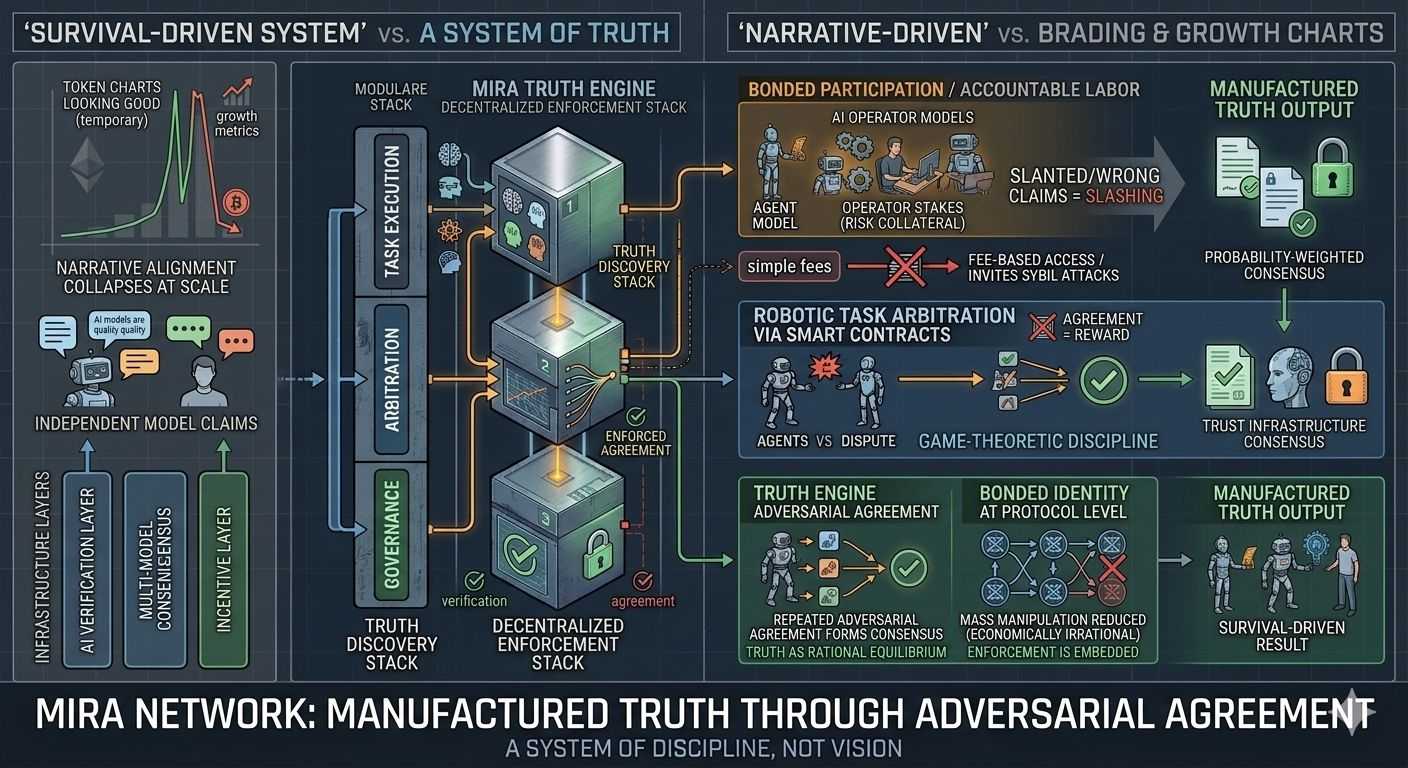

Je ne fais plus confiance aux récits. Je fais confiance aux systèmes qui survivent au contact de la réalité. Après avoir intégré plusieurs couches de vérification d'IA dans les flux de travail de production, j'ai appris que la plupart des histoires de "IA décentralisée" s'effondrent au moment où les incitations rencontrent l'échelle. Les graphiques de croissance ont l'air bons. Les graphiques de jetons ont l'air encore mieux. Mais la vraie question est toujours la même : qui fait respecter la vérité quand elle devient coûteuse ?

C'est pourquoi le réseau Mira a attiré mon attention—non pas à cause des indicateurs d'adoption ou de la portée sociale, mais à cause de la façon dont il traite la vérité comme un problème d'infrastructure plutôt que comme un problème de marque.

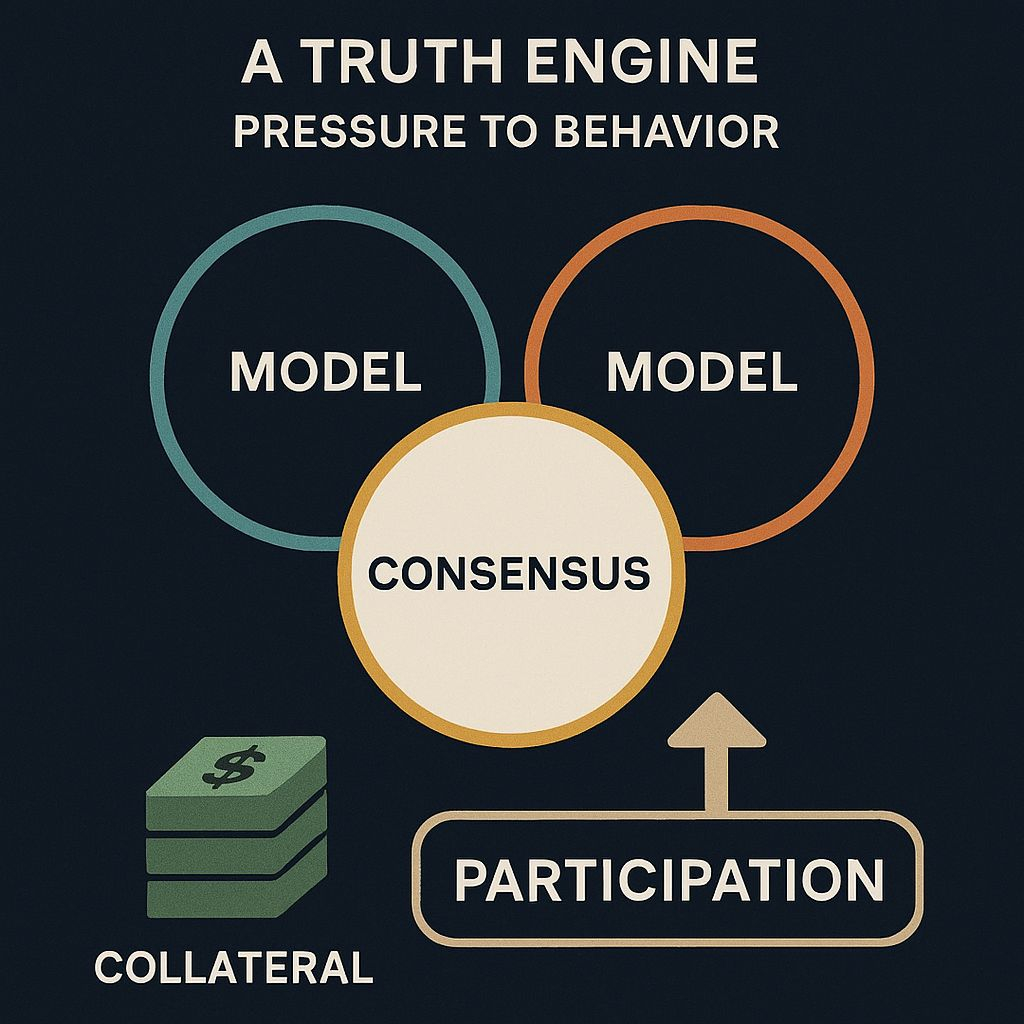

La plupart des réseaux d'IA parlent de précision comme s'il s'agissait d'une caractéristique. Mira le considère comme un résultat de l'application. La confiance ne vient pas d'un seul modèle affirmant la certitude. Elle provient de l'accord multi-modèle, où des systèmes indépendants vérifient la même affirmation et convergent statistiquement. Pas de raccourcis de réputation. Pas d'autorité institutionnelle. Juste un calcul parallèle produisant un consensus pondéré par la probabilité.

Du point de vue d'un opérateur, cela compte plus que la vitesse des tokens ou le nombre d'utilisateurs. La question centrale est : qui peut participer, et à quel risque ? L'entrée et les obligations de travail pondérées par la mise de Mira changent la donne. Vous ne payez pas simplement des frais pour soumettre des résultats. Vous postez une garantie qui peut être réduite si vous avez tort. Cela transforme la participation d'une interaction occasionnelle en un travail responsable.

L'accès basé sur des frais crée du volume. La participation liée crée de la discipline.

Lorsque les acteurs ont un intérêt dans le résultat, le comportement change. Vous arrêtez d'optimiser pour la vitesse et commencez à optimiser pour la correction. Le système devient théorique des jeux : les stratégies honnêtes surperforment celles malhonnêtes parce que les récompenses sont liées à un accord vérifiable, pas à un alignement narratif. La vérité devient l'équilibre rationnel, pas une aspiration morale.

Cela résout également le problème que la plupart des réseaux évitent : la résistance aux Sybils. Sans identité liée au niveau du protocole, la décentralisation devient du théâtre. La structure de Mira impose un coût à la participation, rendant la manipulation de masse économiquement irrationnelle. L'application est intégrée, pas externalisée à la modération ou à la confiance de la communauté.

Ce que je vois dans Mira n'est pas un oracle de vérité. C'est un moteur de vérité—celui qui produit de l'exactitude par un accord répété et adversarial. Le consensus n'est pas déclaré. Il est autorisé à se former sous contrainte.

Après suffisamment d'intégrations, vous n'êtes plus impressionné par le langage marketing. Vous commencez à observer où la pression est appliquée. Dans Mira, la pression est appliquée au comportement, pas à la croyance.

Et c'est la différence silencieuse entre les réseaux qui vendent la confiance et ceux qui la fabriquent.

@Mira - Trust Layer of AI #mira #MIRA $MIRA