La première fois que j'ai utilisé un chatbot IA et qu'il m'a donné une réponse qui semblait juste mais était clairement fausse, je ne l'ai pas ignorée. Cela a laissé un petit nœud silencieux dans mon cerveau, comme lorsque vous entendez une chanson familière jouée légèrement faux. À l'époque, je ne savais pas grand-chose sur la vérification de l'IA. Je savais juste que quelque chose de profond sous la surface devait changer.

Les chatbots sont devenus un terme abrégé pour l'IA conversationnelle. Ils sont partout dans le support client, les ventes, l'éducation et le divertissement. La promesse est simple. Parlez à une machine comme vous parlez à une personne. Pourtant, la fluidité conversationnelle et la précision réelle sont des choses différentes. Une IA peut sembler empathique et halluciner un fait. Elle peut écrire magnifiquement et être encore dans l'erreur. Cette texture, la différence entre sembler juste et être juste, est le problème central que MIRA aborde.

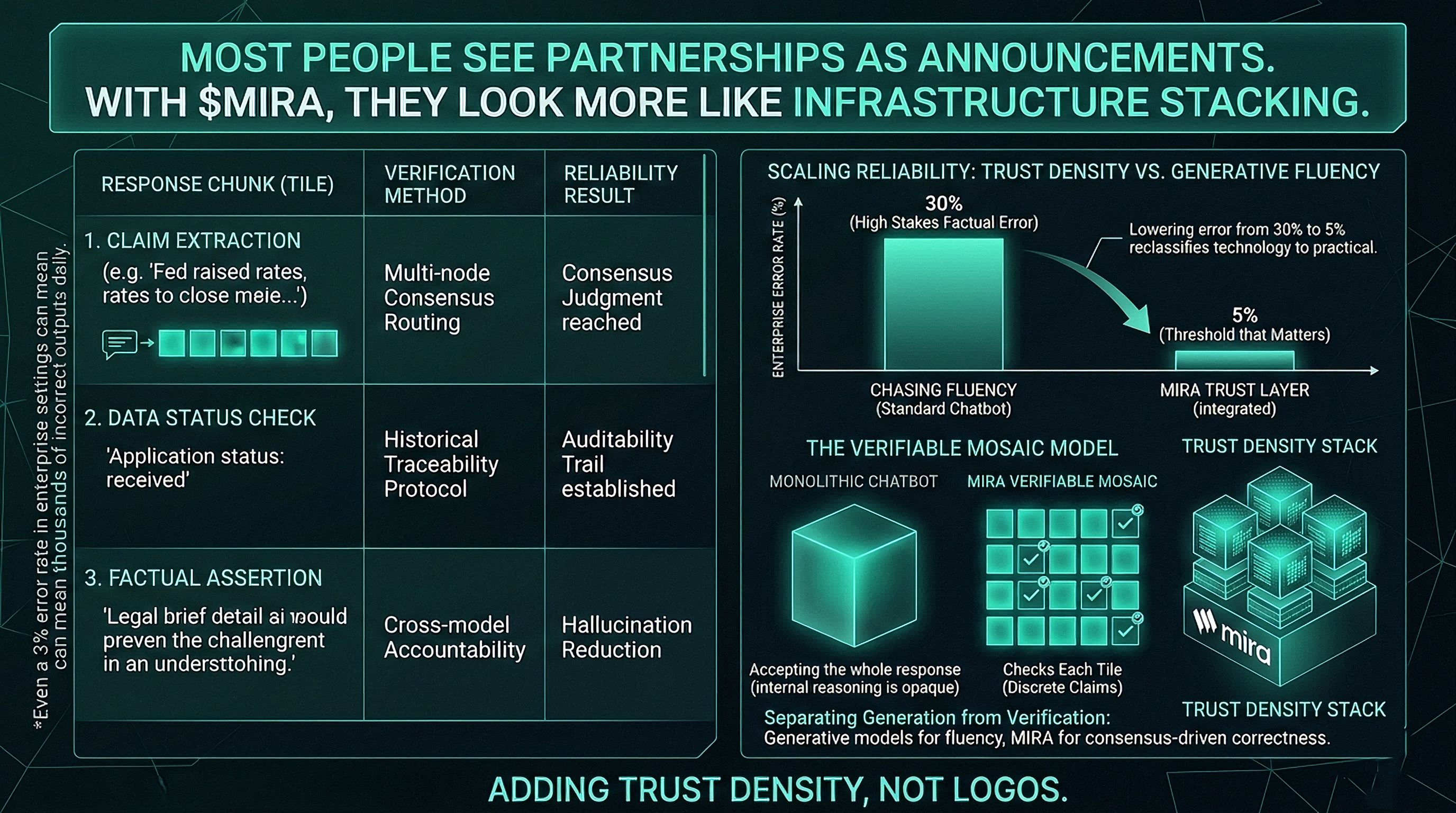

À première vue, améliorer les chatbots IA semble être un problème de performance. Rendre les modèles plus grands, les former sur plus de données, optimiser la vitesse de réponse. De nombreux projets poursuivent cette voie. Ce qui se cache sous cette surface est le problème de confiance. À mesure que l'IA s'intègre dans des flux de travail qui comptent, comme les briefs juridiques, la résolution de problèmes financiers ou le triage en santé, le coût d'une seule mauvaise réponse augmente considérablement. Dans les environnements d'entreprise, même un taux d'erreur de 3 % peut signifier des milliers de sorties incorrectes chaque jour, ce qui se traduit par des risques financiers, réputationnels ou réglementaires réels.

Cette idée selon laquelle la fondation de l'IA conversationnelle doit être la confiance plutôt que la fluidité est en partie ce qui distingue @mira_network. L'architecture traditionnelle considère les chatbots comme des oracles monolithiques dont le raisonnement interne est opaque. MIRA renverse cette hypothèse. Au lieu de prendre une sortie de modèle pour argent comptant, elle la décompose en revendications individuelles qui peuvent être vérifiées indépendamment. Imaginez une réponse de chatbot comme un mosaïque. Au lieu d'accepter l'ensemble, MIRA vérifie chaque tuile.

Décomposer une réponse IA en morceaux discrets est important car cela transforme un score de confiance amorphe en points de contrôle mesurables. Par exemple, si un chatbot déclare : La Réserve fédérale a augmenté les taux d'intérêt de 0,25 pour cent en mars, le système peut extraire cette revendication, la router vers plusieurs nœuds vérificateurs indépendants et parvenir à un jugement de consensus sur sa véracité. Cela transforme ce qui est normalement une seule réponse indifférenciée en une séquence de faits vérifiables.

Sous ce processus, il existe un schéma d'équité qui mérite d'être noté. Les hallucinations de l'IA ne sont pas aléatoires. Ce sont des artefacts de prédiction statistique. Le modèle devine le jeton suivant le plus probable en fonction des données d'entraînement. Cela fonctionne pour la prose créative. Cela échoue dans des contextes factuels à enjeux élevés. En routant chaque revendication à travers des nœuds de vérification divers, puis en agrégeant les jugements, cela introduit une couche de responsabilité inter-modèles qui n'est pas typique dans les flux de chatbots standard.

Utiliser cette méthode change la façon dont un chatbot se comporte en surface et en dessous. En surface, les utilisateurs apprécient toujours une interface de conversation. Le dialogue semble naturel et le contexte est préservé. En dessous, chaque revendication intégrée dans l'interface ne porte pas seulement une réponse, mais un soutien d'un consensus décentralisé. Cela change la texture de fiabilité de la sortie.

Pendant ce temps, cette approche s'aligne sur une tendance plus large dans l'IA qui sépare la génération de la vérification. Les modèles génératifs sont forts pour produire un texte plausible, mais tout texte plausible n'est pas véridique. Les réseaux de vérification comme MIRA comblent cette lacune en introduisant des incitations économiques et des protocoles de consensus qui découragent les sorties fausses. Ce n'est pas un ajout technique. C'est un changement dans la façon dont les systèmes de dialogue IA sont architecturés.

Un exemple pratique aide à clarifier cela. Supposons que vous utilisez un chatbot IA construit avec #Mira vérification intégrée dans un flux de travail de support client. Un utilisateur demande le statut d'une demande. Un chatbot typique pourrait générer une réponse qui semble confiante mais qui est basée sur des données de backend obsolètes ou un contexte incomplet. Une version alimentée par MIRA décompose la réponse en éléments vérifiables tels que la date à laquelle la demande a été reçue, le code de statut actuel et le prochain jalon attendu, puis vérifie chacun avec consensus avant de composer la réponse finale. Les utilisateurs reçoivent non seulement des réponses qui semblent correctes, mais des réponses qui sont statistiquement et socialement vérifiées comme correctes.

Cela ne signifie pas que le système ne se trompe jamais. Aucun système ne peut revendiquer une précision parfaite. Les premiers signes suggèrent que la superposition de la vérification sous l'IA conversationnelle réduit considérablement le taux d'affirmations incorrectes. Si les chatbots de base hallucinent dans la nature à des taux mesurables selon le domaine, l'ajout d'une couche de vérification de la vérité peut rapprocher les niveaux d'erreur des seuils qui comptent dans les affaires et les contextes de gouvernance. Réduire l'erreur de 30 pour cent à 5 pour cent n'est pas incrémental. Cela reclassifie la technologie d'exploratoire à pratique.

Ce qui m'a frappé, c'est le changement subtil dans notre façon de penser les interactions avec l'IA. Traditionnellement, les chatbots étaient jugés par leur apparence humaine. Aujourd'hui, ils sont de plus en plus jugés par leur fiabilité. Ce changement est silencieux mais indéniable. Il reflète des attentes plus profondes des utilisateurs professionnels et des consommateurs. Les gens se soucient moins de la verbosité et plus de la vérifiabilité. Ils se soucient moins du style et plus de la fondation.

Inclure la vérification dans l'IA conversationnelle a également des implications plus larges. Lorsque les sorties peuvent être auditées indépendamment, cela permet le suivi de la conformité, la traçabilité historique et des pistes de responsabilité qui sont essentielles dans les industries réglementées. Des systèmes comme MIRA n'améliorent pas seulement les chatbots. Ils construisent des couches de confiance qui peuvent être auditées et contestées. Cela représente un niveau de maturité différent.

Les marchés réagissent à ce changement. Les jetons et protocoles liés à une infrastructure qui se concentre sur une livraison fiable plutôt que sur une génération tape-à-l'œil attirent l'attention des constructeurs et des institutions. Le récit autour de Mira le reflète. Ce n'est pas simplement un autre jeton d'IA. C'est un jeton lié à un réseau d'infrastructure de vérification qui permet à l'IA conversationnelle de fournir des sorties qui peuvent être auditées, contestées et vérifiées.

Il existe des contre-arguments évidents. Certains développeurs soutiennent que cela ajoute de la latence ou de la complexité. La vérification en temps réel peut introduire des frais généraux, en particulier dans des applications sensibles au temps. C'est valide et reste un défi d'ingénierie. La question de savoir si la vérification peut évoluer pour chaque cas d'utilisation sans compromettre la réactivité reste à voir. L'idée fondamentale que la confiance est le nouveau goulet d'étranglement de performance semble légitime.

Dans le schéma général de la fiabilité technologique, les couches de fiabilité suivent généralement les couches génératives. Les premiers protocoles Internet étaient axés sur la connectivité. Les couches ultérieures ont ajouté le chiffrement, l'identité et la vérification. Ce que MIRA fait avec les chatbots ressemble à l'ajout de SSL au web. En surface, vous naviguez toujours. En dessous, la connexion est sécurisée. Dans le chat IA, la surface est le dialogue. En dessous, la vérité est vérifiée.

Les chatbots étaient auparavant jugés par leur capacité à imiter les humains. Maintenant, ils sont jugés par leur capacité à être vérifiés. Dans un monde où l'IA est intégrée dans des décisions financières, juridiques et personnelles, cette seconde mesure compte plus que la fluidité. Lorsque la confiance entre dans le dialogue, la conversation change fondamentalement.