Escrito por el Equipo Científico de Qubic

El cerebro es dinámico y no binario

Las redes biológicas del cerebro no operan como un interruptor de decisión entre la activación y el descanso. En los sistemas vivos, la inactividad en sí misma implica dinamismo. Un “descanso” absoluto sería incompatible con la vida. Como vimos en el primer capítulo, la vida se desarrolla en el tiempo.

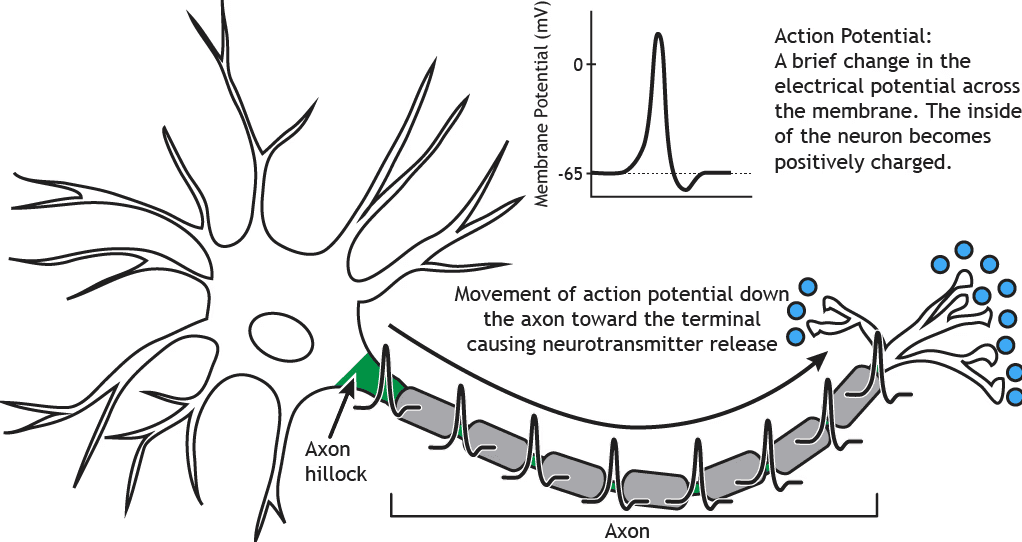

Una neurona individual puede parecer un evento de todo o nada, transmitiendo corriente eléctrica a otra neurona para inhibirla o excitarla. Sin embargo, antes de esa transmisión, el potencial de acción, la neurona recibe continuamente entradas positivas y negativas en una región llamada las dendritas. Si la suma global de estas entradas excede un cierto umbral, ocurre un cambio conformacional físico, y la corriente eléctrica se propaga a lo largo del axón hacia la siguiente neurona. La mayor parte del tiempo, el procesamiento neuronal ocurre por debajo del umbral de acción, donde las corrientes excitatorias e inhibitorias se integran continuamente.

En la neurociencia computacional, está bien establecido que el cerebro es un sistema dinámico continuo cuyas estados evolucionan incluso en ausencia de estímulos externos (Deco et al., 2009; Northoff, 2018).

No hay eventos discretos ni reinicios en el cerebro. Cada estímulo externo actúa sobre un sistema vivo que ya tiene una configuración previa. Un estímulo puede sesgar un estado excitatorio o inhibitorio, pero nunca uno estático. Es como una pelota en un campo de fútbol: la misma trayectoria desencadena diferentes resultados dependiendo de las posiciones dinámicas de los jugadores. Con un camino idéntico, la jugada puede fallar o convertirse en una asistencia decisiva.

Los mecanismos que mantienen a las neuronas activas independientemente de los estímulos inmediatos son bien conocidos.

Uno de ellos consiste en entradas subumbral, que alteran el potencial de membrana sin generar un potencial de acción.

Otros incluyen sinapsis silenciosas y espinas dendríticas, que preservan la conectividad latente entre neuronas o promueven la activación local.

El mecanismo más importante involucra receptores metabotrópicos vinculados a neurotransmisores, que organizan el contexto. No determinan directamente si se desencadena un potencial de acción. En cambio, definen qué es relevante o no, qué predicción de recompensa lleva un estímulo, qué nivel de alerta o peligro está presente, cuánta novedad existe en el sistema, qué grado de atención sostenida se requiere, qué equilibrio entre exploración y explotación es apropiado, qué debe ser codificado versus olvidado, cómo se regula el estado interno y cuándo el control de impulso o la estabilidad temporal son ventajosos.

En otras palabras, los receptores metabotrópicos implementan una forma de metacontrol sabio. ¡No son datos, sino parámetros! Funcionan como variables dinámicas que ajustan el comportamiento del sistema. Permiten que el sistema se vuelva sensible al significado funcional de una situación (novedad, relevancia, recompensa o amenaza) sin requerir respuestas inmediatas.

Volviendo a la metáfora del fútbol, los receptores metabotrópicos corresponden a tácticas de equipo: decidir cuándo atacar o defender, es decir, decidir cómo se juega el partido.

Desde una perspectiva computacional, estos mecanismos operan a través de estados intermedios. No son binarios (activo/inactivo). El sistema opera en tres modos: excitatorio, inhibitorio y un estado intermedio que no produce salida inmediata pero modula dinámicas futuras.

Cuando hablamos de ternario en redes neuronales biológicas, no nos referimos a una abstracción matemática o cálculo, sino a una descripción funcional literal de cómo el cerebro mantiene el equilibrio a lo largo del tiempo.

Por esta razón, la neurociencia computacional no estudia principalmente los mapeos de entrada-salida, sino cómo los estados se reorganizan continuamente. Estos estados son fundamentalmente predictivos por naturaleza (Friston, 2010; Deco et al., 2009).

Los LLMs son cálculos binarios.

En los modelos de lenguaje grandes, el concepto de ternariedad no tiene sentido. El aprendizaje se basa fundamentalmente en la retropropagación de errores. Es decir, una vez que se conoce la magnitud del error en relación con los datos esperados, un algoritmo de optimización ajusta parámetros utilizando una señal externa.

¿Cómo funciona esto? El modelo produce una salida, por ejemplo, la predicción de la próxima palabra más probable: “París es la capital de …”. Si la respuesta es Finlandia, esto se compara con la palabra correcta del conjunto de entrenamiento (Francia). A partir de esta comparación, se calcula un error numérico. Este error cuantifica cuán lejos se desvía la predicción del valor esperado. El error se transforma en un gradiente, es decir, una señal matemática que indica en qué dirección y en cuánto deben ajustarse los parámetros del modelo para reducir el error. Los pesos se actualizan hacia atrás solo después de que se ha producido y evaluado la salida.

El error se calcula a posteriori, los pesos se ajustan de tal manera que la respuesta correcta se convierte en Francia, y el sistema reanuda su funcionamiento como si nada hubiera sucedido.

En los modelos de lenguaje grandes, la separación entre dinámicas y aprendizaje es especialmente pronunciada. Durante la inferencia, los parámetros permanecen fijos; no hay plasticidad en línea, no hay habituación, no hay fatiga y no hay adaptación dependiente del tiempo. El sistema no cambia al estar activo.

En la metáfora del fútbol, los LLMs se asemejan a un entrenador que revisa errores después del partido y ajusta tácticas para el siguiente. Pero durante el partido en sí, el equipo juega los noventa minutos completos sin ninguna posibilidad de modificación técnica o táctica.

Hay estrategia previa al partido y corrección posterior al partido, pero ¡no hay dinamismo durante el juego!

Los LLMs, por lo tanto, no son ternarios en un sentido funcional. Son matrices de “atención” (transformadores) entrenadas fuera de línea (Vaswani et al., 2017). Esta no es una limitación cuantitativa, sino una diferencia ontológica.

Dinámicas trinitarias de Neuraxon y Aigarth

Neuraxon introduce un marco fundamentalmente diferente. Su unidad básica no es una función de entrada-salida, como en los LLMs, sino un estado interno continuo que evoluciona con el tiempo. En Neuraxon, la excitación se representa como +1, la inhibición como −1, y entre estos dos estados existe un rango neutral representado por 0.

En cada momento, el sistema integra la influencia de las entradas actuales, la historia reciente y los mecanismos internos para generar una salida trinomial discreta (excitacion, inhibición o neutralidad).

La relación entre el tiempo y el ternario es central. El estado neutral no representa la ausencia de computación o inactividad, sino una fase subumbral en la que el sistema acumula influencia sin producir una salida inmediata. Es comparable a un cambio táctico dinámico en un equipo de fútbol, independientemente de si conduce a un gol a favor o en contra.

Aigarth expresa la misma lógica a nivel estructural. No solo las unidades en sí son ternarias, sino que la red puede crecer, reorganizarse o colapsar dependiendo de su utilidad, introduciendo una dimensión evolutiva que refuerza la adaptación continua. La combinación Neuraxon–Aigarth (micro–macro) da lugar a tejidos computacionales capaces de permanecer activos (unidades de tejido inteligente), algo imposible para arquitecturas basadas exclusivamente en retropropagación.

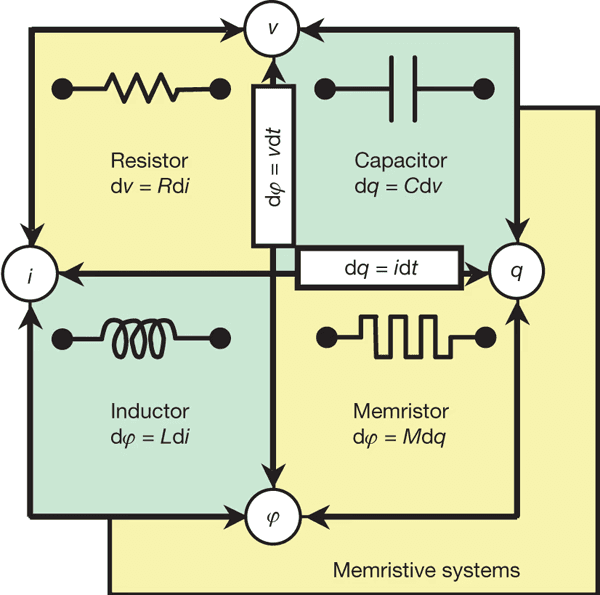

La cuestión del hardware no puede ser ignorada. En la actualidad, no existe hardware ternario de propósito general, pero hay líneas de investigación activas en lógica ternaria, incluidos memristores multivaluados y computación neuromórfica basada en dispositivos resistivos o espintrónicos (Yang et al., 2013; Indiveri & Liu, 2015). Estos enfoques buscan reducir el consumo de energía y, más importante aún, lograr una computación ternaria alineada con dinámicas físicas, vivas y continuas.

¿Tiene sentido una arquitectura ternaria incluso sin hardware ternario dedicado? A pesar de esta limitación, sí, porque la arquitectura precede al sustrato físico. Al diseñar sistemas ternarios, revelamos la incapacidad de la lógica binaria para reflejar un mundo dinámico. Al mismo tiempo, arquitecturas ternarias como Neuraxon–Aigarth ya pueden ofrecer mejoras en el hardware binario existente al reducir la actividad innecesaria.

Referencias

Deco, G., Jirsa, V. K., Robinson, P. A., Breakspear, M., & Friston, K. J. (2009). El cerebro dinámico: de neuronas que disparan a masas neuronales y campos corticales. PLoS Biología Computacional, 5(8), e1000092.

Friston, K. (2010). ¿El principio de libre energía: una teoría unificada del cerebro? Nature Reviews Neuroscience, 11(2), 127–138.

Indiveri, G., & Liu, S.-C. (2015). Memoria y procesamiento de información en sistemas neuromórficos. Actas de la IEEE, 103(8), 1379–1397.

Northoff, G. (2018). El cerebro espontáneo: del problema mente-cuerpo a una neurofenomenología. MIT Press.

Vaswani, A., Shazeer, N., Parmar, N., et al. (2017). La atención es todo lo que necesitas. Avances en Sistemas de Procesamiento de Información Neural, 30.

Yang, J. J., Strukov, D. B., & Stewart, D. R. (2013). Dispositivos memristivos para computación. Nature Nanotechnology, 8(1), 13–24.